NvidiaがGroqに2兆円超を投じた本当の理由

NvidiaがGroqのライセンス契約と人材獲得に約200億ドルを投じた。AIチップ市場の「推論」競争が激化する中、この動きが日本の半導体・AI産業に何をもたらすのか。

クリスマスイブの夜、市場がほぼ眠りについていた頃、AIチップ業界に静かな地殻変動が起きていました。Nvidiaが、チップスタートアップGroqの技術ライセンスと主要人材獲得に、約200億ドル(約3兆円)を投じると報じられたのです。年末の喧騒にまぎれ、この取引は長らく注目を集めませんでした。しかし2026年3月、Nvidiaの年次イベント「GTC」を前に、その戦略的意味が改めて問われています。

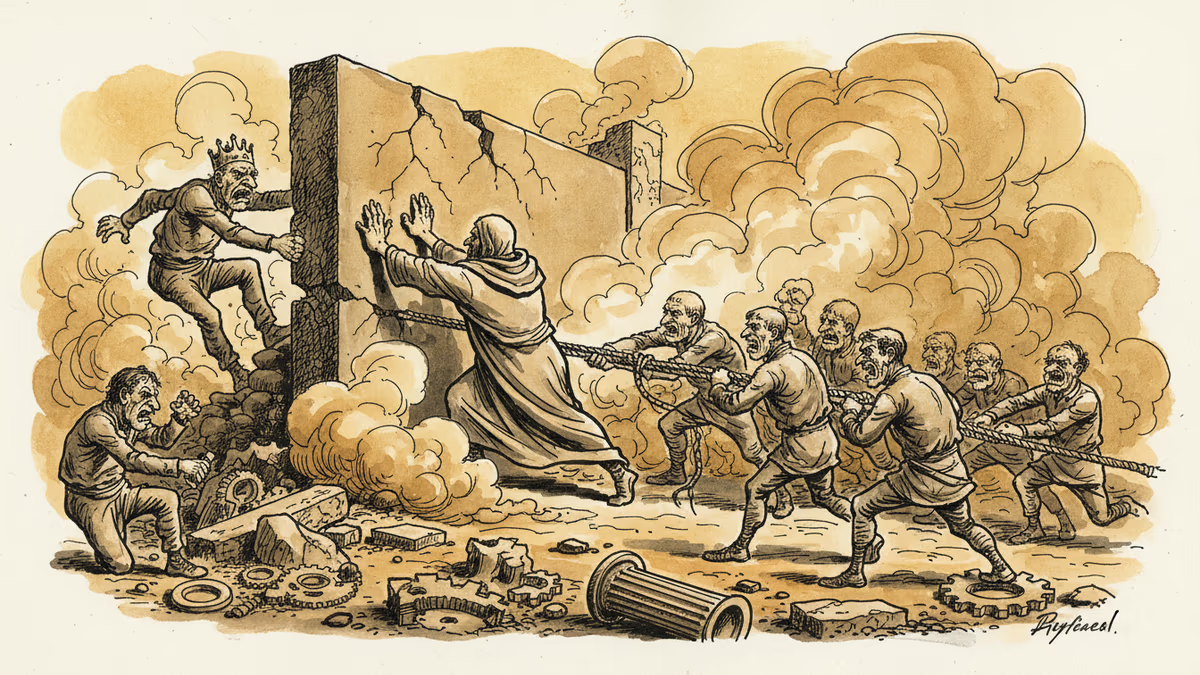

「推論」という新たな戦場

AIチップの世界には、大きく二つのフェーズがあります。「学習(トレーニング)」と「推論(インファレンス)」です。

トレーニングとは、AIモデルが膨大なデータを学習する段階です。ここでは、膨大な計算を同時並行で処理する能力——いわゆる「並列処理」——が求められます。NvidiaのGPU(グラフィックス処理ユニット)はこの分野で圧倒的な強さを誇り、同社の急成長を支えてきました。

一方、推論とはAIモデルが実際にユーザーの質問に答える段階です。ChatGPTに「今日の天気は?」と聞けば、それは推論です。ここでは並列処理よりも「いかに速く、いかに安く答えを出すか」が重要になります。そして今、AIが日常に浸透するにつれ、推論市場は急速に拡大しています。Nvidiaのデータセンター顧客にとって、推論こそが収益の源泉です。

Groqはまさにこの推論に特化したチップ「LPU(Language Processing Unit)」を開発したスタートアップです。同社の創業者Jonathan Ross氏は、かつてGoogleの初代TPU(テンソル処理ユニット)開発チームに参加していた人物。彼はGPUと競合するのではなく、推論という隙間市場を狙いました。

GroqのLPUが速い理由は、メモリの構造にあります。GPUが「HBM(高帯域幅メモリ)」をチップの隣に置くのに対し、LPUはより高速な「SRAM」をチップ上に直接搭載しています。これにより、文章を一語一語生成する推論処理で圧倒的な速度を実現しました。

AIブームはHBMの供給不足と価格高騰を招いており、これもGroq方式の優位性を高める要因の一つです。ちなみに、HBMを世界で供給する主要企業の一つはSKハイニックスとサムスン電子——韓国勢が握るこの市場構造も、推論チップ競争の地政学的な文脈を複雑にしています。

NvidiaはなぜGroqを「買収」せず「ライセンス」にしたのか

注目すべきは、NvidiaがGroqを完全買収しなかった点です。独占禁止法上の審査を避けるためとも言われており、契約は非独占的ライセンスという形を取っています。Groqは引き続き独自の推論クラウドサービスを運営しています。

しかし、最も重要な資産は人材でした。Ross氏は現在、Nvidiaのチーフソフトウェアアーキテクトに就任しています。

NvidiaのCEOJensen Huang氏は2月の決算説明会で、この動きを**6年前のMellanox買収**になぞらえました。ネットワーク機器メーカーだったMellanoxの買収は当初、懐疑的に見られていましたが、今やNvidiaのAIデータセンター事業の根幹を支えています。直近の四半期だけで、Nvidiaのネットワーク部門は約110億ドルの売上を計上——これはAMD全社の売上とほぼ同規模です。

「Mellanoxでアーキテクチャを拡張したように、Groqでも同じことをする」とJensen氏は語っています。

Ross氏自身もNvidia入社前のインタビューで、両者の補完関係を示唆していました。「私たちのLPUはGPUよりはるかに高速なので、モデルの一部をLPUで動かし、残りをGPUで動かす実験をしたことがある。GPUの速度が上がり、コスト効率も改善した」——この発言が、今週のGTCでどんな製品として結実するか、業界の視線が集まっています。

日本企業にとっての意味

推論チップ競争の激化は、日本の産業界にも無縁ではありません。

まず、ソフトバンクグループ。孫正義氏はNvidiaとの深い関係を持ち、AIインフラへの巨額投資を続けています。推論市場が拡大すれば、ソフトバンクが投資するAIデータセンター事業の収益モデルにも影響します。

次に、製造業とAI活用です。トヨタやソニーをはじめとする日本の大手メーカーは、工場の自動化や製品開発にAIを活用し始めています。推論チップが安価・高速になれば、現場でのリアルタイムAI処理——エッジコンピューティング——が加速し、日本の製造現場のDXに直結します。

さらに、少子高齢化が進む日本では、労働力不足を補う手段としてAIへの期待が大きい。推論コストが下がれば、中小企業でもAI活用の敷居が下がります。

一方で、懸念もあります。Nvidiaが推論市場でも支配力を強めれば、チップの調達先が一社に集中するリスクが高まります。日本の経済安全保障の観点から、半導体サプライチェーンの多様化は引き続き重要な課題です。

関連記事

MetaがAmazonのGravitonチップを採用。年間売上高200億ドル超のAWSチップ事業が示す、AI半導体市場の新たな勢力図とは。日本企業への影響も含めて考察します。

米軍がイラン船舶を拿捕し、ホルムズ海峡の緊張が再燃。原油価格上昇と株式市場の下落が同時進行する中、日本経済・家計への波及効果を多角的に読み解く。

AIブームでNvidiaの収益の91.5%がデータセンター向けに。ゲーミングGPUの新世代が2026年に登場しない可能性があり、30年来のゲーマーとの絆に亀裂が入っています。日本市場への影響も含め多角的に分析します。

2026年、AIチップスタートアップへの投資が83億ドルを突破。GPU一強時代に終止符を打てるか?推論特化チップが変える半導体産業の構図と日本企業への影響を読む。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加