Metaが自社チップ4種を公開——Nvidiaへの依存から脱却なるか

Metaが独自開発のAIチップ「MTIAシリーズ」4種を発表。台湾積体電路製造(TSMC)が製造を担い、データセンター拡張と供給リスク分散を狙う。日本の半導体・AI産業への影響を読み解く。

毎月数百億円規模のNvidia製GPUを買い続けることが、果たして持続可能なのか——Metaの幹部たちは、その問いに対する答えを静かに形にしてきました。

2026年3月、Metaは独自開発のAIアクセラレーターチップ「MTIA(Meta Training and Inference Accelerator)」シリーズの新世代として、4種類のチップを一挙に公開しました。すでに数週間前から実際のデータセンターに導入済みの「MTIA 300」を皮切りに、「MTIA 400」「MTIA 450」「MTIA 500」が順次展開される予定です。約6ヶ月ごとに新チップを投入するという異例のペースで、同社のエンジニアリング担当副社長、Yee Jiun Song氏はCNBCに対し「これほど速いリリースサイクルを持つシリコンチームは珍しい」と語っています。

なぜ今、Metaは自社チップに本気を出すのか

背景にあるのは、AI投資の加速と、それに伴うコスト・供給リスクの増大です。

Nvidia製GPUは現在もAIインフラの中核を担っていますが、その価格は高騰し、供給も逼迫しています。Metaは直近の数週間だけで、Nvidiaから数百万基のGPUを購入する契約を結び、さらにAMDのGPUについても最大6ギガワット分を複数年にわたって調達する契約を締結しています。それでもなお、自社チップの開発を進める理由をSong氏はこう説明します。「シリコンの供給源を多様化することで、価格変動からある程度身を守ることができる。これは私たちにとって、より大きな交渉力を意味する」。

MTIAシリーズは、汎用型の高性能GPUとは異なる「ASIC(特定用途向け集積回路)」と呼ばれる設計思想に基づいています。GPUより小型・安価である反面、対応できるタスクは限定的です。MTIA 300はFacebookやInstagramのコンテンツ推薦・広告配信といった「ランキングと推薦」タスク向けに最適化されており、MTIA 400以降は画像・動画生成などの生成AIの推論処理を担います。ただし、GPT-4やLlamaのような巨大言語モデルの学習には使用しない、とSong氏は明言しています。

製造を担うのはTSMC(台湾積体電路製造)です。Metaはチップをアリゾナ州の新工場で製造するかどうかについてはコメントを避けましたが、チップ開発に携わる数百人規模のエンジニアの大多数は米国内に在籍しており、30か所のデータセンターのうち26か所が米国内に立地しています。

懸念材料もあります。生成AIの推論処理には大量の「HBM(高帯域幅メモリ)」が必要ですが、業界全体でHBMの供給不足が深刻化しています。Song氏は「HBMの供給には絶対に気を配っている」と認めつつも、「計画している構築に必要な供給は確保できていると考えている」と述べました。Samsung、SK Hynix、Micronといったメモリメーカーとの長期契約の有無については明言を避けています。

日本の半導体・AI産業への影響

この動きは、日本にとって対岸の火事ではありません。

TSMCが熊本県に建設した工場(JASM)は、すでに稼働を開始しており、第2工場の建設も進んでいます。Metaのような大手テック企業が独自チップの製造量を増やせば、TSMCの製造キャパシティをめぐる競争は一層激しくなります。日本国内の自動車・産業機器向け半導体と、AIアクセラレーター向け先端半導体では製造プロセスが異なるため、直接的な競合は限定的ですが、TSMCの優先順位の変化は日本のサプライチェーン全体に間接的な影響を与え得ます。

一方、ソニーやキオクシアといった日本のメモリ・センサー企業にとっては、HBM需要の拡大は追い風になる可能性があります。ただし、HBM市場では現在SK Hynixが圧倒的なシェアを持ち、Micronが追い上げている状況で、日本勢の存在感は限定的です。

より長期的な視点では、Metaのようなプラットフォーム企業が独自のAIインフラを内製化することで、AIサービスの「垂直統合」が加速します。これは、外部のAIクラウドサービスを利用して新たなビジネスを構築しようとしている日本のスタートアップや中堅企業にとって、依存するプラットフォームの構造が根本から変わるリスクを意味します。

「内製化」という選択の意味

Googleは2015年に独自チップ「TPU(Tensor Processing Unit)」を初めて導入し、Amazonは2018年に自社チップを発表しました。Metaはこの流れに乗り遅れた形ですが、今回の4種一挙公開と6ヶ月サイクルという積極的な姿勢は、その差を急速に埋めようとする意志の表れです。

しかし、内製化には限界もあります。MetaのMTIAは、あくまで同社の特定ワークロードに最適化されたチップであり、汎用性という点ではNvidiaのH100やB200シリーズには及びません。Song氏自身も「ワークロードが非常に速く変化しているため、あらゆる選択肢を持ちたい」と述べており、NvidiaやAMDとの大型契約と自社チップ開発を並行して進めるという、ハイブリッド戦略を採っています。

これは、一つの企業の調達戦略の変化ではなく、AIインフラにおける「権力の分散」の始まりかもしれません。かつてはサーバーメーカーに依存していた企業が自社でサーバーを設計し始めたように、今やチップそのものを内製する時代が来ています。

関連記事

MetaがAmazonのGravitonチップを採用。年間売上高200億ドル超のAWSチップ事業が示す、AI半導体市場の新たな勢力図とは。日本企業への影響も含めて考察します。

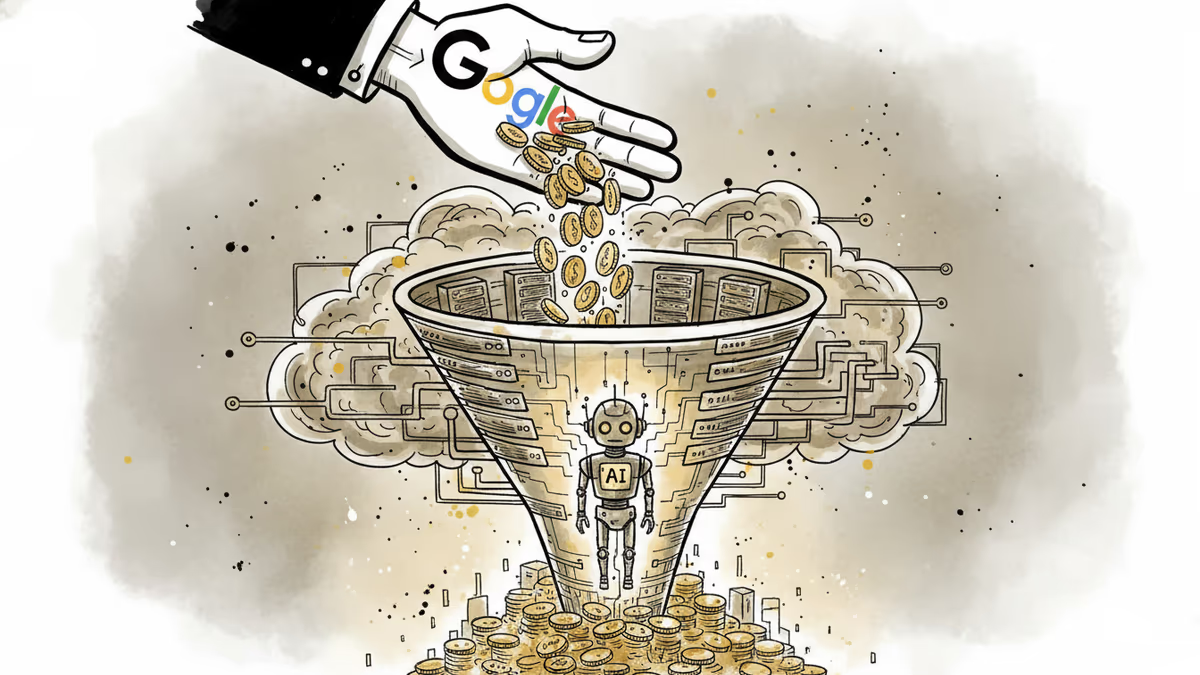

GoogleがAnthropicへの財務支援を拡大。AI計算インフラをめぐる巨大テック企業の戦略的投資が加速する中、日本企業や投資家にとっての意味を読み解く。

米軍がイラン船舶を拿捕し、ホルムズ海峡の緊張が再燃。原油価格上昇と株式市場の下落が同時進行する中、日本経済・家計への波及効果を多角的に読み解く。

AIブームでNvidiaの収益の91.5%がデータセンター向けに。ゲーミングGPUの新世代が2026年に登場しない可能性があり、30年来のゲーマーとの絆に亀裂が入っています。日本市場への影響も含め多角的に分析します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加