AIの隠れたコスト:メモリチップが7倍高騰、次世代データセンターの新常識

DRAM価格が1年で7倍上昇。AI推論コストを左右するメモリ管理技術の重要性が急浮上。プロンプトキャッシュ最適化が企業の生死を分ける時代に。

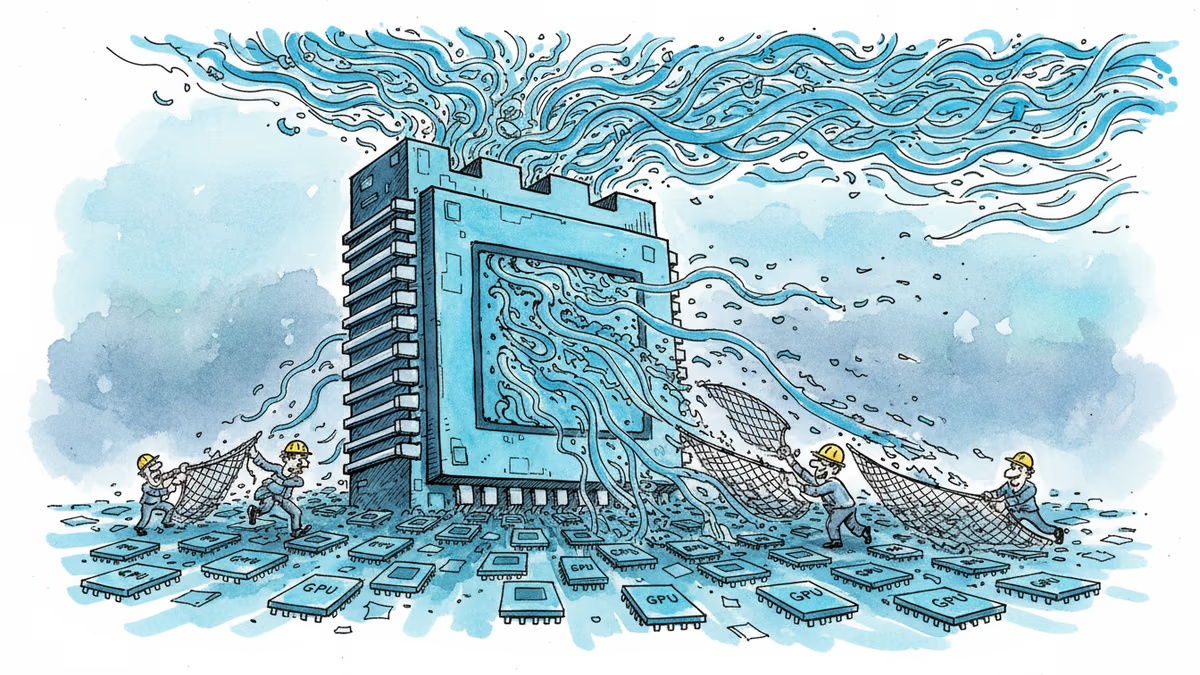

AIインフラのコストといえば、誰もがNVIDIAのGPUを思い浮かべる。しかし、7倍という驚異的な価格上昇を見せているのは、実はメモリチップの方だ。

GPU以上に重要になったメモリの存在

過去1年間で、DRAMチップの価格は約7倍に跳ね上がった。ハイパースケーラーが数十億ドル規模の新データセンター建設を進める中、メモリが新たなボトルネックとして浮上している。

半導体アナリストのDan O'Laughlin氏とWekaのAI責任者Val Bercovici氏の対談から見えてくるのは、単純にメモリを増やせば済む話ではないという現実だ。重要なのは「適切なデータを、適切なエージェントに、適切なタイミングで届ける」オーケストレーション技術である。

Anthropicのプロンプトキャッシュ価格設定ページの変化が、この複雑さを物語っている。半年前は「キャッシュを使えば安くなる」という単純なメッセージだったページが、今では「何回のキャッシュ書き込みを事前購入すべきか」の詳細なガイドブックに変貌した。

5分か1時間か:キャッシュ管理の経済学

現在、Claudeでは5分間または1時間のキャッシュウィンドウを選択できる。キャッシュに残っているデータを使う方が遥かに安いため、適切に管理すれば大幅なコスト削減が可能だ。

ただし、新しいデータをクエリに追加するたびに、既存のデータがキャッシュから押し出される可能性がある。この複雑なパズルを解くことが、AI企業の競争力を左右する時代になった。

TensorMeshのようなスタートアップは、キャッシュ最適化という新しい技術領域で解決策を模索している。データセンター内の異なるメモリタイプ(DRAMとHBMの使い分け)から、エンドユーザーのモデル群による共有キャッシュ活用まで、最適化の機会は多層に渡って存在する。

日本企業への示唆:ソフトバンクからソニーまで

日本の視点から見ると、この変化は特に興味深い意味を持つ。ソフトバンクのARM買収戦略や、ソニーのイメージセンサー事業、さらにはキオクシア(旧東芝メモリ)の立ち位置にも影響を与える可能性がある。

日本企業の強みである「カイゼン」の思想は、まさにこのメモリ最適化の世界で威力を発揮するかもしれない。継続的改善によってメモリ効率を1%ずつ向上させることが、AI推論コストの大幅削減につながる。

関連記事

UAEがOPECを離脱し、年間610億ドル超の増収をAIインフラ投資に振り向ける。エネルギーと資本と地政学が交差する新たな構図を読み解く。

SpaceXとAnthropicの15兆円規模のコンピュート契約が明らかに。AI開発の「インフラ戦争」が激化する中、日本企業はどう生き残るのか。

AI持続可能性研究者サーシャ・ルッチョーニが新団体を設立。ChatGPTの検索1回分のエネルギーは?大手AI企業が情報を隠す構造的理由と、日本企業が今すぐ問うべき問いを解説。

イーロン・マスク氏のxAIがミシシッピ州のデータセンターで約50基の天然ガスタービンを無規制で稼働。地域住民への大気汚染問題と、AI産業の急速な電力需要が引き起こす環境コストを多角的に検証します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加