AI隠れ使用で企業が直面する「見えないリスク」

従業員の47%がAIを不適切に使用、63%が他の社員の不適切使用を目撃。シャドウAIが企業に与える真のリスクとは?

47%の専門職従業員がAIを職場で不適切に使用し、63%が他の同僚の不適切使用を目撃している。メルボルン大学とKPMGの最新調査が明らかにしたこの数字は、日本企業にとって決して他人事ではない。

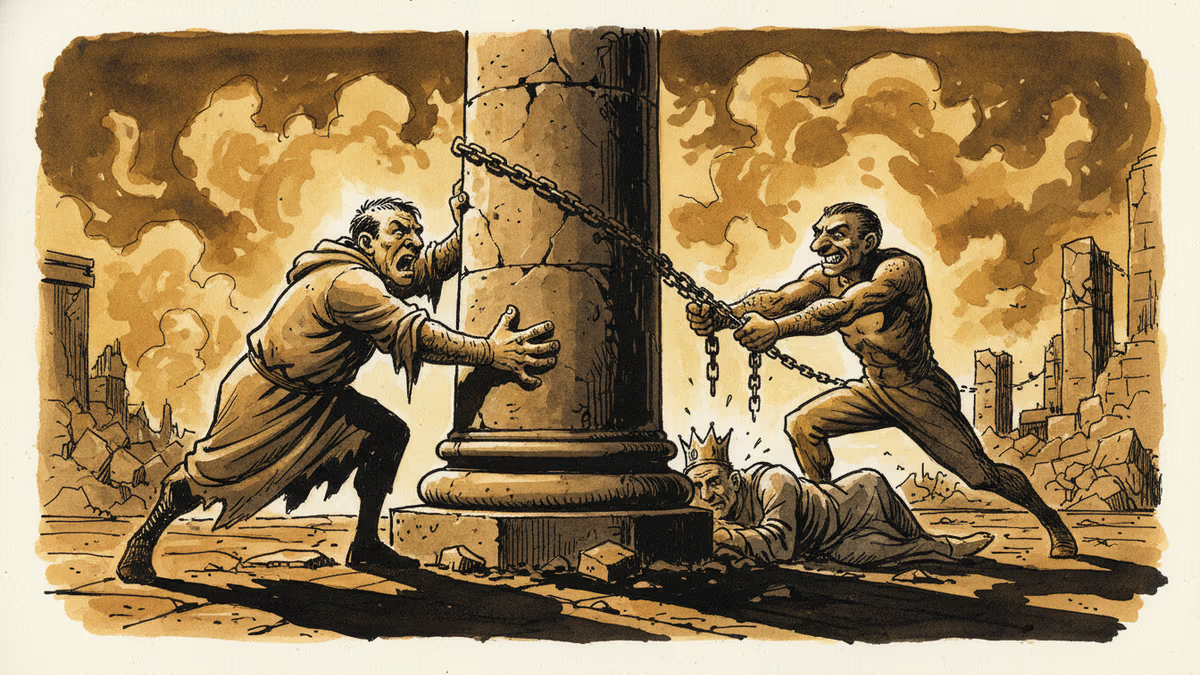

「シャドウAI」という新たな脅威

問題の核心は「シャドウAI」と呼ばれる現象だ。従業員が会社の承認なしに、あるいは不適切な方法でAIツールを使用することを指す。具体例を見ると、社内の人事評価テストでAIを使用したり、機密情報を第三者のAIプラットフォームに入力したりするケースが報告されている。

AIガバナンス専門家のザーラ・ティムサ氏は「AIが登場する前は、質の低い仕事を隠すのは困難でした。今では従業員が数分で洗練されたレポートを生成でき、管理者は能力があると思い込んでしまいます」と指摘する。

日本企業が直面する現実

調査データをさらに詳しく見ると、深刻な実態が浮かび上がる:

- 44%の米国労働者が適切な許可なしにAIツールを使用

- 46%が機密情報や知的財産を公開AIプラットフォームにアップロード

- 57%がAIの無制限使用により業務でミスを犯している

- 53%がAI使用を完全に隠蔽し、AI生成コンテンツを自分の作品として提示

日本の労働文化では「報告・連絡・相談」が重視されるが、この調査結果は従業員が上司に相談せずにAIを使用している現実を示している。特に、終身雇用制度や年功序列が根強い日本企業では、新技術への適応に世代間格差が生じやすく、シャドウAIの問題がより複雑化する可能性がある。

企業が取るべき対策

明確なガイドライン策定

専門家は、企業が承認済みの内部AIツールを提供し、一つの明確なルールを設定することを推奨している:「機密情報や規制対象情報を公開AIシステムに入力してはならない」。

人的監督の強化

AI分析チームを設置し、事業の将来にとって重要なデータタイプのアクセス権限を見直すことが必要だ。また、何かが公開される前に必ず人間が関与する仕組みを構築すべきである。

実践的な教育訓練

曖昧なポリシーではなく、実践的な例を用いた社内研修に焦点を当てるべきだ。「汎用的なメールの書き直しにAIを使用するのは問題ない。しかし、顧客契約書や財務データ、独自情報を公開AIツールにアップロードするのは適切ではない」といった具体的な指針が重要である。

法的リスクへの対応

従業員のAI誤用は、意図と害が存在する場合に法的問題となる。これには機密データの漏洩、知的財産の盗用、財務情報の操作、AIを使った詐欺などが含まれる。

雇用法の観点では、一貫性が鍵となる。あるAI誤用で従業員を解雇し、別の従業員を処分しない場合、差別や報復の責任問題が生じる可能性がある。

関連記事

SKハイニックスが時価総額1兆ドルを突破。サムスン電子に続き韓国勢2社が同時に1兆ドルクラブ入り。AI半導体需要がコスピ指数を牽引する構造的変化と、日本市場への影響を読み解く。

6月8日開幕のWWDC 2026を前に、AppleとGoogleの提携によるSiri刷新への期待が高まる。株価は8週連続で上昇し最高値圏に。AI戦略の転換が投資家と利用者に何をもたらすか。

AIが量子コンピュータの開発を加速させ、現在のブロックチェーンやインターネットの暗号化技術が近い将来破られる可能性が高まっている。日本企業と個人にとっての意味を深く掘り下げる。

中国の人型ロボット訓練センターでは、元美術教師が工場作業をロボットに教えている。北京が国家戦略として推進するヒューマノイドロボット産業の実態と、日本社会への示唆を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加