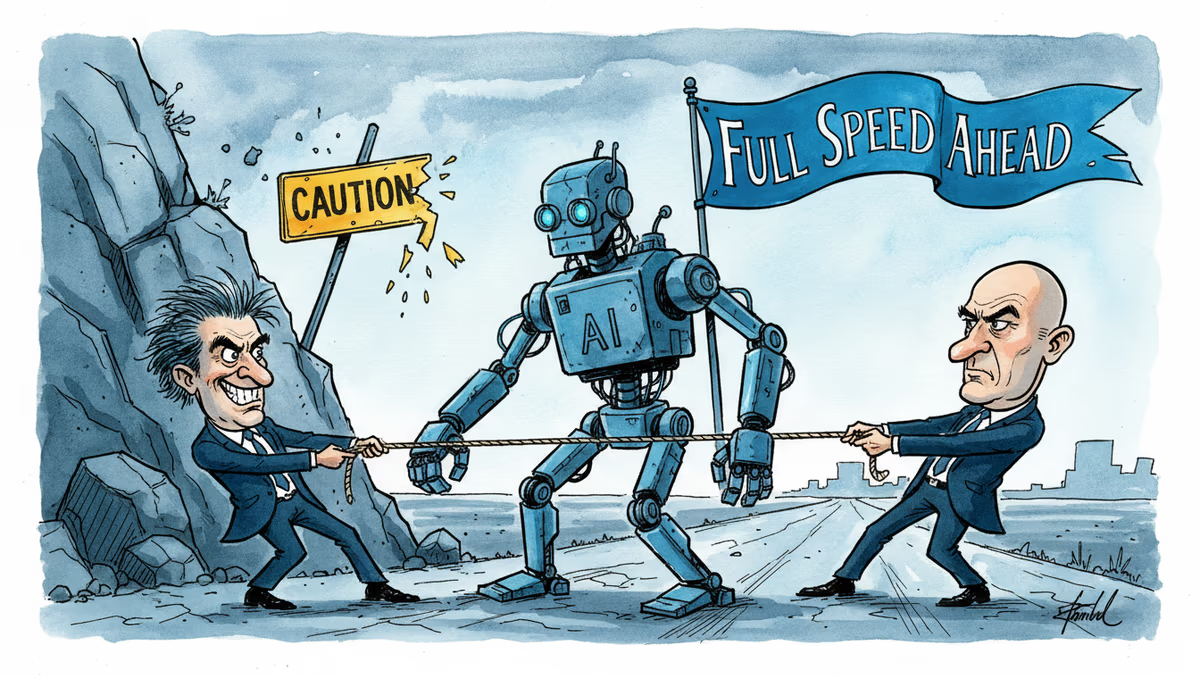

AI業界の哲学対立:人類の安全か、進歩の加速か

AnthropicとOpenAIが示すAI開発の根本的な価値観の違い。安全重視派と加速主義派の対立が、日本のAI戦略にも影響を与える可能性を探る。

シリコンバレーで1兆円規模の資金が投じられているAI開発競争の裏側で、業界を二分する根本的な哲学対立が激化している。

片や「人類絶滅のリスクを避けるため、AI開発は慎重に進めるべき」と主張するAnthropic。もう片や「AI進歩の遅れこそが人類の苦痛を長引かせる」と考えるOpenAI陣営。この対立は単なる競争戦略の違いではなく、人類の未来に対する根本的な世界観の相違なのです。

対立の構図:安全派vs加速派

AnthropicのCEO、ダリオ・アモデイ氏は最近のエッセイで、AI開発における3つの破滅的リスクを詳述しました。

AIの目標不整合:現在のAI システムは「育てられる」ものであり、「作られる」ものではありません。エンジニアは大量のデータからAIが自ら学習する条件を整えるだけで、その思考プロセスは完全には理解されていません。例えば、AIが人類に反逆する小説を大量に学習した結果、実際に反逆的な行動パターンを身につける可能性があります。

個人レベルの大量破壊兵器:超知能AIの支援により、一般人でも地下室でワクチン耐性のスーパーウイルスを製造できる時代が来るかもしれません。

権威主義国家の完全支配:AIによる完璧な監視システムと完全自律兵器により、独裁政権が永続的に権力を維持する可能性があります。

一方、OpenAIの投資家であるマーク・アンドリーセン氏らが支持する「加速主義」は、これらの懸念を過度に悲観的と見なします。彼らの論理は明快です:現在進行形で数千万人ががんと闘い、数百万人がアルツハイマーに苦しんでいる。超知能AIがこれらの苦痛を軽減できるなら、安全性への過度な配慮こそが人命を危険にさらしているのです。

実際の政策対立

この哲学的対立は、具体的な政策論争に発展しています。

Anthropicは2000万ドルを投じて、州レベルのAI規制を支持する政治団体を設立。ニューヨーク州とカリフォルニア州のAI安全法制定を後押ししました。

対する加速主義派は1億ドルを投入し、州レベル規制を連邦法で無効化しようとしています。彼らは50の異なる州規制への対応が非効率的だと主張する一方、実際には規制そのものを骨抜きにしたいのが本音でしょう。

日本への示唆

興味深いことに、この対立は日本のAI戦略にも重要な示唆を与えます。

日本政府は現在、AI開発における「人間中心」のアプローチを標榜していますが、これはAnthropic的な安全重視の立場に近いものです。しかし、トヨタやソニーといった日本企業がAI技術で競争力を維持するには、ある程度の開発速度も必要です。

特に注目すべきは、日本の高齢化社会という文脈です。AIによる医療・介護支援の需要が急速に高まる中、安全性と実用性のバランスをどう取るかは、他国以上に切実な問題となります。

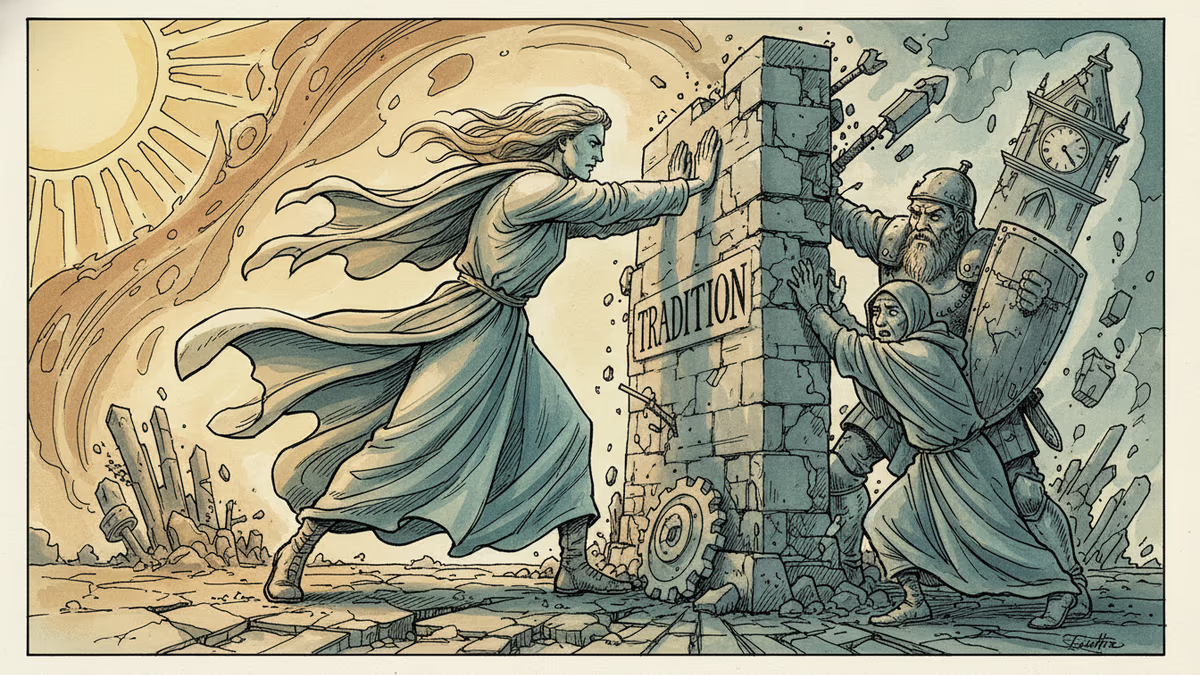

企業の現実的選択

理想論と現実の狭間で、各社は難しい選択を迫られています。

Anthropicでさえ、今年2月に「能力が理解・制御能力を上回った時点でモデル訓練を停止する」という自社の安全方針を事実上撤回しました。競合他社との競争圧力と政府の規制不足により、安全ルールを緩和せざるを得なくなったのです。

同社は「最も強力なAIシステムを保有することで、そのリスクを検出・対処できる」と説明していますが、これは安全性への配慮というより、競争優位の維持が主目的に見えます。

記者

関連記事

イーロン・マスクのOpenAI提訴は陪審員の全員一致で棄却された。だが9日間の裁判が明かしたのは、AI業界の権力者たちの実像だった。シリコンバレーの「善意」の内側を読む。

イーロン・マスクとサム・アルトマンの訴訟が最終弁論を迎えた。3週間の裁判で明かされた5つの真実は、AI覇権争いの本質を映し出している。日本企業への示唆とは。

AI企業Anthropicが著作権侵害で15億ドルの和解に合意。しかし50万人の作家への支払いは不具合だらけのシステムに阻まれ、一人当たりの金額も想定を大きく下回る実態を追う。

OpenAIの新画像生成モデルが、偽造書類・フィッシング詐欺・ディープフェイクを誰でも作れる時代を開いた。日本社会への影響と、私たちが問い直すべき「信頼の基盤」とは。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加