あなたの「分身」が、あなたの知らない場所で働いている

AI文章ツールGrammarlyが著名ジャーナリストの名前と個性を無断使用。集団訴訟に発展したこの事件は、AIが「人格」をどう扱うべきかという根本的な問いを突きつけています。

あなたが長年かけて築いてきた「名前の価値」を、あなたに一言も断らずに、他社が商品として売っていたとしたら?

何が起きたのか:AIが「著名人の分身」を勝手に作った

文章校正ツールとして世界中で使われている Grammarly を運営する Superhuman 社が、集団訴訟を起こされました。2026年3月、ニューヨーク南部地区連邦裁判所に提出されたこの訴訟の原告は、調査報道ジャーナリストの Julia Angwin 氏。彼女はテクノロジーが社会に与える影響を専門に取材する非営利メディア「The Markup」の創設者でもあります。

問題となったのは、Grammarlyが導入した「Expert Review(専門家レビュー)」という機能です。ユーザーが文章を入力すると、スティーブン・キング や ニール・ドグラース・タイソン、そして Angwin 氏といった実在の著名な作家・ジャーナリスト・学者が、あたかも直接アドバイスをしているかのように編集提案を行う——そういう仕組みでした。ただし、これらの人物は誰一人、この機能への参加に同意していませんでした。

AIが実際に行っていたのは、対象人物の過去の著作物を大規模言語モデルで学習し、その「語り口」や「視点」を模倣することでした。ツールには「これらの人物は本製品を推薦・開発に参加していない」という免責事項が小さく記載されていましたが、実際の画面上では、あたかも本人が語りかけているような体験を提供していました。

訴状は損害賠償額を具体的に指定していませんが、原告クラス全体での損害が500万ドル(約7億5000万円)以上に上ると主張しています。ニューヨーク州とカリフォルニア州には、本人の同意なく商業目的で氏名・肖像を使用することを禁じる法律が存在しており、原告側弁護士の Peter Romer-Friedman 氏は「法的には比較的明快なケース」と述べています。

Angwin 氏自身は、自分の「デジタル分身」が出すアドバイスの質にも驚いたと言います。「単調なものではなかった。実際には文章をより悪くするようなアドバイスだった」と彼女はWIREDに語っています。シンプルな一文をより長く複雑に書き直すよう提案したり、本文とは関係のないテーマを展開するよう勧めたりと、「非常に散漫な印象だった」と振り返ります。

訴訟が提起される直前、Superhuman 社はすでにこの機能の停止を発表していました。同社プロダクト管理ディレクターの Ailian Gan 氏は「専門家が自分の表現方法を真に管理できるよう、機能を再考するために無効化した」と述べ、CEOの Shishir Mehrotra 氏もLinkedInで「専門家から受けた批判的フィードバックは正当だった」と認めました。

なぜ今、これが重要なのか

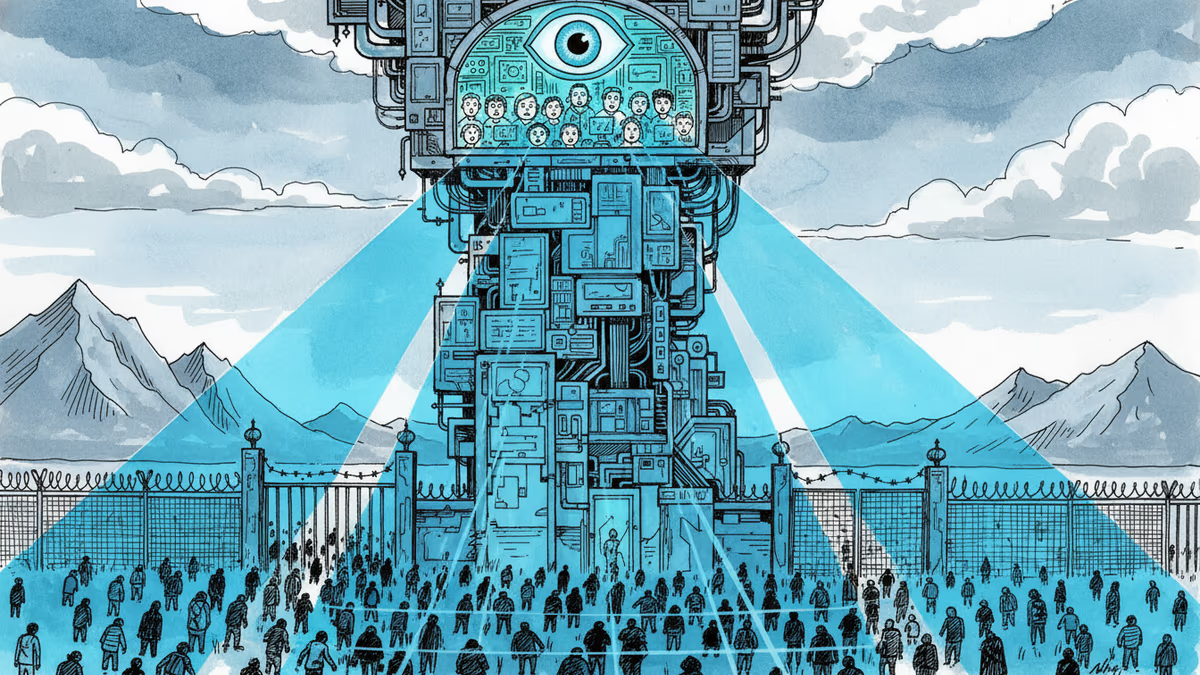

この事件が起きたタイミングは偶然ではありません。AIツールが急速に普及する中、「誰の知識や個性を学習データとして使ってよいのか」という問いは、業界全体が避け続けてきた課題です。

これまでの著作権論争の多くは、「テキストや画像そのもの」の無断使用に焦点を当ててきました。しかし今回の訴訟が問うているのは、より深いレベルの問題です——人格そのもの の商業利用です。Angwin氏の文章スタイルや視点を学習したAIが、彼女の「名前」を冠して別の人の文章を評価する。これは著作権侵害とは異なる、パブリシティ権(氏名・肖像の商業利用に関する権利)の問題として争われています。

日本にとって、この問題は決して対岸の火事ではありません。日本でも Grammarly は広く使われており、英文ライティングのビジネス場面での普及は著しい。しかしより本質的な問いは、日本の法制度がこうした「AIによる人格の商業利用」にどこまで対応できるか、という点です。

日本には現時点で、パブリシティ権を明文化した法律はなく、判例法に依拠しています。2012年の最高裁判決(いわゆる「ピンク・レディー事件」)でパブリシティ権の法的根拠が確立されましたが、AI時代の「デジタル分身」にそれが適用されるかは未解決のままです。

異なる立場から見えるもの

Superhuman 社の立場から見れば、この機能は「思想的リーダーの知見をユーザーに届ける」という善意のプロダクトデザインだったと言えるかもしれません。実際、免責事項も付けていました。しかし問題は、技術的な「正確さ」ではなく、ユーザーが受け取る「体験」です。画面上で著名人の名前が表示され、その人物の語り口でアドバイスが届けば、多くのユーザーは本人の関与を想定するでしょう。

一方、クリエイターや専門家の立場では、この事件は「スキルの収奪」という文脈で語られています。弁護士の Romer-Friedman 氏が指摘するように、何年・何十年もかけて磨いた専門性が、本人の同意なくAI製品の「付加価値」として使われることへの根本的な不満がそこにあります。

消費者の視点はより複雑です。もし「著名な編集者のスタイルで文章をチェックしてもらえる」機能が本当に高品質なものであれば、多くのユーザーはそれを便利と感じるでしょう。しかし今回の事例では、Angwin氏の分身が出したアドバイスの質は低く、むしろ本人のブランドイメージを傷つける可能性もありました。

日本企業への示唆も見逃せません。ソニー や 富士通、あるいは多くのスタートアップが独自のAIライティング支援ツールを開発・検討している中、「実在の専門家の名前やスタイルを学習・活用すること」のリスクは、製品設計の段階から組み込まれるべき問いになりつつあります。

関連記事

イーロン・マスクがOpenAIとサム・オルトマンを訴えた裁判が開廷。非営利から営利へのシフトは許されるのか。AI業界の未来を左右する法廷闘争の本質を読み解く。

OpenAIはカナダ銃乱射事件の容疑者アカウントを事前に把握・停止していたにもかかわらず、警察への通報を見送った。CEOサム・アルトマンが謝罪したが、問われるのは企業の「判断」の是非だ。

トランプ政権の移民取締りを支えるAI企業Palantir。元社員が「ファシズムへの転落」と表現した内部告発の背景と、テクノロジー企業の倫理的責任について考える。

MozillaがAnthropicのAIで271件の脆弱性を修正、北朝鮮ハッカーがAIでマルウェア開発、SS7通信プロトコル悪用と続く2026年のサイバーセキュリティ最前線を解説します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加