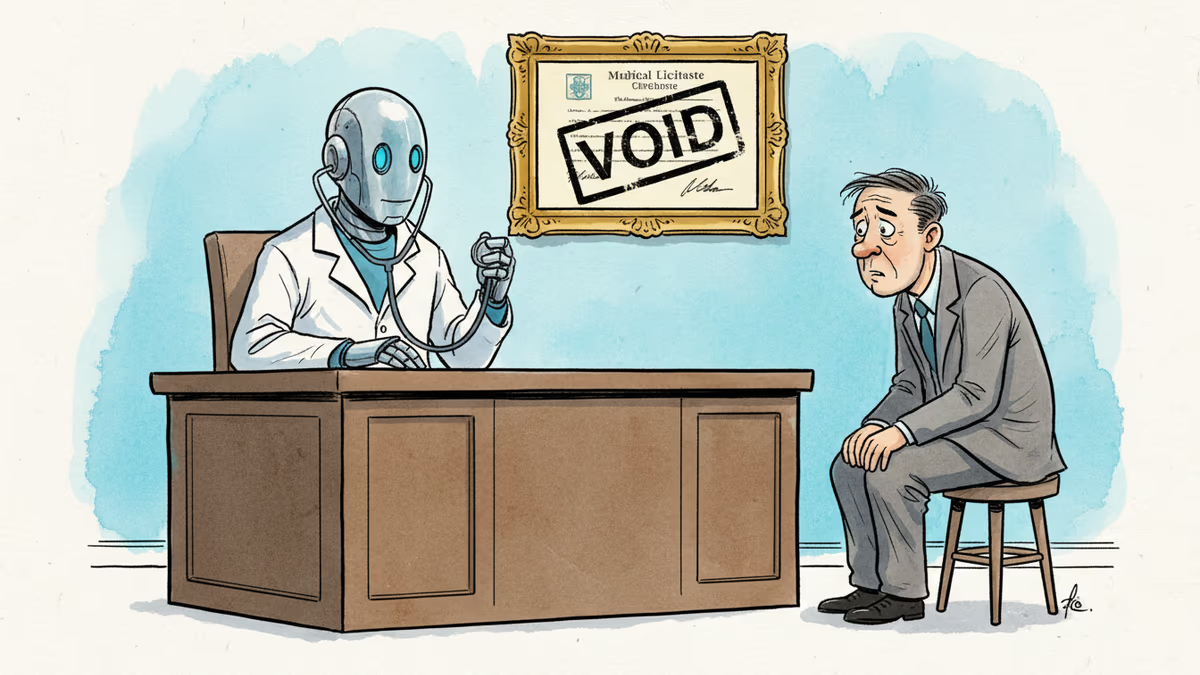

AIが書いた政策文書――政府はなぜ気づけなかったのか

南アフリカがAIハルシネーションを含む国家AI政策草案を撤回。過去2年で5件の政府文書汚染事例を検証し、制度的検証プロセスの欠如が招くリスクを考察する。

存在しない論文が、国家の政策文書に堂々と掲載されていた。

2026年4月、南アフリカは「国家人工知能政策草案」を公表した。アフリカ大陸で初めてAI倫理委員会の設置を定める文書として、歴史的な一歩になるはずだった。ところが公表からわずか17日後、政府はその文書を静かに撤回した。理由は、参考文献の少なくとも6件(全67件中)が実在しない架空の論文だったからだ。市民権団体「Article One」の指摘を受けた調査で、複数の学術誌が「完全に架空」であることが判明した。

ソリー・マラッチ通信・デジタル技術大臣は声明でこう認めた。「最も合理的な説明は、AIが生成した引用が適切な検証なしに含まれたことだ」。そして「文書の起草と品質保証に責任を持つ者への対処を行う」と付け加えた。

「初めて」ではない――繰り返される構造的失敗

政府がAIハルシネーションを理由に文書を撤回したのは、記録上これが初めてだ。しかし、AIが生成した誤情報が公式文書に紛れ込んだ事例は、過去2年で少なくとも4件確認されている。

2025年5月、トランプ政権の「子どもの健康に関するMAHA報告書」に、存在しない研究が複数引用されていた。ワシントン・ポスト紙は、URLに「oaicite」という文字列が含まれていることを発見した――これはChatGPT使用の痕跡とされるマーカーだ。ホワイトハウス報道官のカロライン・レビット氏は「フォーマットの問題」と一蹴し、数時間後に修正版が公開された。

オーストラリアでは、雇用・職場関係省が委託したデロイトのレポートに架空の学術引用と捏造された引用文が含まれていたことが判明。デロイトは29万豪ドル(委託費44万豪ドルの約66%)を政府に返金した。カナダでも同社が作成した120万カナダドル規模の医療報告書に同様の問題が発覚し、修正版が再公表された。

そして欧州。EUのサイバーセキュリティ機関ENISAは、2025年に公表した2本の脅威レポートにAIハルシネーションが含まれていたと認めた。1本のレポートだけで、492件の脚注のうち26件が誤りだったという。予算2700万ユーロを持つ機関でさえ、検証プロセスの穴を塞げなかった。

AI法・データ倫理研究者のキアラ・ガレーゼ氏はLinkedInでこう断じた。「ENISAはAIに、絶対に無防備なまま触れさせてはならない層――真実の層――を触らせてしまった。問題はスキルではない。プロセスだ。必須の検証ステップがない。出典確認がない。AI使用に関する明確なルールがない。あるのはスピードと利便性と、デフォルトの信頼だけだ」。

なぜ今、これが重要なのか

日本にとって、これは遠い国の話ではない。

日本政府は2023年以降、AI活用推進の方針を明確にし、各省庁での生成AI導入を積極的に進めてきた。内閣府や経済産業省はすでに業務効率化のためのAIツール活用ガイドラインを策定しているが、「出力の事実確認」に関する具体的な義務規定は、まだ十分に整備されているとは言えない。

労働力不足という構造的な問題を抱える日本では、AIによる文書作成の効率化への誘惑は特に強い。地方自治体でも、人手不足を補うためにAIを活用した行政文書の草案作成が試みられ始めている。しかし今回の一連の事例が示すのは、AIの導入速度と、それを検証するプロセスの整備速度が、深刻にアンバランスになっているという現実だ。

デロイトの事例が示すもう一つの教訓は、問題が民間委託にも及ぶという点だ。政府がコンサルティング会社に政策立案や調査を外注する慣行は日本でも一般的だが、委託先がAIを使用するかどうか、どのように使用するかを契約上明示させる仕組みは、カナダが今回の事件を受けて導入したように、日本でも検討に値する。

「信頼のデフォルト」という罠

これらの事例に共通するのは、技術の失敗ではなく、プロセスの失敗だ。

AIハルシネーションは既知の現象だ。現在の大規模言語モデルは、存在しない情報を自信を持って生成することがある。問題は、それを使う人間の側が「AIが書いたのだから正確だろう」という暗黙の前提を持ってしまうことにある。専門家たちが懸念しているのは、AIの使用そのものではなく、AIに「認識論的権威」を与えてしまうことだ――つまり、AIの出力を事実の出発点として扱うのではなく、事実そのものとして扱ってしまう態度だ。

南アフリカの事例が特に皮肉なのは、AI倫理を定めようとした文書そのものが、AI倫理の失敗によって撤回されたことだ。規制を作る側が規制対象のリスクを体現してしまった。

一方で、「AI使用禁止」が答えではないことも明らかだ。デロイトはカナダ政府への報告書修正後も契約関係を維持し、カナダ政府は禁止ではなく「開示と評価の義務化」という方向を選んだ。EUのENISAも、AIの使用を止めるのではなく、検証プロセスの強化を求められている。

問題の核心は、AIを使うかどうかではなく、どのような制度的歯止めの下で使うかだ。

本コンテンツはAIが原文記事を基に要約・分析したものです。正確性に努めていますが、誤りがある可能性があります。原文の確認をお勧めします。

関連記事

メディア界の大物バリー・ディラー氏がWSJカンファレンスで語った。AI開発者への信頼より、誰も答えを知らない「未知の結果」こそが本当のリスクだと。AGI時代の本質的な問いを考える。

ペンシルベニア州がCharacter.AIを提訴。AIチャットボットが医師を偽ったとされる事件は、日本のAI規制や医療AIの信頼性にも深く関わる問題を提起している。

MITテクノロジーレビューが選んだ「今AIで本当に重要な10のこと」。ChatGPTの銃撃事件関与疑惑からAnthropicの危険モデル流出まで、AIが社会インフラとなりつつある今、私たちは何を問うべきか。

AnthropicのAIセキュリティモデル「Mythos Preview」を米NSAや商務省は活用しているのに、肝心のサイバーセキュリティ専門機関CISAはアクセスできていない。この逆説が示す米国のAI政策の実態とは。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加