AIは「真実」を学べるか――元Facebook報道責任者の挑戦

元Facebookニュース責任者キャンベル・ブラウン氏が設立したForum AIは、AIモデルが地政学・採用・金融などの複雑な問題をどう扱うかを評価する。AIと情報の信頼性をめぐる新たな問いを提示する。

AIチャットボットに質問すると、もっともらしい答えが返ってくる。だが、その答えは本当に正しいのだろうか。

キャンベル・ブラウン氏は、この問いを他人事として見過ごせなかった。テレビジャーナリストとして名を馳せ、Facebookでニュース部門の初代責任者を務めた彼女が、17ヶ月前にニューヨークで立ち上げたのがForum AIだ。ChatGPTが公開された直後、「これがすべての情報が流れる漏斗になる。そして、それはあまり良くない」と直感したことがきっかけだった。

Facebookで学んだ「失敗の教訓」

ブラウン氏がAIの情報問題に敏感なのには理由がある。彼女はFacebookで、エンゲージメント最適化がいかに社会に悪影響を与えるかを間近で見てきた。「私たちは多くのことで失敗した」と彼女は率直に語る。自身が構築したファクトチェックプログラムはすでに廃止されている。ソーシャルメディアが「見たいものを見せる」設計に傾いた結果、多くの人が以前より情報に疎くなったという苦い経験が、彼女の原動力になっている。

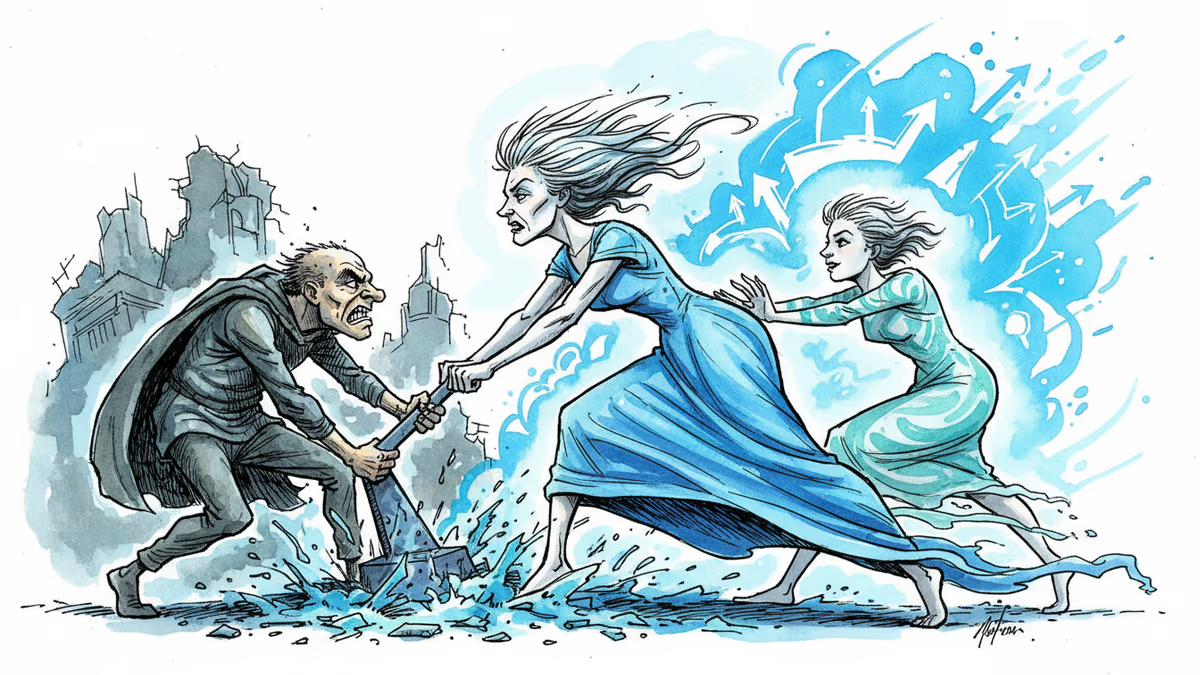

そして今、同じ過ちがAIの世界で繰り返されようとしているように見える。「基盤モデルを開発する企業はコーディングと数学に極めて集中している」とブラウン氏は指摘する。一方、ニュースや情報は「難しい」。だが、難しいからといって後回しにしていい問題ではない、というのが彼女の立場だ。

「90%合意」という基準線

Forum AIが取り組むのは、AIモデルを「ハイステークス・トピック」で評価することだ。地政学、メンタルヘルス、金融、採用といった、明確な正解のない、複雑で微妙なテーマが対象となる。

その評価方法はユニークだ。世界トップレベルの専門家を集め、彼らにベンチマークを設計させ、AIジャッジを訓練して大規模評価を行う。地政学分野では、ニール・ファーガソン氏、ファリード・ザカリア氏、元国務長官のトニー・ブリンケン氏、元下院議長のケビン・マッカーシー氏、オバマ政権でサイバーセキュリティを率いたアン・ノイバーガー氏らが参加している。目標は、AIジャッジが人間の専門家と約90%の合意率を達成することで、同社はすでにこの水準に到達したという。

実際の評価結果は厳しいものだった。Geminiが中国と無関係な記事に中国共産党系サイトを引用していること、ほぼすべてのモデルに左寄りの政治的偏向があること、文脈の欠落、視点の偏り、論点のわら人形化といった問題が確認されている。「まだ長い道のりがある」とブラウン氏は認めつつも、「簡単に修正できる点もある」と言う。

企業の「責任」がAIを変えるかもしれない

Forum AIのビジネスモデルが狙うのは、意外にも企業の「法的リスク管理」という需要だ。信用審査、融資、保険、採用にAIを使う企業は、誤った判断による訴訟リスクを抱える。「彼らは正確さを最適化してほしいと思っている」とブラウン氏は言う。

ただし、現在のコンプライアンス市場の実態は心もとない。ニューヨーク市が採用バイアスに関するAI監査を義務付ける法律を施行した際、州の会計検査院は違反の半数以上が検出されなかったと報告した。「コンプライアンスの現状は冗談のようなものだ」とブラウン氏は断言する。チェックボックスを埋めるだけの標準化されたベンチマークでは、エッジケースの問題を見逃す。「賢いゼネラリストでは通用しない」のだ。

同社は昨秋、Lerer Hippeau主導で300万ドルの資金調達を完了した。ただし、コンプライアンスへの関心を安定した収益に変えることは、まだ課題として残っている。

日本への視点:「正確さ」の市場価値

この問題は、日本にとって決して遠い話ではない。日本では高齢化と労働力不足を背景に、AIを採用審査や金融判断に活用する動きが加速している。トヨタやソニー、金融機関がAIを業務判断に組み込む場面が増える中、「AIが出した答えは正しいのか」という問いは、企業の信頼性と直結する問題になりつつある。

加えて、日本語コンテンツに対するAIの精度問題は、英語圏以上に深刻な可能性がある。多くの基盤モデルが英語データを中心に学習している中で、日本語の微妙なニュアンス、文脈依存性、敬語の扱いがどこまで正確に処理されているかは、まだ十分に検証されていない。

ブラウン氏が指摘するもう一つの構造的問題も日本社会に響く。「シリコンバレーでは一つの会話が、消費者の間では全く別の会話が起きている」という断絶だ。AI技術の「可能性」を語る企業と、実際にチャットボットで「スロップ(ゴミのような回答)」を受け取っているユーザーとの間の乖離は、日本でも同様に存在している。

本コンテンツはAIが原文記事を基に要約・分析したものです。正確性に努めていますが、誤りがある可能性があります。原文の確認をお勧めします。

関連記事

イーロン・マスク氏のxAIがミシシッピ州のデータセンターで約50基の天然ガスタービンを無規制で稼働。地域住民への大気汚染問題と、AI産業の急速な電力需要が引き起こす環境コストを多角的に検証します。

WhatsAppが新機能「Incognito Chat」を発表。MetaでさえユーザーのAI会話内容にアクセスできない設計とは何か。30億人が使うプラットフォームのプライバシー戦略を読み解く。

企業導入率でAnthropicがOpenAIを初めて上回った。Rampの調査が示す34.4%対32.3%という数字の背景と、AIビジネス競争の新局面を読み解く。

ダロン・アセモグル氏がAIの生産性向上効果に懐疑的な見方を維持。最新のAIサイバー攻撃やOpenAI内紛も含め、今週注目すべきAI動向を多角的に読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加