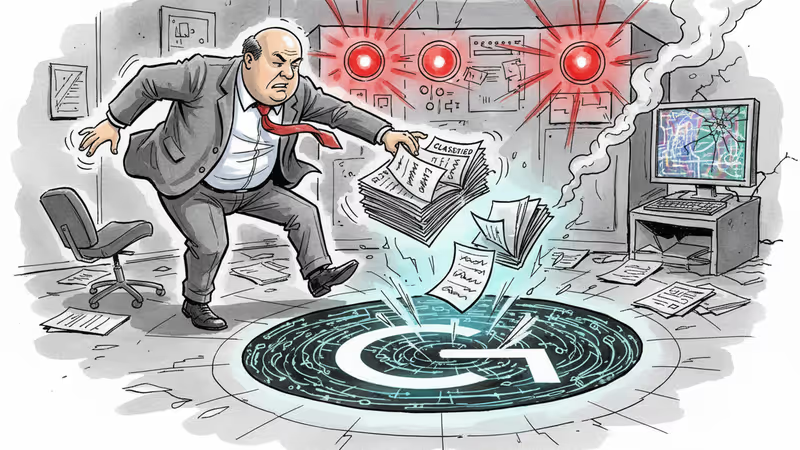

CISA幹部がChatGPTに機密文書を誤アップロード

米国のサイバーセキュリティ機関幹部がChatGPTに機密情報を誤って投稿。政府AI利用の新たな課題が浮き彫りに。

米国のサイバーセキュリティを守る最高機関の幹部が、守るべき機密情報をChatGPTに誤って流出させてしまった。この事件は、AI時代における政府機関の新たな脆弱性を浮き彫りにしている。

事件の詳細

サイバーセキュリティ・インフラストラクチャセキュリティ庁(CISA)の代理長官であるマドゥ・ゴットゥムッカラ氏が、昨年夏に機密性の高い契約文書をOpenAIのChatGPTにアップロードしていたことが、Politicoの報道で明らかになった。

国土安全保障省(DHS)の関係者4名によると、ゴットゥムッカラ氏のアップロードは、「政府資料の盗難や意図しない開示を防ぐ」ために設計された複数の内部サイバーセキュリティ警告を作動させたという。

興味深いのは、この事件のタイミングだ。ゴットゥムッカラ氏は機関に参加した直後に、ほとんどのDHS職員がアクセスを禁止されているChatGPTの使用許可を特別に求めていた。代わりにDHS職員は、「クエリや文書が連邦ネットワークから外部に流出しないよう設定された」DHSChatなどの承認済みAIツールを使用することになっている。

なぜ今この問題が重要なのか

この事件は、政府機関におけるAI利用の急速な拡大と、それに伴うセキュリティリスクの現実を示している。サイバーセキュリティの専門家である幹部でさえ、便利なツールの誘惑に負けてしまう現実は、組織全体でのAIガバナンスの重要性を物語っている。

日本でも、デジタル庁を中心に政府のDX推進が加速している中、この事例は他人事ではない。2024年に日本政府が発表したAI利用指針では、機密情報の取り扱いについて厳格なルールが設けられているが、実際の運用段階での課題は残されている。

各国政府の対応

世界各国の政府機関は、AIの利便性とセキュリティリスクのバランスを取ろうと試行錯誤している。欧州連合ではAI法により厳格な規制が導入され、中国では国家主導でAI利用のガイドラインが策定されている。

一方で、民間企業の視点から見ると、政府機関のAI利用制限は新たなビジネス機会を生み出している。政府専用のセキュアなAIサービスの需要が高まっており、マイクロソフトやGoogleなどの大手テック企業が政府向けの特別なAIサービスを開発している。

関連記事

学習管理プラットフォームCanvasを運営するInstructureが大規模なデータ侵害を受け、学生の個人情報が流出。ハッカー集団ShinyHuntersが犯行声明を出し、学校側に対応を迫っている。教育DXの安全性に疑問符。

教育テック大手Instructureが二度目のサイバー攻撃を受け、ShinyHuntersが5月12日までに2億3100万人分のデータを公開すると脅迫。学校のログイン画面が改ざんされ、子どもたちの個人情報が交渉の道具にされている実態を解説。

MilkenカンファレンスでASML、Google Cloud、Perplexityなど5社のリーダーがAIの物理的制約を語った。チップ不足、エネルギー問題、新アーキテクチャの可能性を日本視点で読み解く。

イーロン・マスクとサム・オルトマンの裁判で証言したシボン・ジリス。彼女の立場が照らし出すのは、シリコンバレーの権力構造と個人的関係の曖昧な境界線だ。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加