AnthropicがAI安全基準を守るため米政府を提訴

AI企業Anthropicがトランプ政権のサプライチェーンリスク指定に対し訴訟を提起。AI安全基準と軍事利用の境界線をめぐる法廷闘争が始まった。日本企業への影響も注目される。

「大量監視には使わせない」——その一言が、政府との全面対決を招いた。

AI企業のAnthropicが2026年3月、米政府を相手取り、カリフォルニア州連邦地裁に訴訟を提起しました。訴状の核心にあるのは、「自社のAIモデルに安全上の制限を設けたことへの報復として、政府がサプライチェーンリスクに指定した」という主張です。

何が起きたのか

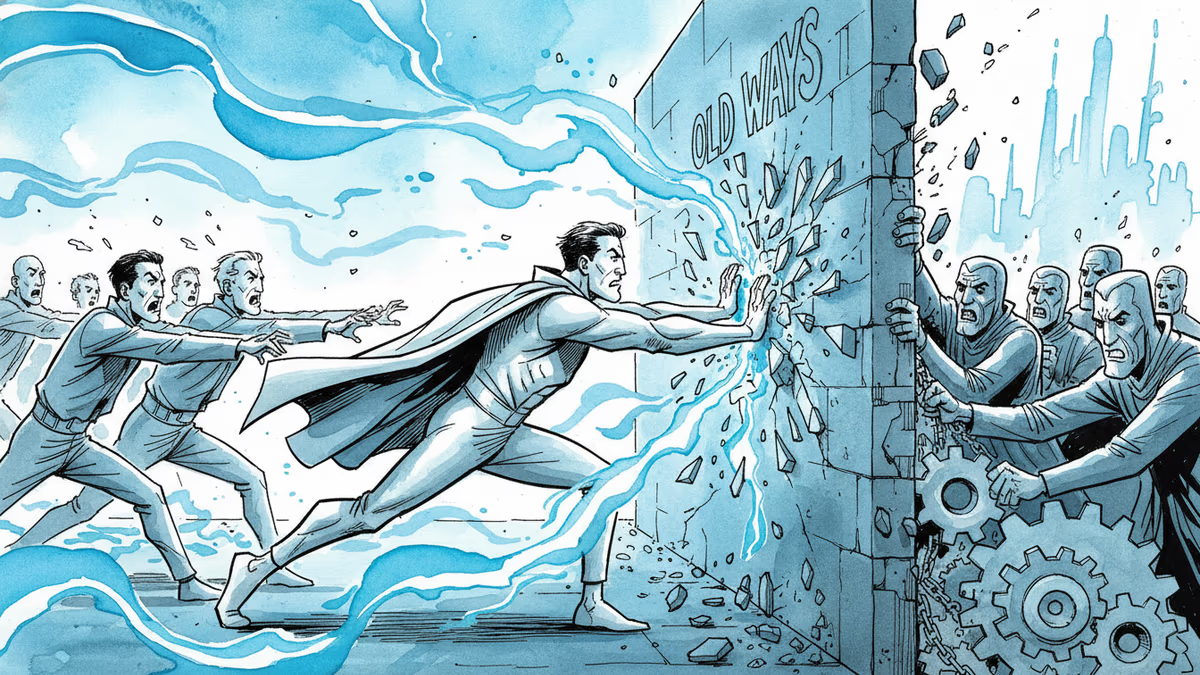

ことの発端は、Anthropicと米国防総省(ペンタゴン)との間で数週間にわたって続いてきた対立です。同社は、自社のAIが「大規模な国内監視」や「完全自律型兵器」に使用されることを明確に拒否していました。いわゆる「レッドライン」と呼ばれる利用制限です。

これに対しトランプ政権は、Anthropicをサプライチェーンリスクとして指定。これは実質的に、政府との取引や契約において不利な扱いを受けることを意味します。Anthropicは訴状の中で、「政府はAI安全性という公共的に重要なテーマに関する同社の見解を理由に、憲法に違反する形で報復した」と訴えています。

この訴訟は、単なる一企業と政府の争いではありません。AIの軍事利用をどこまで許容するかという、社会全体が答えを出せていない問いを法廷に持ち込んだという点で、きわめて重要な意味を持ちます。

なぜ今、この訴訟が重要なのか

Anthropicは、OpenAIの元幹部が設立した企業で、「責任あるAI開発」を企業の中核に据えてきました。同社のAIアシスタント「Claude」は、安全性への配慮を売りにしており、その姿勢が今回の対立の根本にあります。

興味深いのは、これが単純な「反政府」の姿勢ではないという点です。Anthropicはこれまでも政府との協力関係を持っており、完全な商業的中立を標榜しているわけではありません。同社が主張しているのは、「どのように使うか」という条件の問題であり、「使わせるか否か」という二択ではないのです。

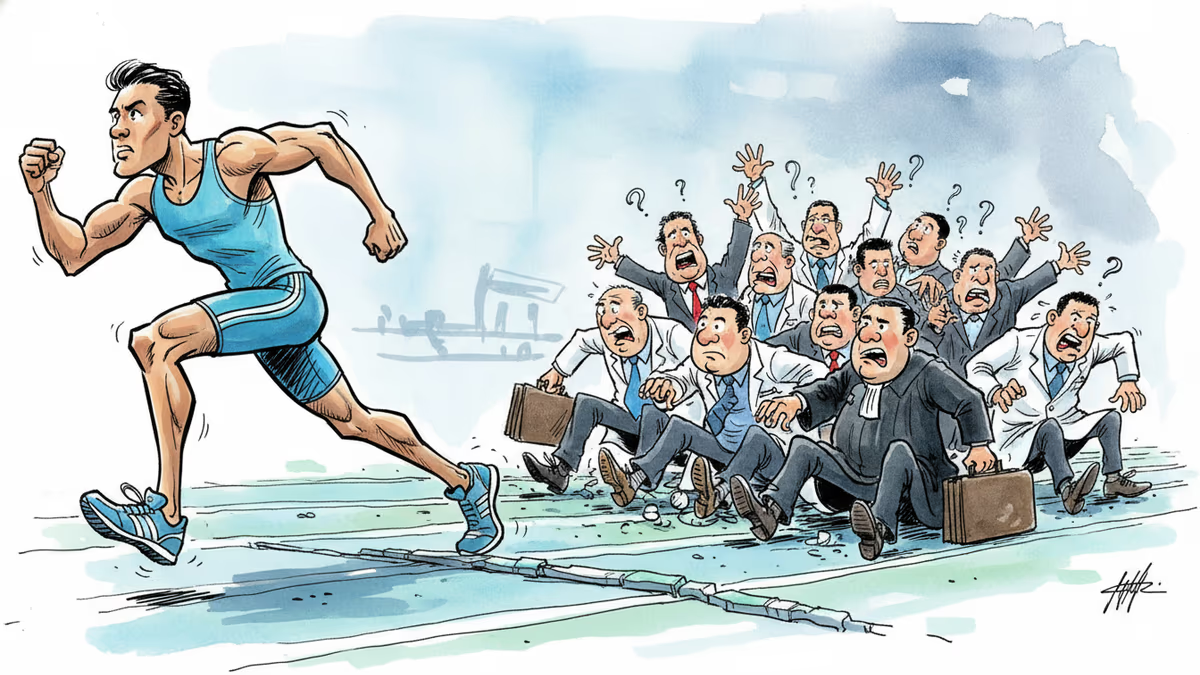

この訴訟が提起されたタイミングも見逃せません。世界各国でAIの軍事・安全保障への応用が急速に進む中、AI企業が自社の倫理基準を守るために政府と法廷で争うという前例が生まれようとしています。

日本企業・日本社会への視点

日本にとって、この訴訟は対岸の火事ではありません。

ソニー、富士通、NTTなど、日本の大手企業は米国のAIプラットフォームを業務に組み込み始めています。もし米政府がAI企業に対して利用制限の撤廃を求める圧力を強めるならば、日本企業が使用するAIツールの安全基準や利用規約にも変化が生じる可能性があります。

また、防衛省が進めるAI活用の議論においても、「どこまでAIに判断を委ねるか」という問いは避けられません。自衛隊の装備品調達や情報処理において、米国製AIの利用が拡大する中、今回の訴訟で示された「自律型兵器へのAI利用」という論点は、日本の安全保障政策とも無縁ではないのです。

労働力不足が深刻な日本社会では、AIへの依存度が今後さらに高まることが予想されます。その際、AIを提供する企業がどのような倫理的立場を持ち、どこまで政府の要求に応じるのか——その「見えないルール」が、私たちの日常に使われるAIの性質を左右するかもしれません。

見方は一つではない

もちろん、政府側にも論理があります。国家安全保障の観点から見れば、最先端のAI技術が敵対勢力に利用されるリスクを最小化するために、民間企業に一定の協力を求めることは合理的とも言えます。Anthropicの「レッドライン」が、軍事的に必要な能力の開発を妨げているとする見方も存在します。

一方でAI研究者の間では、「企業が自社モデルの限界を正直に開示し、危険な用途を拒否することこそが、長期的な安全につながる」という意見も根強くあります。今回の訴訟は、その二つの価値観がぶつかり合う場となっています。

本コンテンツはAIが原文記事を基に要約・分析したものです。正確性に努めていますが、誤りがある可能性があります。原文の確認をお勧めします。

関連記事

米国が中国によるAI知的財産の大規模窃取に対し規制強化へ。DeepSeek問題を発端に、OpenAI・Google・Anthropicが被害を訴える中、AI覇権争いの新局面を解説。

米国の監視・防衛テクノロジー企業パランティアで、移民摘発やイランへの軍事攻撃への関与をめぐり、社員たちが内部から声を上げ始めている。テクノロジー企業の倫理的責任とは何かを問う。

米国防総省から「サプライチェーンリスク」と指定されたAnthropicが、ホワイトハウス高官と会談。トランプ政権内の分裂が浮き彫りに。AI企業と政府の関係はどこへ向かうのか。

スタンフォード大学の2026年AIインデックスが示す現実:AIは予想を超えるペースで進化し、雇用・規制・エネルギーすべてが追いつけていない。日本社会への影響を多角的に読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加