AI軍事利用を拒否したAnthropic、「倫理」か「ビジネス」か

AnthropicがペンタゴンのAI軍事利用提案を拒否。AI企業の倫理観と国防需要の間で揺れる業界の未来を探る

ChatGPTの競合として注目されるAnthropicが、米国防総省からの「最終提案」を拒否した。軍事用途でのAI技術提供を求められたが、同社は倫理的な理由から断固として断ったのだ。

この決断は、急速に成長するAI業界において、技術の進歩と倫理的責任の間で企業が直面する根本的なジレンマを浮き彫りにしている。

拒否の背景にある「AI憲法」

Anthropicは創業当初から「AI安全性」を最優先に掲げてきた。同社が開発するClaudeは、人間の価値観に沿った行動を取るよう設計されており、軍事転用を想定していない。

「私たちのAIは人類の福祉向上のためのもの」と、同社幹部は繰り返し表明してきた。この哲学は、OpenAIが軍事利用に門戸を開いたのとは対照的だ。

実際、AI軍事市場は2030年までに180億ドル規模に達すると予測されている。この巨大市場を前に、Anthropicの判断は純粋にイデオロギー的なものなのか、それとも戦略的計算があるのか。

日本企業への波及効果

Anthropicの決断は、日本のAI関連企業にも影響を与える可能性がある。ソフトバンクはAnthropicに40億ドルを投資しており、この倫理的スタンスが投資価値にどう影響するかは未知数だ。

一方で、日本政府は防衛装備庁を通じてAI技術の軍事応用を積極的に推進している。NECや富士通などの国内企業は、民生技術の防衛転用について慎重な姿勢を保ちつつも、国家安全保障の観点から協力を求められている。

日本企業は「平和利用」と「国防協力」の間でどうバランスを取るのか。この問いは、今後ますます重要になるだろう。

競合他社の動向と市場の分裂

OpenAIが軍事利用に方針転換したことで、AI業界は「倫理派」と「実用派」に分裂しつつある。GoogleのDeepMindも軍事プロジェクトへの参加を制限しているが、親会社のAlphabetは国防契約を受注している。

興味深いのは投資家の反応だ。ESG投資の観点からAnthropicの姿勢を評価する声がある一方、軍事市場の成長性を重視する投資家からは疑問視する意見も出ている。

中国ではバイドゥやアリババのAI技術が軍民両用で開発されており、西側企業の「倫理的制約」が競争力の足かせになるリスクも指摘されている。

関連記事

マイクロソフトが2025年に設立したTrusted Technology Groupの取り組みを通じ、AI開発における責任とスピードのトレードオフ、障害者包摂の意義を多角的に考察します。

AnthropicのCEOが警告。最新AIモデル「Mythos」が数万件のソフトウェア脆弱性を発見。中国AIが追いつくまでの猶予はわずか6〜12ヶ月。金融・医療・インフラへの影響を多角的に分析。

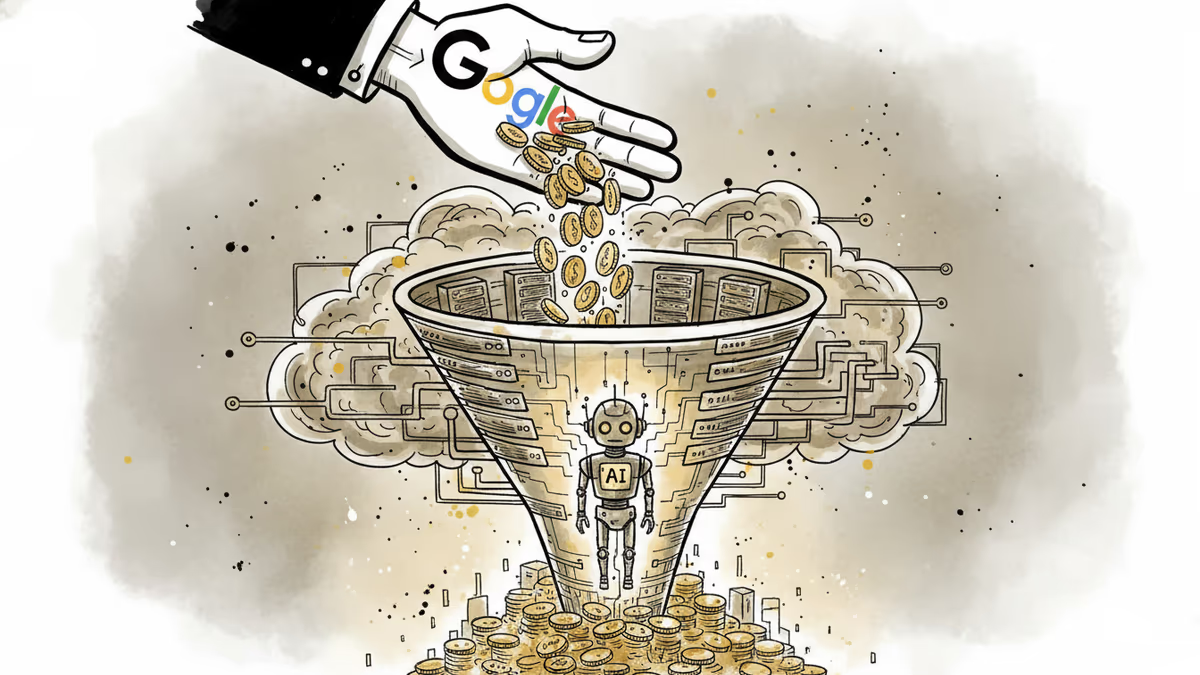

GoogleがAnthropicへの財務支援を拡大。AI計算インフラをめぐる巨大テック企業の戦略的投資が加速する中、日本企業や投資家にとっての意味を読み解く。

流出文書により、イラン革命防衛隊(IRGC)が極秘でGPS誘導システムを取得し、2026年3月の戦争中の攻撃誘導に使用していたことが判明。中東の軍事バランスと日本の安全保障への影響を分析します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加