AI企業と国防の境界線:Anthropic対米国防総省の対立が示すもの

Anthropic社が米国防総省との契約で自律兵器使用を拒否。AIの軍事利用をめぐる企業と政府の対立が浮き彫りに。日本の防衛AI戦略への示唆も。

2億ドルの契約が宙に浮いている。AI企業Anthropicと米国防総省の間で続く交渉は、単なる契約条件の話を超えて、AI時代の軍事技術をめぐる根本的な問題を浮き彫りにしている。

対立の核心:「すべての合法的用途」vs「自律兵器拒否」

Anthropicは昨年、米国防総省から200万ドルの契約を獲得し、現在唯一、同省の機密ネットワークにAIモデルを展開している企業だ。しかし、今後の利用条件をめぐって両者の立場は真っ向から対立している。

Anthropic側の要求は明確だ。同社は自社のAIモデルが自律兵器システムや大規模な国民監視に使用されないことを保証するよう求めている。一方、国防総省のエミール・マイケル次官(研究・技術担当)は「すべての合法的用途」での無制限使用を主張する。

「どの企業でも、それに対応したくないというなら、それは我々にとって問題だ」とマイケル次官は述べた。「我々がそのモデルを使い慣れた時に、緊急事態で使用する必要が生じても使えなくなる状況を作り出しかねない」

日本への波及効果:防衛AI戦略の分岐点

Anthropicと国防総省の対立は、日本の防衛AI戦略にも重要な示唆を与える。日本政府は2024年度から防衛装備庁を中心にAI技術の軍事応用を本格化させているが、民間企業との協力関係構築において同様の課題に直面する可能性がある。

ソニーや富士通、NECといった日本の技術企業は、これまで民生技術と防衛技術の境界を慎重に管理してきた。しかし、AI技術の汎用性は、この境界を曖昧にする。企業は技術提供の範囲をどこまで認めるのか、政府は民間企業の懸念にどう応えるのか。

興味深いのは、OpenAIやGoogle、xAIなどの競合他社は国防総省の条件を受け入れているという点だ。これは各社の企業文化や価値観の違いを反映している可能性がある。

compare-table

| 項目 | Anthropic | 米国防総省 |

|---|---|---|

| 基本姿勢 | 限定的協力 | 無制限利用 |

| 自律兵器 | 使用禁止を要求 | 合法なら使用可 |

| 監視システム | 大規模監視拒否 | 合法なら使用可 |

| 契約リスク | 「供給網リスク」指定の可能性 | 代替企業への移行 |

技術倫理と国家安全保障の狭間

この対立の背景には、AI技術の急速な発展と、それに対する社会的責任をめぐる議論がある。Anthropicの立場は、技術企業が自社製品の使用方法に対して道徳的責任を負うべきだという考えに基づいている。

一方で、国家安全保障の観点からは、緊急時に技術的制約が足かせになることへの懸念も理解できる。特に中国やロシアがAI軍事技術の開発を加速させる中で、米国が自国企業の倫理的配慮により技術優位性を失うリスクも存在する。

日本企業にとって、この事例は重要な先例となる。技術提供の条件設定、政府との協力範囲の明確化、そして国際的な競争環境での立ち位置の確立が求められている。

関連記事

AnthropicのCEOが警告。最新AIモデル「Mythos」が数万件のソフトウェア脆弱性を発見。中国AIが追いつくまでの猶予はわずか6〜12ヶ月。金融・医療・インフラへの影響を多角的に分析。

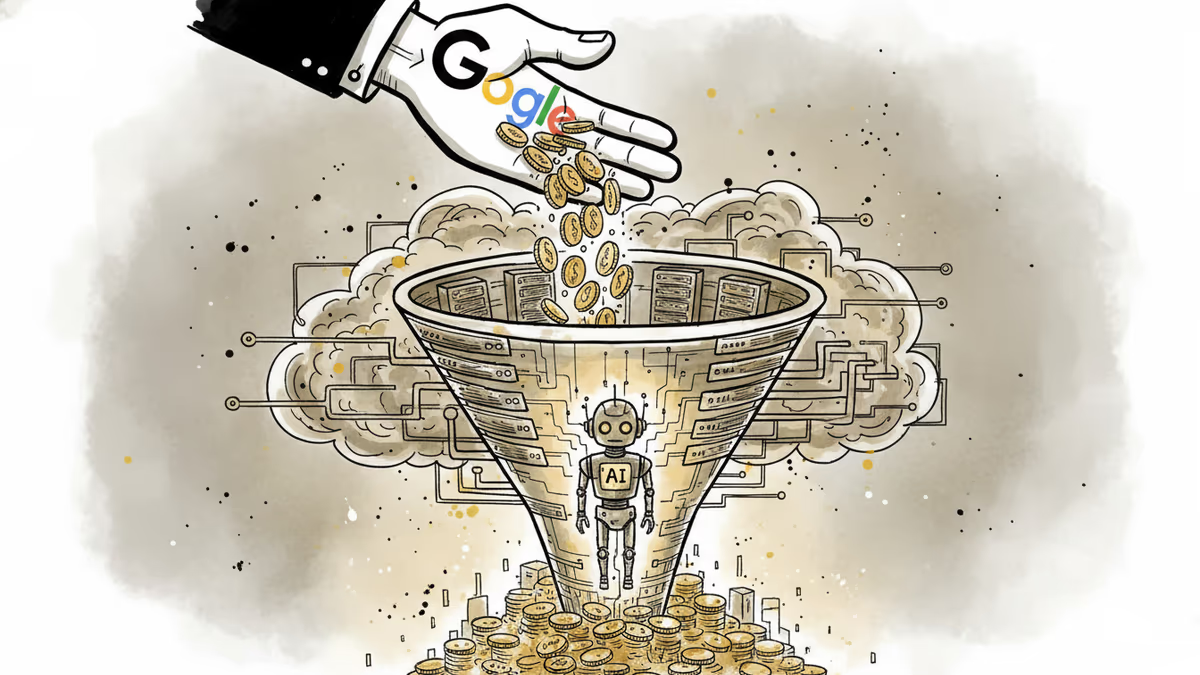

GoogleがAnthropicへの財務支援を拡大。AI計算インフラをめぐる巨大テック企業の戦略的投資が加速する中、日本企業や投資家にとっての意味を読み解く。

サンフランシスコで開催されたHumanX会議で、6,500人のAI業界リーダーが注目したのはOpenAIではなくAnthropicだった。Claude Codeの躍進と中国製オープンウェイトモデルの台頭が示す、AI産業の地殻変動を読み解く。

AnthropicのAIモデル「Mythos」が引き起こしたサイバーリスクをめぐり、FRB議長と財務長官が米国主要銀行CEOと緊急会合。AI時代の金融安全保障とは何かを問う。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加