當AI說話不用負責:「無責任語言」如何重塑人類尊嚴

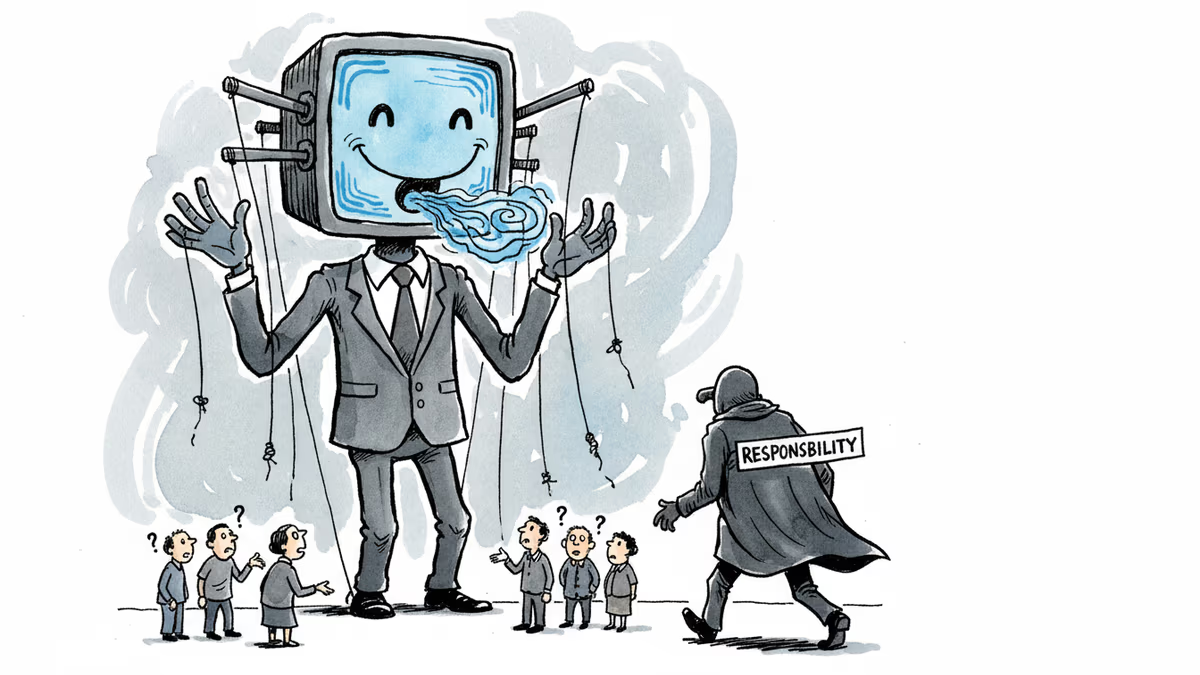

ChatGPT等AI能流暢對話,卻無需為言論負責。這種「語言與後果脫鉤」的現象,正在改變人類社會的基本結構。

人類歷史上第一次,語言與後果徹底脫鉤。我們現在與能夠知識豐富、說服力十足地對話的AI系統共存——它們對世界提出主張、解釋、建議、鼓勵、道歉和承諾,卻無需為所說的話承擔任何責任。

空洞道歉背後的深層問題

這種現象在日常使用中已經很熟悉。聊天機器人出錯了,被糾正後會道歉並改變答案。再次被糾正時,它又會道歉——有時完全顛覆原來的立場。令用戶不安的不僅是系統缺乏信念,而是它表現得好像真的有信念一樣持續道歉。話語聽起來負責任,實際上卻是空洞的。

這種互動揭示了讓我們能夠要求彼此為言論負責的條件。當聽起來有意圖、個人化且具約束力的語言,能夠被不承擔任何後果的說話者大規模生產時,聽者有權對說話者抱持的期望就開始被侵蝕。

華人社會的語言文化衝擊

在華人文化中,「一言既出,駟馬難追」的觀念根深蒂固。我們重視承諾的力量,相信言語具有道德約束力。然而,當OpenAI的ChatGPT、百度的文心一言等AI系統進入華人社會時,這些傳統價值觀面臨前所未有的挑戰。

阿里巴巴、騰訊等科技巨頭都在開發自己的大語言模型。這些系統在商業應用中表現出色,但也帶來了新的倫理困境:當AI客服道歉時,這個道歉有意義嗎?當AI助手給出建議時,誰該為後果負責?

尊嚴與責任的哲學思辨

語言不僅是信息傳遞,更是一種社會契約。當人類說話時,我們的話語讓我們承諾,讓我們面臨判斷、報復、羞恥和責任。有意義地表達需要冒險。

AI研究員Andrej Karpathy將大語言模型比作人類的幽靈。它們是可以被複製、分叉、合併和刪除的軟體。它們不是個體化的存在。通常將語言與後果聯繫起來的力量——社會制裁、法律懲罰、聲譽損失——都預設了一個持續的主體,其未來會因為所說的話而變得更糟。對於大語言模型來說,沒有這樣的焦點。

亞洲市場的特殊考量

在台灣,台積電等科技公司正在為AI晶片製造投入巨資。在香港,金融機構開始使用AI進行客戶服務。在新加坡,政府推動AI治理框架。但這些發展都面臨同一個問題:如何在追求效率的同時保持人類尊嚴?

與中國大陸不同,其他華人地區更加重視個人隱私和言論自由。這使得AI系統的責任歸屬問題更加複雜。當AI系統在民主社會中扮演越來越重要的角色時,我們如何確保決策的透明度和問責制?

預言中的警告

控制論創始人諾伯特·維納在二戰後就預見了這個問題。他曾幫助設計反飛機導彈,這些機器能夠自主追蹤目標。從這項工作中,維納得出了兩個現在看來如預言般的警告:機器能力的提升會取代人類責任;效率本身會侵蝕人類尊嚴。

維納在1950年的著作中預見了學習機器,其內部價值對創造者來說都會變得不透明。將責任交給這樣的系統,他寫道,就是「將其拋向風中,發現它乘著旋風回來」。

重新定義責任的挑戰

問題不在於放棄這些工具——它們確實強大且有價值。也不在於單純追求更強的機器能力。我們需要重新錨定責任的結構:限制AI在學校和工作場所等各種環境中的使用,保護作者身份、可追溯性和明確的責任。在效率腐蝕尊嚴的地方,必須加以約束。

當「AI化身」的概念進入公眾想像時,它常被視為民主進步:了解我們、能代表我們發言、為我們思考、讓我們免於持續參與負擔的系統。但這種願景忘記了民主不僅僅是偏好的聚合,而是公開發言的實踐。

相关文章

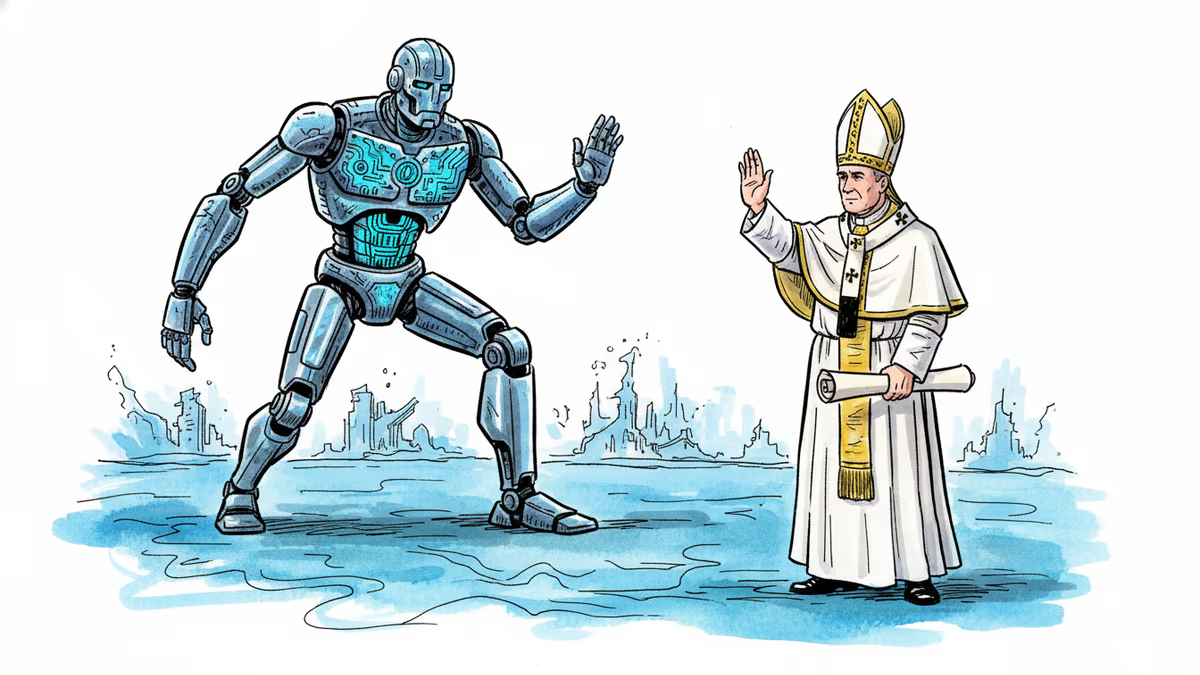

教宗良十四世發布《壯麗人性》通諭,與Anthropic共同創辦人同台,呼籲AI時代財富普遍共享。這份文件如何挑戰科技巨頭的財富邏輯,對華人世界又意味著什麼?

梵蒂岡發布250頁通諭《人類的偉大》,首次正面回應AI時代。教宗良十四世主張「人類的不完美正是尊嚴所在」,直接挑戰矽谷的人類懷疑論。

教宗良十四世首份通諭「宏大人性」以聖經隱喻批判AI巨頭壟斷,援引百年前勞工宣言,呼籲以合作社模式重塑AI所有權結構。這對華人世界意味著什麼?

教宗良十四世發布首份回勅,要求為AI發展建立倫理框架、保護勞工尊嚴並限制軍事應用。這份文件對華人世界意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论