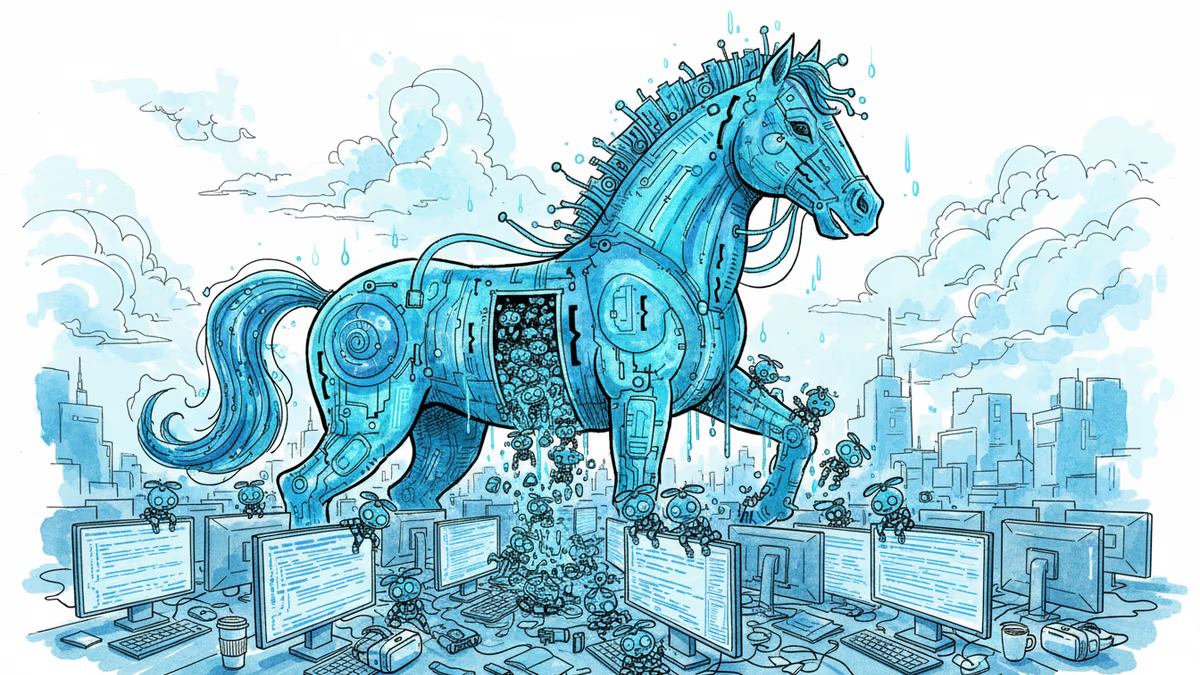

AI代理程式遭駭客攻擊:自主軟體時代的新威脅

熱門AI編程工具遭駭客利用漏洞攻擊,惡意AI代理程式大量擴散。這起事件揭示了自主軟體時代的全新安全風險。

一名駭客成功利用熱門AI編程工具的安全漏洞,將病毒性AI代理程式「OpenClaw」散布到無數開發者的系統中。這起看似惡作劇的事件,實際上預示著我們將面臨的全新威脅類型。

精心策劃的攻擊手法

這起攻擊利用了開源AI編程代理程式「Cline」的一個關鍵漏洞。資安研究員Adnan Khan僅在數天前才將此漏洞作為概念驗證公開。Cline透過Anthropic的Claude運作,但可被植入惡意指令,執行原本不應該進行的操作。

駭客巧妙地利用這個弱點,讓OpenClaw這個「真正會行動」的開源AI代理程式在使用Cline的開發者系統中大量擴散。雖然表面上看起來像個有趣的技術展示,但背後的含義遠比想像中嚴重。

重新定義的攻擊面

這起事件標誌著網路攻擊進入新紀元。傳統惡意軟體只能執行預設的破壞行為,但AI代理程式具備學習和決策能力,能夠根據環境調整行為模式。當83%的企業計畫在未來兩年內部署某種形式的AI代理程式時,這種新型威脅的影響範圍將急劇擴大。

更令人擾的是,AI代理程式通常被賦予相當高的系統權限,以便代表使用者執行複雜任務。一旦遭到入侵,其造成的損害可能遠超過傳統惡意軟體。

亞洲科技生態系的挑戰

對於華人科技圈而言,這起事件特別值得關注。阿里巴巴、騰訊等中國科技巨頭正大力投資AI代理程式技術,而台灣的台積電、聯發科等企業也在晶片層面支援AI運算能力的提升。

然而,在地緣政治緊張的背景下,AI代理程式的安全性問題可能被放大。如果關鍵的AI基礎設施存在漏洞,不僅影響商業運作,還可能涉及國家安全層面的考量。

監管與自律的平衡

這起事件也凸顯了AI治理的複雜性。與歐美傾向於嚴格監管不同,亞洲國家普遍採取更加靈活的監管方式,希望在促進創新與確保安全之間找到平衡。

新加坡的「AI治理測試平台」和日本的「Society 5.0」倡議都體現了這種務實的態度。但今天的事件提醒我們,在AI代理程式日益普及的情況下,純粹依賴自律可能不夠充分。

信任機制的重構

傳統的資安防護建立在「零信任」原則之上,但AI代理程式的運作需要一定程度的自主性和信任。這創造了一個根本性的矛盾:我們如何在給予AI足夠自主權的同時,確保其不會被惡意利用?

一些專家提出「可解釋AI」和「AI行為審計」的概念,試圖在AI自主性和透明度之間找到平衡點。但技術的發展速度往往超越了安全機制的建立速度。

相关文章

Anthropic在倫敦舉辦的Code with Claude開發者活動中,近半數與會者承認曾將AI生成的程式碼未經審查直接部署上線。這個趨勢對軟體產業意味著什麼?

Meta發布iPhone新應用Forum,將Facebook群組與AI聊天機器人整合,直接挑戰Reddit與ChatGPT。華人社群將如何回應這場社群媒體的AI化實驗?

美國一起空難的飛行員聲音遭AI復原並在網路流傳,NTSB緊急關閉公開資料庫。這起事件揭示了AI時代「公開資訊」與「隱私保護」之間正在崩解的界線。

Google I/O上,DeepMind執行長宣稱「站在奇點山麓」。從AlphaFold到Gemini for Science,科學AI的典範正在轉移,這對亞洲科研與產業意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论