反其道而行:Humanizer 工具利用 Wikipedia 指南,讓 AI 寫作更具「人味」

開發者 Siqi Chen 推出新工具 Humanizer,結合 Wikipedia 的 AI 識別指南,讓 Claude 生成的內容避開「機器感」標籤。深入了解這場 AI 生成與識別的攻防戰。

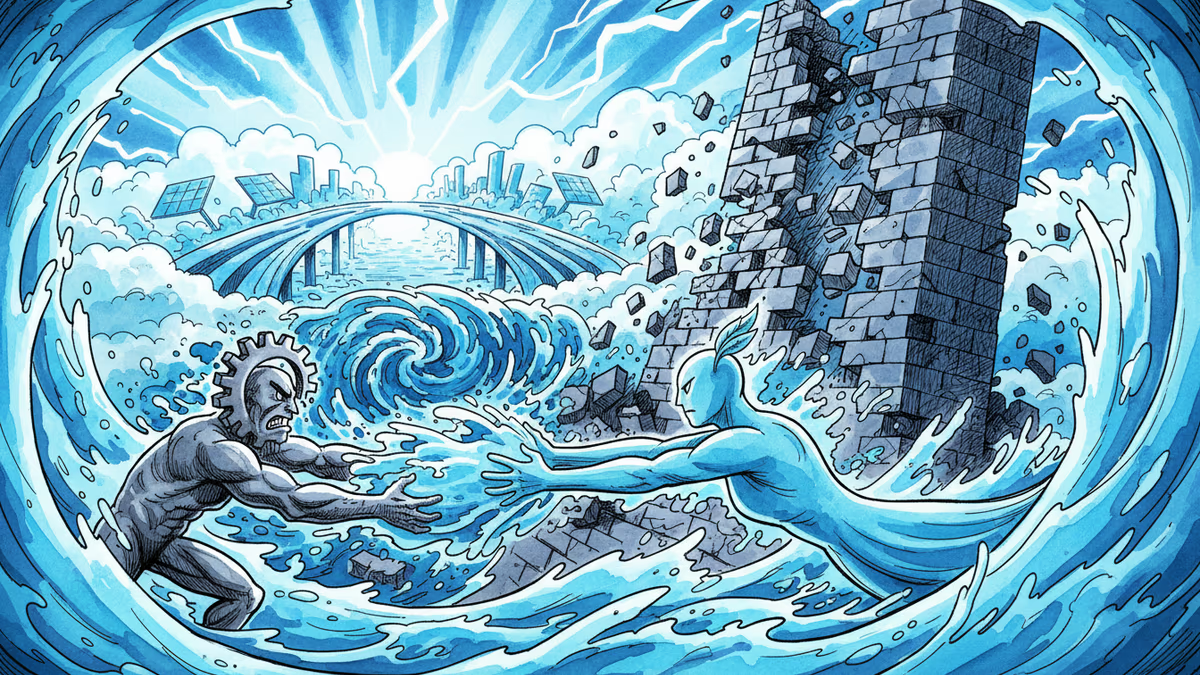

AI 生成內容的辨識技術正成為其進化的墊脚石。開發者 Siqi Chen 推出了一款名為「Humanizer」的新工具。據 Ars Technica 報導,該工具的核心邏輯竟然是利用 Wikipedia 志工編輯為了打擊「劣質 AI 文章」而編寫的識別指南。這場「矛」與「盾」的較量,正進入一個意想不到的新階段。

以毒攻毒:Wikipedia AI 識別指南成為進化教材

Humanizer 的運作方式是將 Wikipedia 彙整的 AI 特徵列表餵給 Anthropic 旗下的 Claude 模型。透過學習這些被人類視為「機器感」的標籤,AI 能夠精確地避開那些容易穿幫的雷區。這不僅是技術上的微調,更是一種策略性的轉向,讓生成式 AI 從單純的模仿,進化到有意識地「去機器化」。

Humanizer 重點掃除的「機器痕跡」

- 過度誇張的宣傳語言:如頻繁使用「breathtaking(驚世駭俗)」等形容詞。

- 公式化的結尾:例如「I hope this helps!(希望這對你有幫助!)」等罐頭訊息。

- 含糊其辭的來源引用:缺乏具體細節的空洞描述。

目前這款工具作為一種自定義技能,主要面向內容創作者與教育工作者。它旨在幫助使用者生成更自然、更具親和力的文字,同時大幅降低被 AI 檢測軟體標註的機率。

相关文章

Anthropic發布Opus 4.8,距上一版本僅41天。核心賣點不是更高分數,而是主動標記不確定性的能力。這個設計選擇,正在重新定義企業AI的信任標準。

YouTube推出AI自訂動態消息功能,用戶輸入文字描述即可生成個人化影片清單。這項改變對內容創作者、廣告主與亞洲市場意味著什麼?

Anthropic市值即將超越OpenAI,旗下Claude在企業市場份額一年內翻四倍。產品負責人Cat Wu揭示AI代理人時代的工作新邏輯,以及這對亞洲市場的深層意義。

Google正在YouTube測試「Ask YouTube」會話式搜尋功能,整合長影片、Shorts與文字內容。這對內容創作者、平台競爭格局與亞洲市場意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论