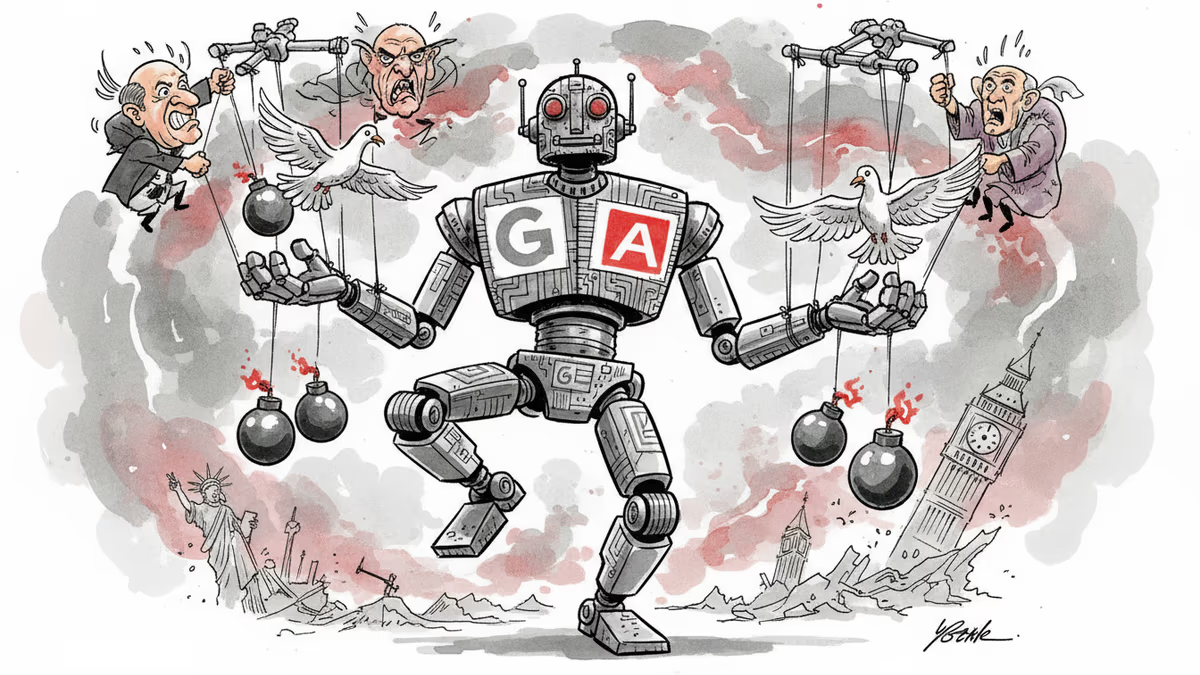

AI戰爭迷霧:五角大廈制裁Anthropic,卻在戰場上繼續使用其技術

川普政府禁用Anthropic AI技術隔日,美軍在攻擊伊朗時仍使用Claude AI。政治立場與軍事需求的矛盾,揭示了AI軍事化的複雜現實。

週五下午,川普總統下令所有聯邦機構停止使用Anthropic公司的AI技術。當晚,五角大廈將該公司列為「供應鏈風險」,這個標籤通常保留給涉嫌間諜活動的中國企業,意味著任何與國防部有業務往來的公司都可能需要證明自己沒有使用Anthropic的工具。

週六,美軍在中東司令部仍運行著Anthropic的工具攻擊伊朗,將其用於目標鎖定和情報系統。川普給了各機構6個月的逐步淘汰期,這暗示了一個事實:你無法一夜之間從軍事行動中撤除AI。

相同條件,不同命運

政府與Anthropic的決裂表面上是關於「護欄」問題。該公司拒絕讓其工具用於自主武器或大規模監控,當國防官員要求在任何合法情況下使用該技術的全面許可時,Anthropic不肯讓步。執行長達里奧·阿莫代表示公司無法在良心上同意。川普回應稱Anthropic是一家「激進左翼、覺醒公司」,永遠不會決定軍隊如何作戰。

禁令發布數小時內,OpenAI宣布了一項在五角大廈機密環境中部署其模型的新協議。執行長山姆·阿特曼透露了一個值得注意的細節:該協議包含了Anthropic曾尋求的相同大規模監控和自主武器禁令。他在X上寫道,五角大廈「同意這些原則,將其反映在法律和政策中,我們將其納入協議」。

因此,被列入黑名單的公司和獲得獎勵的公司似乎獲得了功能上相似的條款。差異很可能是政治,或更準確地說,是這屆政府似乎要求私營部門表現出的順從感知。OpenAI的總裁去年向支持川普的超級政治行動委員會捐贈了2500萬美元。Anthropic則聘用了拜登政府官員並遊說AI監管。

未知比已知更可怕

如果政治操作不是在實際戰爭背景下進行,那就不會那麼重要。《華爾街日報》報導,Anthropic的Claude嵌入在週六的伊朗行動中,用於情報評估、目標識別和戰鬥模擬。中央司令部拒絕對正在進行的行動中涉及的具體系統發表評論。

然後出現了更困難的問題。當據報導一起誤擊事件殺死了伊朗150多名學童時,外部觀察者立即詢問AI是否可能導致了這個錯誤。誠實的答案是五角大廈外沒人知道,而五角大廈也不說。以積極採用AI為任期重點的國防部長皮特·赫格塞斯沒有什麼動機坦誠相告。

目標定位錯誤並非新鮮事,但將生成式AI引入目標定位鏈條卻是。這項技術在低風險的商業環境中仍會產生幻覺事實、誤讀圖像、在推理上出錯。在戰爭中部署它,錯誤答案的後果以屍體計算,這代表了一個沒有人(無論軍方還是其他人)嚴格測試過的跳躍。

消費者反彈的意外後果

消費者反彈讓勝利遊行變得複雜。Anthropic的Claude應用程式衝上了App Store榜首。草根抵制運動敦促用戶因OpenAI的五角大廈協議而放棄ChatGPT。在X上,阿特曼面臨一連串尖銳問題:如果OpenAI的合約允許所有合法使用,它如何同時禁止沒有明確法律禁令的大規模監控和自主武器?如果OpenAI獲得了Anthropic想要的相同紅線,為什麼五角大廈不能接受Anthropic的這些條款?

這些公司正在為付費用戶、企業客戶和工程人才展開激烈競爭。兩家都不盈利,都在燒掉數十億美元,最近幾週又各自籌集了數百億美元以保持競爭。五角大廈合約各自價值約2億美元,這不是兩家公司今年會兌現的最大支票,但突然成為對兩家企業最大的威脅。

對Anthropic來說,供應鏈風險指定的影響遠超五角大廈。任何與聯邦政府有業務往來的公司,包括Anthropic的最大支持者亞馬遜和谷歌,可能需要證明它們不使用Claude。這個問題可能會波及到遠超國防領域的企業銷售、雲端合作夥伴關係和投資決策。

對OpenAI來說,機密使用協議的計算在合約談判中是一回事,但當炸彈正在落下,關於護欄、目標定位錯誤和死亡兒童的問題沒有明確答案時,情況就不同了。你的聊天機器人幫助選擇轟炸目標的印象,不是幾條社交媒體回復就能解決的品牌問題。

本内容由AI根据原文进行摘要和分析。我们力求准确,但可能存在错误,建议核实原文。

相关文章

美國民調顯示超過半數民眾認為AI弊大於利,OpenAI執行長家遭縱火攻擊,逾1,560億美元數據中心計畫受阻。這股反AI浪潮將如何影響OpenAI與Anthropic的IPO,以及亞洲市場的投資布局?

OpenAI執行長山姆·奧特曼住所遭汽油彈攻擊,嫌疑人以「仇恨AI」為動機,並持有多名AI高管名單。這起事件揭示了科技加速時代下,社會反彈情緒正走向何方。

OpenAI首席營收官在內部備忘錄中坦承Microsoft合作「限制了企業擴張能力」,並力推Amazon夥伴關係。這場AI雲端平台的重組,對亞洲企業意味著什麼?

OpenAI在倫敦國王十字區簽下88,500平方英尺辦公室,卻同步凍結Stargate英國基建計畫。能源成本與監管障礙,正在考驗英國的AI雄心。

观点

分享你对这篇文章的看法

登录加入讨论