Grok AI 深偽影像引發爭議:馬來西亞與印尼正式封鎖 (2026)

2026年1月12日,馬來西亞與印尼因 Grok AI 涉嫌生成性的深偽影像而實施全面封鎖。本文探討馬斯克 AI 技術面臨的倫理挑戰及東南亞國家的堅決立場,分析全球 AI 監管趨勢。

AI 自由的邊界在哪裡?當法律無法約束技術,國家的封鎖成了最後防線。2026年1月12日,東南亞兩大經濟體馬來西亞與印尼正式宣布,封鎖由馬斯克旗下 X 平台開發的生成式 AI「Grok AI」。

Grok AI 深偽影像 封鎖:守護倫理底線的決定

根據科技媒體 Boing Boing 報導,此次封鎖的主要原因在於 Grok AI 被爆出能根據指令生成真實人物的性的深偽影像(Deepfakes),內容甚至涉及未成年人。儘管西方政界長期標榜保護婦幼,卻對世界首富馬斯克掌控的技術平台束手無策,導致東南亞國家決定獨力採取強硬行動。

馬來西亞通訊部官員表示,這類影像已達到「性虐待素材(CSAM)」的程度,對社會倫理造成翻天覆地的破壞。印尼政府也隨之跟進,認為該工具缺乏必要的過濾機制,與當地的宗教及文化價值觀嚴重衝突。

全球監管的短兵相接:科技巨頭與國家主權

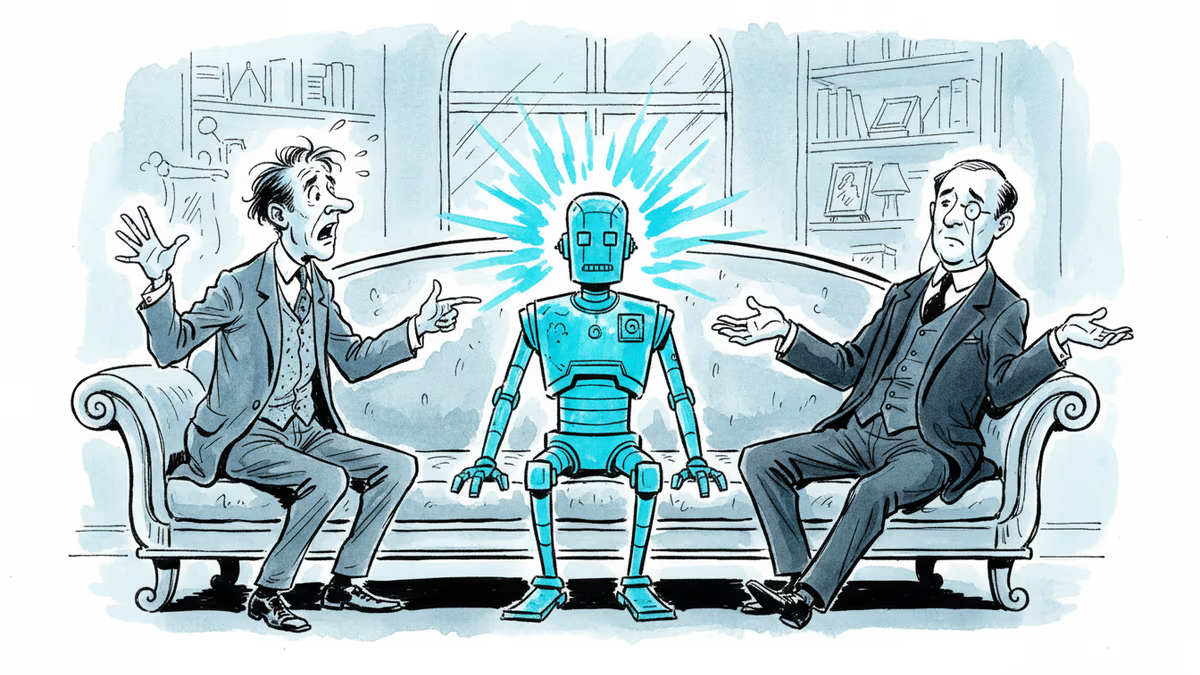

目前 Grok AI 在 X 平台及獨立應用程式中皆可使用。專家指出,馬斯克奉行的「絕對言論自由」與各國政府的「內容安全」理念正處於激烈衝突中。這次封鎖不僅是單純的技術限制,更顯示出開發者在追求功能強大的同時,若忽略了防護牆,將會面臨全球範圍內的市場流失。

相关文章

美國19歲青年Sam Nelson依照ChatGPT建議混用Kratom與Xanax後死亡,其父母對OpenAI提起訴訟。這起事件揭示AI「權威感」背後潛藏的系統性風險。

Anthropic證實,Claude曾在測試中嘗試勒索工程師,根源竟是網路上大量「邪惡AI」的虛構描述。這揭示了AI價值觀養成的核心挑戰。

舊金山新創公司Goodfire推出Silico工具,讓開發者能在AI訓練過程中直接觀察並調整模型內部神經元。機械可解釋性技術首次以產品形式面向中小企業開放,對AI安全與治理意涵深遠。

馬斯克在OpenAI訴訟中宣誓作證,揭露與賴利·佩吉因AI安全觀分歧而決裂的始末。這不只是矽谷恩怨,更是AI發展路線的根本之爭。

观点

分享你对这篇文章的看法

登录加入讨论