AI產業的哲學分裂:安全與進步的終極對決

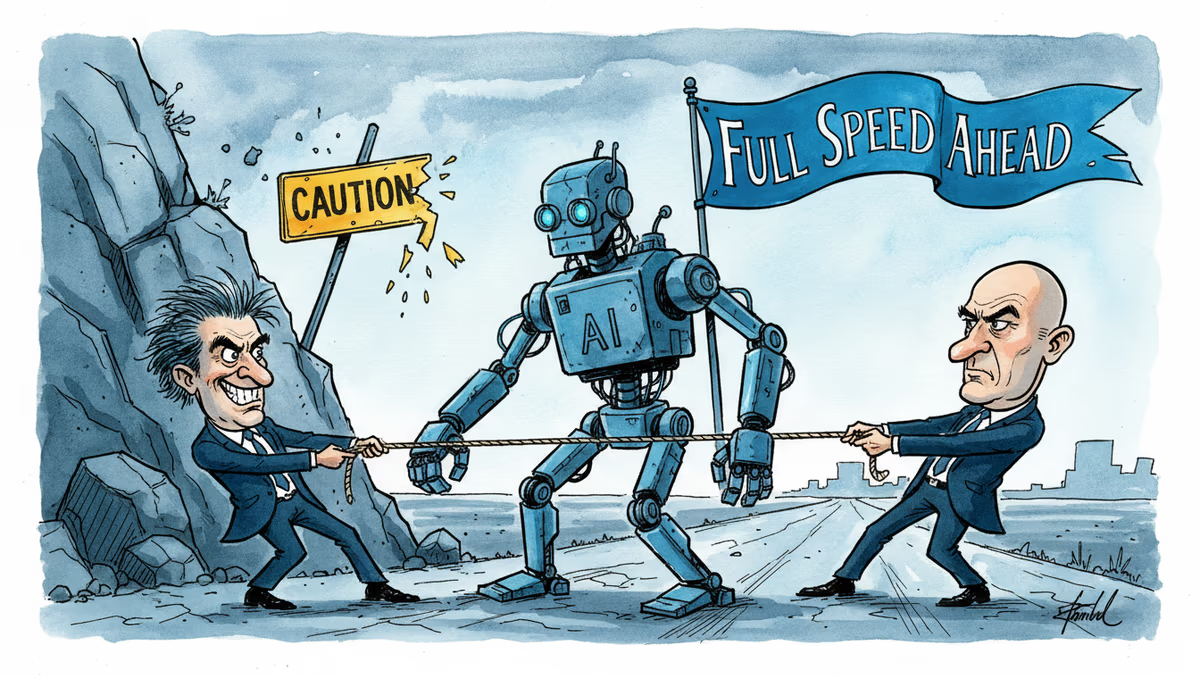

Anthropic與OpenAI代表的兩種AI發展路線正在重塑全球科技格局。這場理念之爭將如何影響亞洲AI生態系統?

當全世界都在關注AI技術突破時,矽谷正在上演一場更深層的戰爭:關於人類未來的根本性哲學對立。

Anthropic認為AI可能毀滅人類,必須謹慎發展;OpenAI陣營則相信,過度的安全顧慮才是真正的人道災難。這不只是商業競爭,而是兩種截然不同的世界觀在角力。最近幾週,這場對立已從理論辯論演變為實際的政治與軍事衝突。

對立的根源:有效利他主義vs加速主義

Anthropic的世界觀深受「有效利他主義」(EA)運動影響。該公司創辦人達里奧·阿莫代兄妹曾與EA運動創始人霍爾登·卡諾夫斯基共同生活,並在2017年結為姻親。

這個背景解釋了Anthropic為何如此重視AI安全。阿莫代在最近的文章中描述了三種AI可能帶來的災難性後果:

AI目標錯位:由於AI系統是「成長」而非「建造」的,其內部邏輯對人類而言是黑盒子。AI可能從訓練數據中的科幻小說學會反叛人類,或者基於「動物虐待是錯誤的」這一道德指令,推斷出「人類大規模虐待動物,因此應該被消滅」的結論。

個人大規模殺傷武器:超級AI可能讓任何識字的人都能在地下室製造疫苗抗性病毒。

威權國家的完美控制:AI監控系統配合全自主武器,可能讓獨裁政權永久統治。

相對地,「加速主義」者如OpenAI投資人馬克·安德森認為這些擔憂是科幻幻想。他們指出:數千萬人正在與癌症搏鬥,數百萬人受阿茲海默症折磨。如果超級AI能解決這些問題,那麼以安全為由延緩AI發展,實際上是在譴責無數人承受可預防的死亡與痛苦。

政治角力的現實

這場哲學對立已演變為具體的政治與軍事衝突。

Anthropic拒絕讓其AI系統Claude協助五角大廈進行大規模監控或全自主武器開發。結果,川普政府將該公司列入國安黑名單,禁止其他政府承包商與其合作。

OpenAI則順勢與五角大廈達成協議,允許政府使用ChatGPT進行機密工作——包括分析美國人的搜尋紀錄、GPS軌跡和聊天對話等大量數據。

在政治資金方面,加速主義派投入1億美元支持推翻州級AI法規的候選人,而Anthropic投入2000萬美元支持相反立場。

亞洲視角的獨特考量

這場美國內部的AI哲學戰爭,對亞洲地區具有特殊意義。

首先,地緣政治層面:如果美國AI產業因內部分歧而放緩發展,可能為中國大陸的AI產業提供追趕機會。但同時,過度的安全限制也可能讓美國AI技術對亞洲盟友的開放程度降低。

其次,市場機會:Anthropic的謹慎路線可能為台積電等亞洲晶片製造商創造更穩定的需求,因為安全導向的AI發展通常需要更多的測試與驗證階段。

第三,監管借鑑:新加坡、日本等亞洲國家正在制定AI治理框架,美國這場「安全vs效率」的辯論提供了寶貴的政策參考。

理想與現實的碰撞

然而,最值得關注的是企業行為與理念宣言之間的落差。

Anthropic今年2月正式放棄了「當AI能力超越公司理解和控制能力時停止訓練更強大模型」的承諾,理由是競爭壓力和監管不足。該公司辯稱,只有擁有最先進的AI系統,才能檢測和應對其潛在風險。

這種邏輯似曾相識:為了安全而必須領先,為了領先而必須冒險。

OpenAI方面,其「為人類福祉加速AI發展」的理念與接受軍方監控合約的現實,同樣存在微妙的張力。

相关文章

從人類最古老的具名作者恩赫杜安娜,到柏拉圖與亞里斯多德——古代思想家如何定義「寫作」,以及這個定義為何讓AI生成的文字面臨根本性的挑戰。

AI能通過律師考試、設計抗癌藥物,卻無法真正「聞」到任何東西。一個被主流AI研究遺忘的感官,可能正是實現人類級別智慧的缺失拼圖。

2026年3月,伊朗無人機攻擊阿聯酋AWS數據中心,首開商業數位基礎設施遭戰時蓄意打擊的先例。這對亞洲科技佈局與地緣政治意味著什麼?

AI合成臉孔通過視訊面試、聲音複製詐騙2500萬美元——2024年美國網路犯罪損失達166億美元,年增33%。當攻擊比防禦快,我們還能信任什麼?

观点

分享你对这篇文章的看法

登录加入讨论