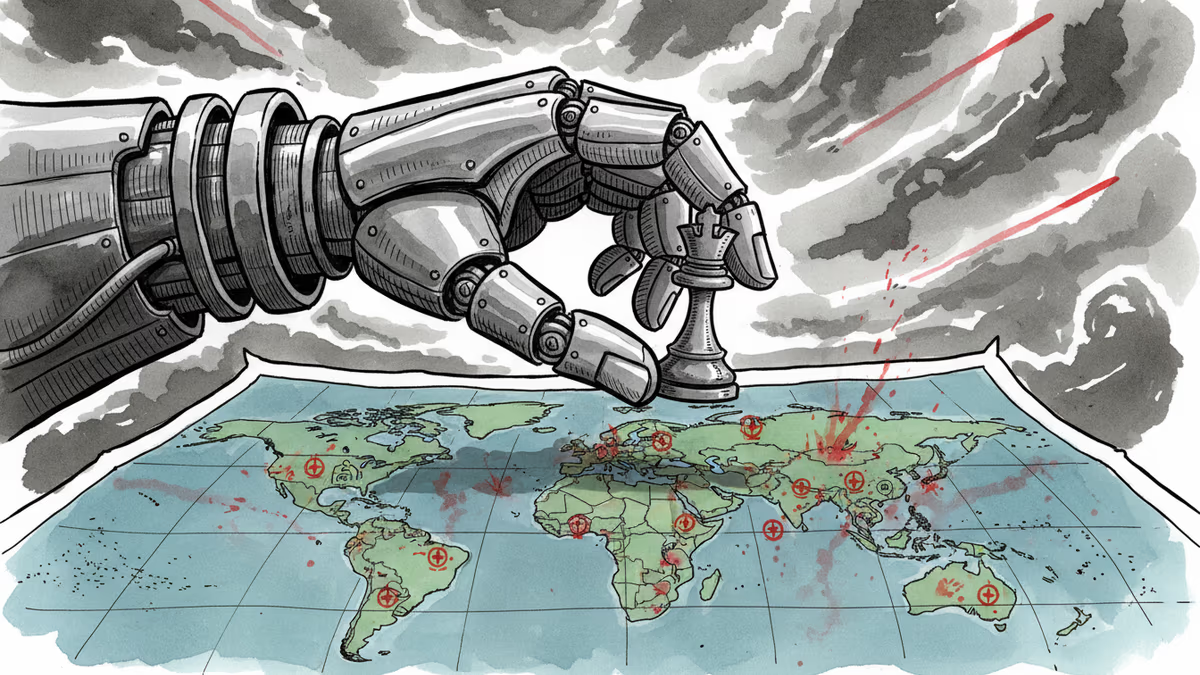

AIが戦争の顔を変える時代、私たちは何を問うべきか

AnthropicのAI「Claude」が米軍のイラン攻撃目標選定に使用されている実態を通して、AI軍事利用の倫理的課題と技術企業の責任を考察します。

AIが人間の代わりに戦争の標的を選ぶ時代が、すでに始まっている。

Anthropicの対話型AI「Claude」が、米軍による対イラン攻撃の目標選定と優先順位付けに実際に使用されていることが明らかになった。Washington Postの報道によると、このAIシステムは「現時点では」人間の監督下で運用されているものの、軍事作戦における意思決定プロセスに深く組み込まれている実態が浮き彫りになった。

技術企業が直面する新たな現実

Anthropicは当初、AI安全性を重視する企業として知られ、軍事利用については慎重な姿勢を示していた。しかし同社との交渉が決裂した後、OpenAIのサム・アルトマンCEOは「機会主義的で杜撰だった」とX上でコメントし、米国防総省との協力に乗り出した。OpenAIは現在、NATOとの契約も追求している。

この動きは、AI企業が直面する根本的なジレンマを浮き彫りにする。技術の中立性を主張しながらも、実際には軍事・政治的な文脈で使用される現実。そして、競合他社が軍事契約を獲得する中で、自社だけが「清廉」であり続けることの困難さだ。

非対称戦争の新たな次元

一方で、イランのShahedドローンが示すように、現代の戦争は「安価な攻撃、高価な防御」という非対称性を特徴としている。1機数万円で製造できるドローンを迎撃するために、数百万円のミサイルが必要となる現実。AIによる目標選定は、この非対称性をさらに複雑化させる要素となりうる。

興味深いことに、米国はShahedドローンのコピーを製造し、イランに対して使用する計画も進めている。技術の模倣と応用が、敵対関係を超えて行われる現代戦争の皮肉な側面でもある。

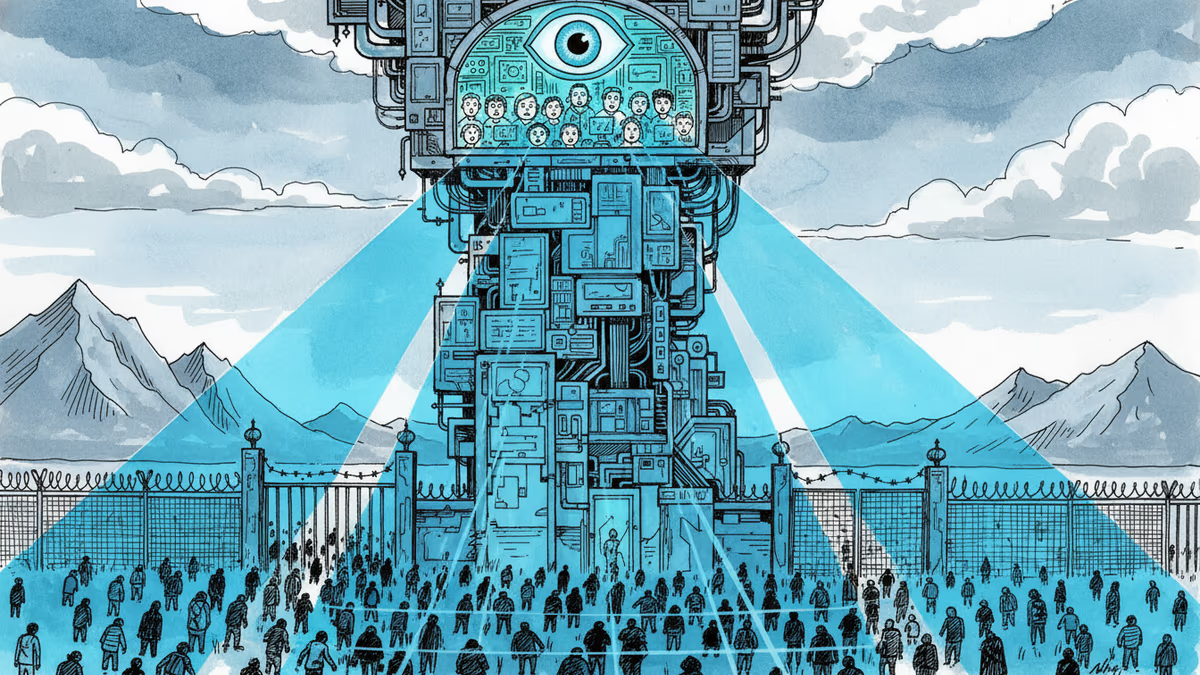

日本が直面する選択

日本にとって、この動向は特に重要な意味を持つ。防衛装備庁は既にAI技術の軍事応用について研究を進めており、三菱重工業や川崎重工業などの防衛関連企業も関心を示している。しかし、憲法第9条の制約下で、どこまでのAI軍事技術開発が許容されるのか。

平和国家としてのアイデンティティと、現実的な安全保障ニーズのバランス。ソフトバンクやNTTなどの技術企業が、将来的に類似の選択を迫られる可能性も否定できない。

関連記事

イーロン・マスクがOpenAIとサム・オルトマンを訴えた裁判が開廷。非営利から営利へのシフトは許されるのか。AI業界の未来を左右する法廷闘争の本質を読み解く。

Anthropicが実施したAIエージェント同士の売買実験「Project Deal」。186件の取引、4,000ドル超の価値。高性能モデルが優位な結果を出す一方、格差に気づかないユーザーの問題が浮上した。

OpenAIはカナダ銃乱射事件の容疑者アカウントを事前に把握・停止していたにもかかわらず、警察への通報を見送った。CEOサム・アルトマンが謝罪したが、問われるのは企業の「判断」の是非だ。

トランプ政権の移民取締りを支えるAI企業Palantir。元社員が「ファシズムへの転落」と表現した内部告発の背景と、テクノロジー企業の倫理的責任について考える。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加