AIを訓練する仕事が、AIに奪われた仕事だった

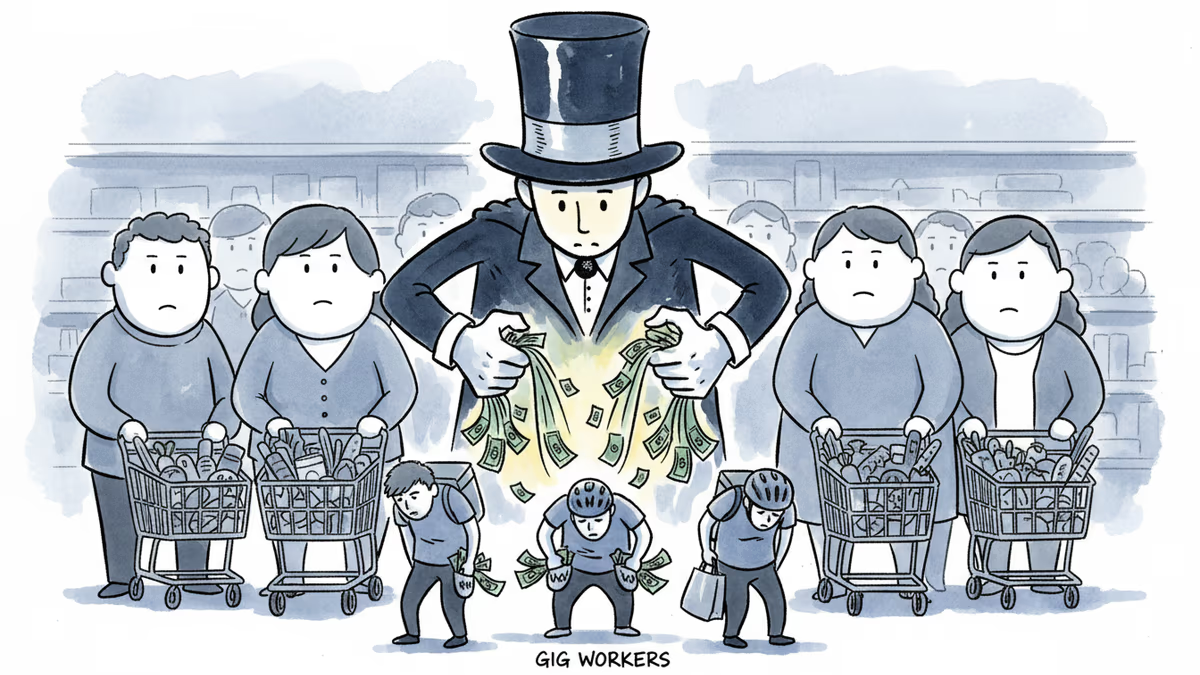

ライター、弁護士、デザイナーたちがAIの訓練データを作る仕事に流れ込んでいる。しかしその労働環境は極めて不安定で、監視は厳しく、報酬は下がり続ける。これは「新しい雇用」なのか、それとも知識労働の解体なのか。

「ChatGPTに仕事を奪われた私が、ChatGPTをもっと賢くするための仕事をしている」——ある元コンテンツライターの言葉です。

「AIトレーナー」という名の新しい仕事

アメリカでは今、ライター、弁護士、グラフィックデザイナー、映像制作者、言語学者といった高度な専門職を持つ人々が、次々とAI訓練データの生成という仕事に流れ込んでいます。彼らを雇っているのは、Mercor、Scale AI、Surge AIといったデータ企業です。これらの企業はOpenAIやAnthropicといったAI開発会社から受注を受け、AIモデルを改善するための「人間の専門知識」を大規模に収集しています。

具体的にどんな仕事なのでしょうか。チャットボットへの質問例を作成し、その理想的な回答を書き、「良い回答とは何か」を定義する詳細な評価基準(ルーブリック)を作成する。あるいは、モデルが失敗するような難問(「stumper」)を考案する。弁護士、コンサルタント、教師たちが集まって架空の企業のビジネス文書を何百枚も作り上げる「ワールドビルディング」プロジェクトもあります。声優が感情豊かなスピーチを録音し、音声AIの訓練に使われることもあります。

Mercorは2023年に設立され、わずか数年で企業評価額100億ドル(約1.5兆円)に達しました。毎週約3万人のプロフェッショナルがプラットフォーム上で働いており、Scale AIは70万人以上の修士・博士号取得者を擁すると主張しています。

しかし、この「新しい雇用」の実態は、表向きの姿とは大きく異なります。

不安定、監視、そして賃金の切り下げ

カティアという元フリーランスジャーナリストの経験は、この業界の典型的な姿を映し出しています。コンテンツマーケティングに転職したものの、AIに仕事を奪われ、失業中にMercorと出会いました。採用面接はAI(「メルビン」という名の音声AI)が担当し、採用後はSlackチャンネルに追加されて作業を開始。しかしプロジェクトは予告なく突然中断され、再開されたと思えば報酬が引き下げられ、要求水準は上がっていました。

労働環境で特に問題視されているのが、Insightfulと呼ばれる監視ソフトウェアです。働いた時間は秒単位で記録され、数分間タイピングが止まると「作業中ですか?」という確認が届きます。「非生産的」と判断された時間は給与から差し引かれます。トイレに行く時間も、コーヒーを入れる時間も、背中を伸ばす時間も「非稼働時間」として扱われます。

さらに深刻なのは、守秘義務の壁です。労働者はどのAI企業のために働いているかを知らされず、プロジェクトはコードネームで管理され、同僚にさえ詳細を話すことは契約で禁じられています。これにより、労働者は自分の経験や実績を外部で証明することができず、交渉力を持てません。

賃金は下落し続けています。あるグラフィックデザイナーが参加したMetaのInstagram Reels動画タグ付けプロジェクトは、突然終了し、24%減の時給16ドルで「Nova」という新プロジェクトとして再開されました。カリフォルニア州の最低賃金を下回る水準でしたが、生活費に困った人々は働き続けました。

なぜ今、この問題が重要なのか

この現象を単なる「AIに仕事を奪われた人々の話」として読むのは、本質を見誤ることになります。

重要なのは、これが「一時的な過渡期の混乱」ではなく、知識労働の構造的な再編かもしれないという点です。MIT経済学教授のダロン・アジェモグル氏は、産業革命前の熟練織工との比較を挙げます。当時の織工は自律的な職人でしたが、機械化によって工場労働者へと転落し、長時間労働・低賃金・厳格な監視という環境に置かれました。現在のAI訓練労働者は、まさにその現代版かもしれません。

違うのは、規模とスピードです。弁護士、医師、ライター、デザイナー——かつては「AIに代替されにくい」とされた高度専門職が、今や自分の専門知識をAIに「教える」仕事をしています。そして一定量のデータが収集されると、その仕事自体も不要になります。言語学の修士号を持つある労働者は1年間安定して働いていましたが、モデルが十分に賢くなると「難問を作れなくなった」と言います。彼は現在5ヶ月間無職です。

日本社会への示唆

この問題は、日本にとっても他人事ではありません。

日本は現在、深刻な労働力不足に直面しており、AIによる生産性向上を積極的に推進しています。ソニー、トヨタ、富士通といった大企業も生成AIの活用を加速させています。しかし、AIの「訓練」に必要な人間の専門知識の調達という問題は、日本でも同様に起きるはずです。

日本の文脈で特に注目すべき点が二つあります。第一に、日本の雇用慣行との摩擦です。終身雇用、年功序列、充実した福利厚生を前提としてきた日本の労働文化において、秒単位の監視と予告なしの契約終了を特徴とするギグ労働は、大きな文化的衝突を引き起こす可能性があります。第二に、少子高齢化との関係です。労働力不足を補うためにAIを導入しつつ、同時に高度専門職の雇用が不安定化するという矛盾した状況が生じかねません。

労働法の観点からも、日本は注目すべき局面にいます。アメリカではMercorに対して3件のクラスアクション訴訟が提起されており、「独立請負業者」という分類の適法性が問われています。日本の労働基準法や労働者派遣法の枠組みでは、こうした働き方はどう扱われるべきでしょうか。

MITのアジェモグル教授は、「データ経済のための法的インフラが整備されなければ、データを生産する多くの人々は不当に低い報酬しか得られないか、より強い言葉を使えば、搾取されることになる」と警告しています。また、「労働者が集団的にデータの所有権を持ち、大企業による分断支配戦略を防ぐような組合的組織が必要かもしれない」とも述べています。

関連記事

ナイジェリアの医学生が帰宅後にiPhoneを額に装着して家事を録画する。その映像がヒューマノイドロボットの訓練データになる。世界50カ国以上で広がる新しい労働形態と、その光と影を読む。

ナイジェリアやインドの若者がiPhoneを額に装着し、家事を録画する。人型ロボット訓練のための新たなギグワークが世界に広がる中、日本社会にとっての意味を考える。

DoorDashが新アプリ「Tasks」を公開。人間が家事や料理を録画することでAI・ロボット開発に貢献する新たなギグワークの実態と、日本社会への示唆を探ります。

ウォルマートがSparkドライバーへの虚偽の給与情報で1億ドルの制裁金。ギグエコノミーの透明性に新たな基準。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加