AI企業と軍部の対立が問う「兵器としてのAI」規制論

Anthropic社と米国防総省の対立を通じて見る、AI技術の軍事利用と規制の必要性。日本の安全保障戦略への影響も考察。

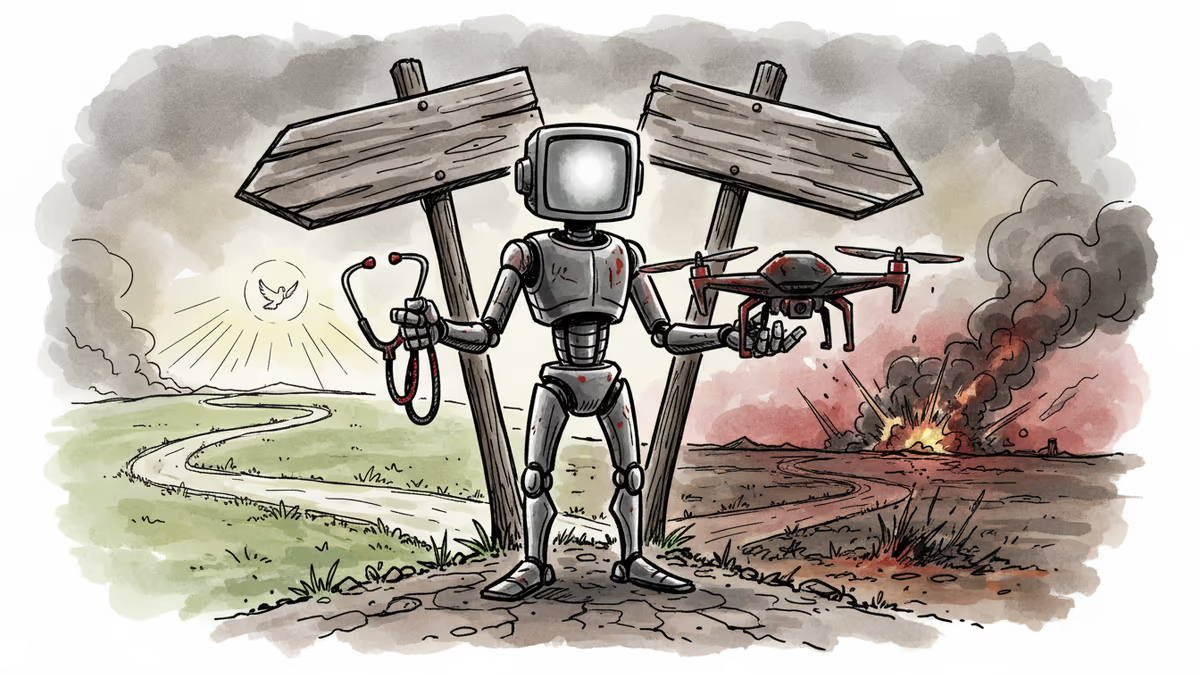

2026年2月、Anthropic社のCEOダリオ・アモデイ氏が米国防総省との契約更新を突如拒否したとき、シリコンバレーとワシントンD.C.の間に新たな緊張が生まれた。この決定は単なる企業判断を超えて、AIが「兵器」として扱われるべきかという根本的な問いを投げかけている。

対立の構図:理想と現実のはざまで

AnthropicはOpenAIと並ぶ最先端AI企業として、「AI安全性」を企業理念の中核に据えてきた。同社の大規模言語モデル「Claude」は、軍事目的での使用を明示的に禁止する利用規約を設けている。しかし、米国防総省は国家安全保障の観点から、こうした最先端AI技術への「合理的なアクセス」を求めている。

この対立の背景には、1兆ドル規模とも言われるAI市場における主導権争いがある。中国のByteDanceやBaiduといった企業が軍民両用技術の開発を加速させる中、米国は技術的優位性の維持を国家戦略として位置づけている。

一方で、Anthropicのような企業は「AI安全性」の観点から慎重な姿勢を崩していない。同社は軍事利用が「制御不能なAI軍拡競争」を引き起こすリスクを懸念している。

日本への波及効果:同盟国としてのジレンマ

日本にとって、この米国内の対立は複雑な意味を持つ。2023年に改定された国家安全保障戦略では、サイバー・宇宙・電磁波領域での能力強化が明記されており、AI技術はその中核を成している。

防衛省は既に富士通やNECといった国内企業と連携し、AI活用の防衛システム開発を進めている。しかし、最先端のAI技術の多くは米国企業が握っているのが現実だ。Anthropicのような企業が軍事協力を拒否すれば、日本の防衛AI戦略にも影響が及ぶ可能性がある。

興味深いのは、日本独自の「AI倫理」アプローチだ。内閣府のAI戦略会議では、「人間中心のAI」という概念が強調されており、これは欧米の「AI安全性」議論とは微妙に異なる視点を提供している。

規制の必要性:新たな軍備管理の枠組み

現在、AI技術に対する国際的な軍備管理の枠組みは存在しない。核兵器や化学兵器と異なり、AIは民生・軍事の境界が曖昧な「デュアルユース技術」としての特性を持つ。

国連では2023年以降、「致命的自律兵器システム(LAWS)」の規制議論が活発化している。しかし、技術の進歩速度に法整備が追いついていないのが現状だ。米国、中国、ロシアといった主要国は、自国の技術的優位性を制限する規制には消極的な姿勢を示している。

日本はG7議長国として、「広島AIプロセス」を主導し、国際的なAIガバナンスの構築に取り組んでいる。この取り組みが、軍事分野でのAI規制にどう発展するかが注目される。

企業の社会的責任と国家安全保障のバランス

Anthropicの決定は、民間企業が国家安全保障政策に対してどこまで独立性を保てるかという問題を浮き彫りにした。Googleが2018年に軍事AI開発プロジェクト「Project Maven」から撤退した事例と類似している。

一方で、PalantirやAndurilのように、明確に軍事・情報分野に特化したAI企業も存在する。こうした企業の台頭は、AI技術の軍事利用が「不可避」であることを示唆している。

日本企業も同様のジレンマに直面している。ソフトバンクのVision FundはAnthropicに5億ドルを投資しており、間接的にこの議論の当事者となっている。

記者

関連記事

トランプ政権が推進するホワイトハウス新宴会場の建設費用は当初の2億ドルから10億ドル超に膨張。連邦裁判所の差し止め命令と議会の反発を受けながら、政権は銃撃事件を「安全保障上の緊急性」として建設継続を正当化しようとしています。

中国系サイバー諜報作戦「Shadow-Earth-053」がアジア7カ国と NATO加盟国ポーランドの政府・防衛ネットワークに侵入。ウイグル人や台湾人活動家への標的型フィッシングも並行実施。日本の安全保障と企業への示唆を読み解く。

2026年5月7日、英米ノルウェーが同日に中国の越境弾圧に対して法的・安全保障上の措置を取った。偶然の一致が浮き彫りにする、民主主義陣営の連携の必要性を読み解く。

中国がMetaによるAIスタートアップManus買収を阻止。5月14日の習近平・トランプ首脳会談を前に、北京の戦略的意図と日本企業への影響を多角的に分析します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加