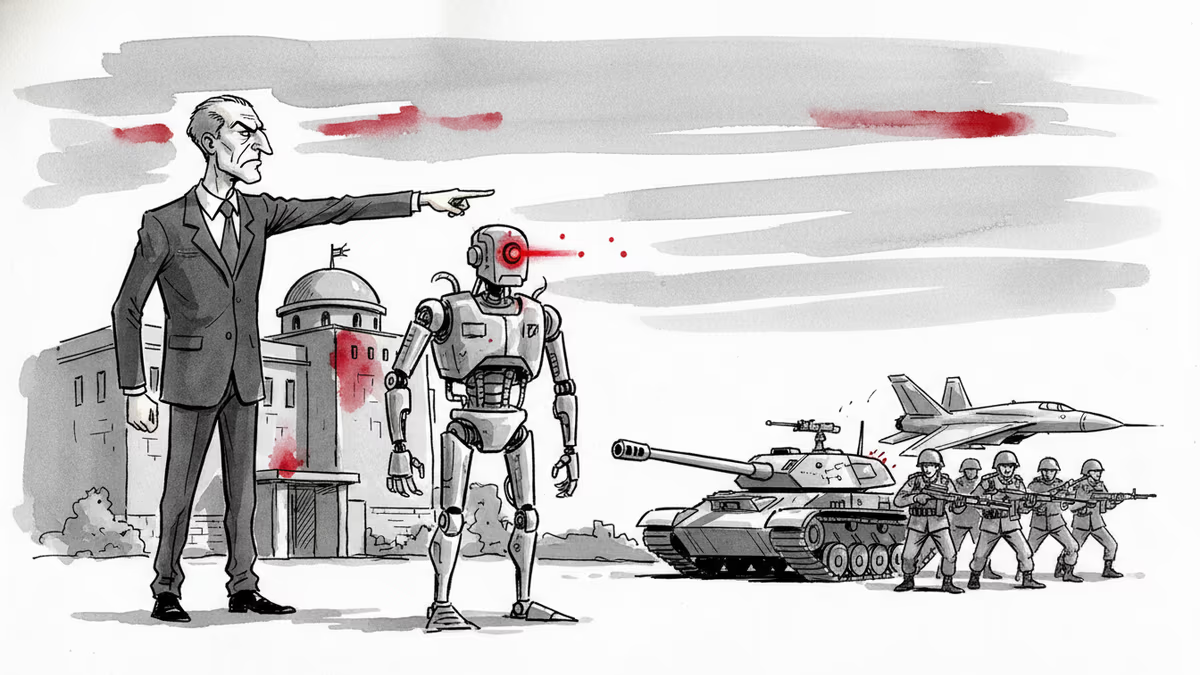

トランプ政権、Anthropic製AI利用を全面停止へ—軍事AI開発を巡る対立が激化

トランプ大統領がAnthropic製AI利用停止を指示。軍事AI開発を巡る政府と民間企業の対立が表面化。日本のAI戦略への影響も注目される。

「左翼のバカども」—トランプ大統領が金曜日、AI企業Anthropicに向けて放った言葉だ。同時に、すべての連邦政府機関に対してAnthropic製AIツールの使用を「即座に停止」するよう指示した。

この決定は、軍事AI応用を巡ってAnthropic社と政府高官が数週間にわたって対立した末の結果だ。トランプ氏はTruth Socialへの投稿で、「AnthropicのLeft-wing nut jobsが国防省を強要しようとして悲惨な間違いを犯した」と述べている。

対立の背景:軍事AI開発への拒否

Anthropic社は、OpenAIやGoogle DeepMindと並ぶ主要AI企業の一つで、安全性を重視したAI開発で知られている。同社のClaude AIは、多くの政府機関で文書作成や分析業務に活用されてきた。

今回の対立の核心は、軍事目的でのAI利用にある。政府側が軍事応用への協力を求めたのに対し、Anthropic側はこれを拒否。同社は創設以来、「AI安全性」を企業理念の中核に据えており、軍事利用は同社の価値観と相反するものだった。

興味深いのは、トランプ氏が6ヶ月の段階的廃止期間を設けたことだ。これは完全な決裂ではなく、交渉の余地を残した措置と見られる。

日本企業への波及効果

日本のAI関連企業にとって、この動きは複雑な意味を持つ。ソニー、富士通、NECなど、米国政府との取引がある日本企業は、自社のAI戦略を見直す必要に迫られる可能性がある。

特に防衛関連技術を手がける企業は、米国の方針変更に敏感に反応せざるを得ない。日本政府も2024年から防衛AI開発を本格化させており、米国との技術協力のあり方が問われることになる。

一方で、これは日本のAI企業にとってチャンスでもある。米国政府がAnthropic製品の使用を停止すれば、代替技術への需要が生まれる。日本企業が開発するAIソリューションが、この空白を埋める可能性もあるのだ。

企業の価値観 vs 国家安全保障

今回の対立は、現代のテック企業が直面する根本的な問題を浮き彫りにしている。企業は利益追求だけでなく、社会的責任も負うべきなのか。そして、その「責任」の定義は誰が決めるのか。

Anthropic側から見れば、軍事利用への協力拒否は一貫した企業理念の表れだ。同社は「AI安全性」を掲げ、技術の悪用を防ぐことを使命としている。軍事協力はこの理念に反するという判断は、ある意味で筋が通っている。

政府側の論理も理解できる。国家安全保障は政府の最重要責務であり、そのために必要な技術協力を民間企業が拒否することは、国益に反するとの見方だ。特に中国やロシアが軍事AI開発を加速させる中、米国が技術的優位を失うリスクは現実的な脅威となっている。

関連記事

AIエージェントの普及が生む新たな経済格差。インドの政府主導モデルから日本企業への示唆まで、「エージェント格差」の実態を多角的に分析します。

アフリカ4大テック経済圏がGoogleやNvidiaへの依存を脱却しようとしている。600億ドルのAIファンドとAI評議会の設立が示す、デジタル主権をめぐる静かな地殻変動を読み解く。

南アフリカがAIハルシネーションを含む国家AI政策草案を撤回。過去2年で5件の政府文書汚染事例を検証し、制度的検証プロセスの欠如が招くリスクを考察する。

Google DeepMindの従業員がイスラエル・米軍へのAI技術提供に抗議し、英国で労働組合結成を決議。CWU加盟員の98%が賛成票を投じた今回の動きが示す、AI産業の新たな倫理的断層とは。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加