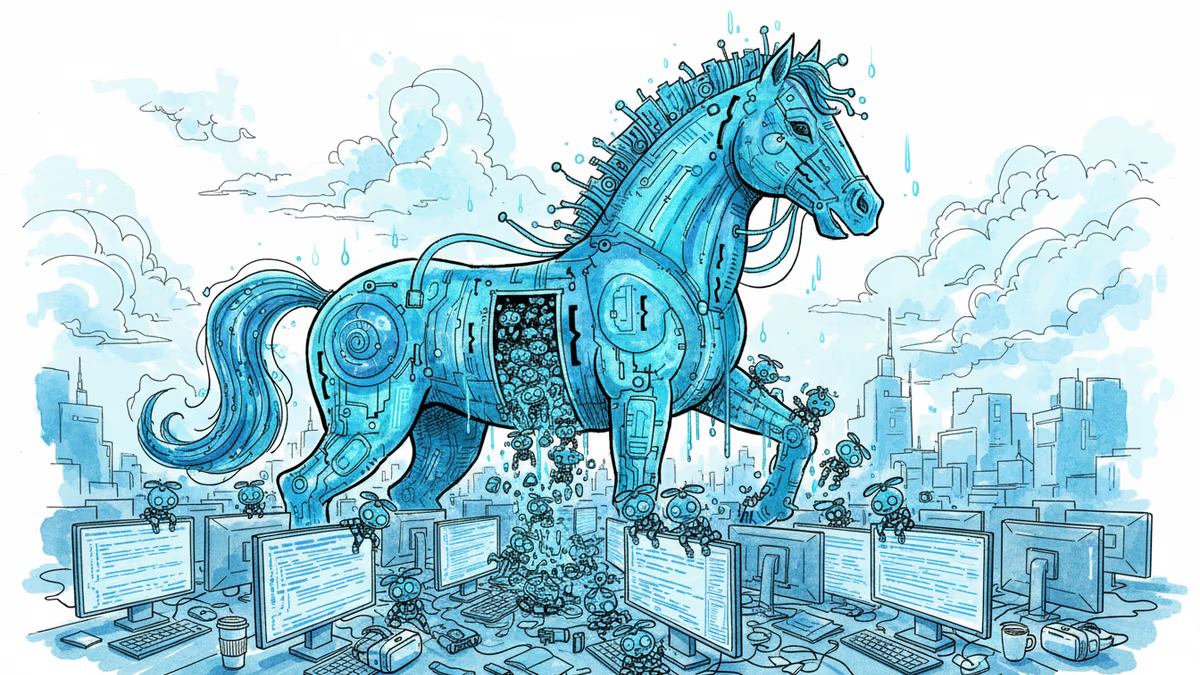

AIエージェントがハッキングされた日:自律ソフトの脆弱性が露呈

人気のAIコーディングツールがハッキングされ、悪意あるAIエージェントが拡散。自律ソフトウェア時代の新たなセキュリティリスクとは?

開発者の間で人気のAIコーディングツール「Cline」が、わずか数日前に発見されたセキュリティ脆弱性を悪用され、悪意あるAIエージェント「OpenClaw」を大量拡散させる事件が発生した。

ハッカーが仕掛けた巧妙な罠

事件の発端は、セキュリティ研究者Adnan Khan氏が概念実証として報告したClineの脆弱性だった。ClineはAnthropicのClaudeを活用して動作するオープンソースのAIコーディングエージェントだが、悪意ある指示を隠し込まれると、本来すべきでない動作を実行してしまう弱点があった。

ハッカーはこの脆弱性を巧妙に利用し、OpenClawという「実際に行動を起こす」ウイルス性AIエージェントを、Clineを使用する開発者のシステム全体に拡散させることに成功した。一見すると面白いスタントのように見えるが、専門家たちは別の見方をしている。

自律ソフトウェア時代の新たな脅威

この事件が示すのは、私たちがAIエージェントに日常業務を委ねる時代に突入する中で浮上する、全く新しいタイプのセキュリティリスクだ。従来のマルウェアは単純にファイルを破壊したりデータを盗んだりするだけだったが、AIエージェントは人間の代わりに判断を下し、行動を起こすことができる。

47%の開発者が既に何らかのAIコーディングツールを業務で使用しているという調査結果もある中、この脆弱性は決して他人事ではない。Clineのような自律型AIツールが企業のシステム内で広く使われるようになれば、一つの脆弱性が組織全体に波及する可能性がある。

日本企業への警鐘

日本の大手IT企業も例外ではない。NTTデータや富士通といった企業が積極的にAI開発支援ツールを導入する中、このような脆弱性への対策は急務となっている。特に、日本企業が重視する「品質管理」の観点から見ると、AIエージェントの動作を完全に制御できない状況は大きなリスクとなりうる。

また、日本の製造業では既に工場の自動化システムにAIを組み込む動きが活発化している。今回の事件は、こうした産業用AIシステムでも同様の脆弱性が存在する可能性を示唆している。

セキュリティ対策の新パラダイム

従来のサイバーセキュリティは「人間が操作するシステム」を前提としていたが、AIエージェントが自律的に動作する環境では、全く異なるアプローチが必要になる。AIの判断プロセスそのものを監視し、異常な動作パターンを検知する技術の開発が急がれている。

Anthropicは今回の事件を受けてClaudeのセキュリティ機能を強化すると発表したが、根本的な問題は残る。AIエージェントが高度化すればするほど、その動作を完全に予測・制御することは困難になるのだ。

関連記事

かつては「お願いするだけ」で突破できたAIの安全機能。技術の進化とともに攻撃も巧妙化する中、AIセキュリティの現在地と私たちへの影響を読み解く。

IBMとスクーデリア・フェラーリHPのパートナーシップが、F1ファンアプリをAIで刷新。62%のエンゲージメント増加の裏に何があるのか。スポーツとAIの融合が示す企業戦略の新潮流を読み解く。

ジャーナリストや活動家を標的にした政府系スパイウェア攻撃が急増。Apple、Google、Metaが提供する無料の防御機能を徹底解説。一般ユーザーにも無縁ではない現実を読む。

AnthropicのCode with Claudeイベントで、参加者の約半数がAIが書いたコードを確認せずにリリースしたと認めた。開発の未来と日本社会への影響を多角的に考察する。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加