ローカルAIが本格化:Ollamaが変えるMac開発の未来

OllamaがAppleのMLXフレームワークとNvidiaのNVFP4形式に対応。Apple Siliconを搭載したMacでのローカルAI実行が大幅に高速化。日本の開発者や企業に何をもたらすのか、多角的に解説します。

クラウドにデータを送らずに、手元のMacだけで大規模言語モデルを動かせる時代が、静かに、しかし確実に近づいています。

Ollamaが動かした「3つの歯車」

ローカル環境でLLM(大規模言語モデル)を実行するためのランタイムシステムOllamaが、このほど重要なアップデートを発表しました。内容は大きく3点です。

まず、Appleのオープンソース機械学習フレームワーク「MLX」への対応。MLXはApple Siliconチップ(M1以降)のアーキテクチャに最適化されており、CPUとGPU、そしてNeural Engineを統合的に活用できます。次に、キャッシュパフォーマンスの改善。繰り返し処理が多いAI推論において、キャッシュ効率の向上は体感速度に直結します。そして、Nvidiaの「NVFP4」形式によるモデル圧縮への対応。これにより、大きなモデルをより少ないメモリで動かすことが可能になります。

これらが組み合わさることで、Apple Siliconを搭載したMacでのローカルAI実行速度と効率が「大幅に向上する」とOllamaは説明しています。

なぜ「今」なのか——OpenClawという文脈

このアップデートのタイミングには、見逃せない背景があります。

OpenClaw(オープンクロウ)というオープンソースプロジェクトが、GitHubで30万以上のスターを獲得し、特に中国を中心に爆発的な注目を集めました。「Moltbook」のような実験的な取り組みも話題になり、「自分のマシンでAIを動かす」という発想が、研究者やマニア層を超えて一般の開発者にまで広がり始めています。

これまでローカルLLMは「試してみたい人が試すもの」でした。しかし今、そのハードルが下がり、「実用として使えるか」を検討する段階に入りつつあります。

日本の開発者・企業にとっての意味

日本市場への影響を考えると、いくつかの観点が浮かび上がります。

プライバシーとセキュリティへの関心という点では、日本企業は従来からデータの外部送信に慎重です。医療、法務、金融など機密性の高い分野では、クラウドベースのAIサービス利用に社内規定や法的制約が伴うことも少なくありません。ローカルLLMの性能向上は、こうした業界での導入障壁を下げる可能性があります。

コスト構造の変化も見逃せません。OpenAIやGoogleのAPIを使い続けるとランニングコストが積み上がります。一方、自社のMacやワークステーションでモデルを動かせれば、特定のユースケースでは大幅なコスト削減が期待できます。

ただし、現時点ではローカルで動くモデルの能力は、最先端のクラウドモデルと比べると依然として差があります。「何のタスクに使うか」によって、ローカルが適切かどうかは変わります。

| 比較項目 | クラウドAI(API) | ローカルAI(Ollama+MLX) |

|---|---|---|

| モデル性能 | 最先端 | 中〜上位(差は縮小中) |

| コスト | 従量課金(積み上がる) | 初期投資のみ |

| プライバシー | データ外部送信あり | 完全ローカル |

| セットアップ | 簡単(API key) | やや技術的知識が必要 |

| オフライン利用 | 不可 | 可能 |

| スケーラビリティ | 高い | ハードウェア依存 |

5年後も意味があるか

ローカルAIの方向性は、単なる「クラウドの代替」ではないかもしれません。

エッジコンピューティングとAIの融合、デバイス上でのパーソナライズ、ネットワーク接続なしでの動作——これらはすべて、インフラや通信環境が多様な世界で重要性を持ちます。日本でも、工場のフロア、医療現場、農村部など、クラウドへの常時接続が難しい環境は少なくありません。

AppleがMLXをオープンソースで公開し、Ollamaがそれを取り込んだという流れは、エコシステム全体がローカルAIを「本物の選択肢」として育てようとしているサインとも読めます。

関連記事

SpaceXのIPO申請書が初めてxAIの財務を公開。2025年に売上32億ドルに対し64億ドルの営業損失。Grokの次世代モデルは「数兆パラメータ」を目指すが、投資家は何を見るべきか。

SpaceXがIPO申請書を公開。時価総額175兆円超を目指す同社の収益の半分はStarlinkが支え、AIに年間2兆円を投じる。日本市場への影響と、マスク氏の「火星植民地」報酬プランの実態を読み解く。

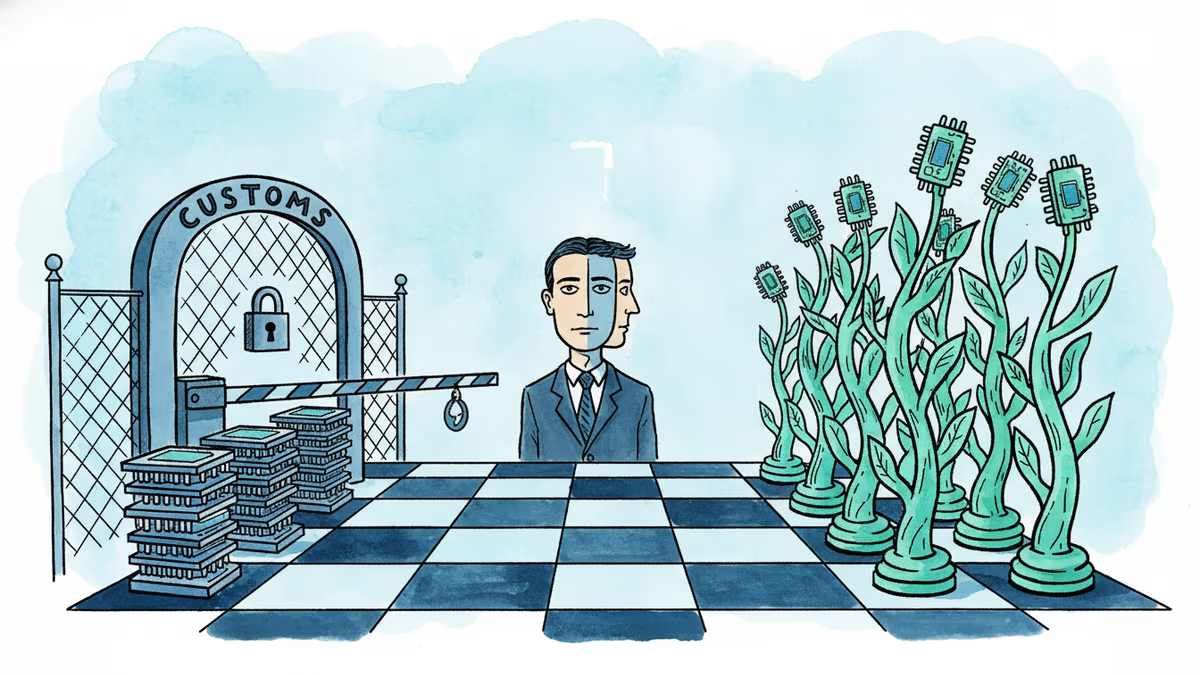

中国がNvidiaのゲーミングチップを禁輸リストに追加。ジェンスン・フアンCEOが訪中中のタイミングで下された決定が示す、米中半導体覇権争いの深層を読む。

GoogleがAI画像生成・編集アプリ「Pics」をGoogle Workspaceに導入。CanvaやClaude Designに挑むこの動きは、デザイン業界と日本の中小企業に何をもたらすのか。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加