米国防総省がAnthropic社を「サプライチェーンリスク」指定 - AI時代の新たな安全保障論争

米国防総省がAI企業Anthropicを「サプライチェーンリスク」に初指定。防衛契約企業のClaude利用を禁止し、AI時代の安全保障政策に新たな議論を呼んでいる。

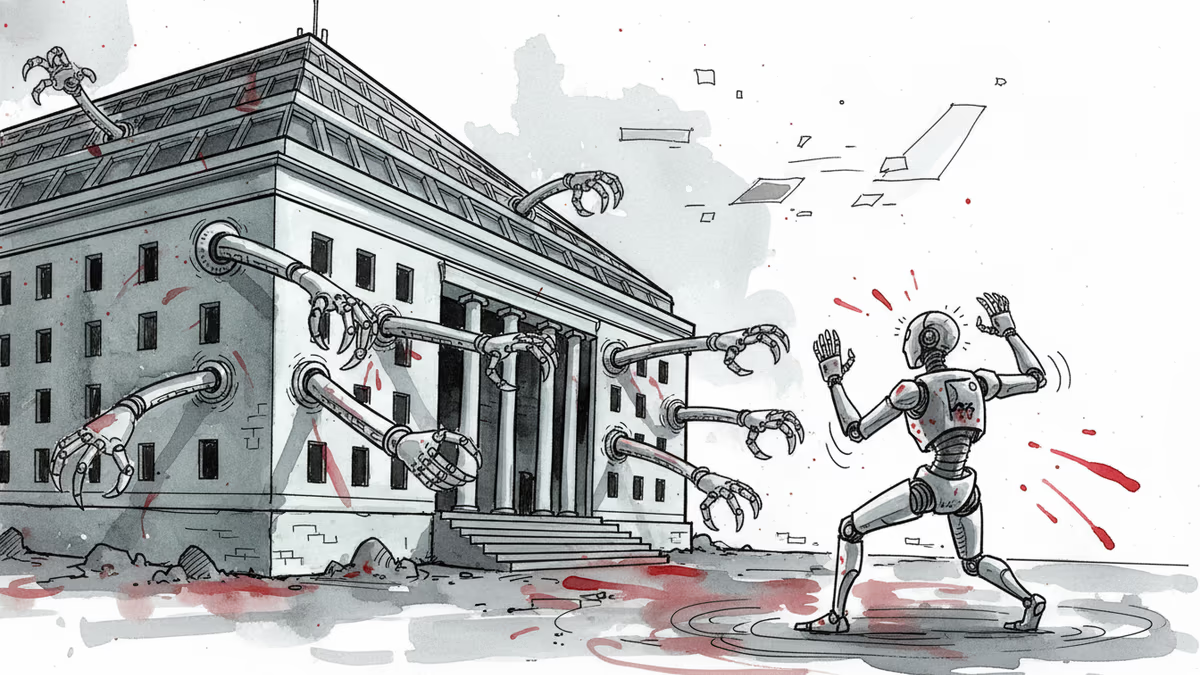

数週間に及ぶ交渉の決裂、公開での最後通告、訴訟の脅しを経て、米国防総省はAnthropic社を「サプライチェーンリスク」として正式に指定しました。この決定により、防衛契約企業が同社のAIプログラムClaudeを製品に使用する場合、政府との契約が禁止されることになります。

前例のない米国企業への指定

ウォール・ストリート・ジャーナルが木曜日に報じたこの決定は、AI時代における安全保障政策の新たな局面を示しています。「サプライチェーンリスク」指定は通常、敵対的政府とのつながりを持つ外国企業に適用されるものですが、米国企業に対する初の適用となります。

争点となっているのは、Anthropic社の利用規約です。国防総省は同社のAI使用ポリシーが軍事用途に対して過度に制限的であると主張。一方、Anthropic側は自社の安全基準を維持する権利を主張し、両者の溝は深まるばかりでした。

日本の防衛産業への波及効果

この決定は日本の防衛関連企業にも影響を与える可能性があります。三菱重工業、川崎重工業、富士通など、米国との防衛協力を行う日本企業の多くは、AI技術を積極的に導入しています。これらの企業がClaudeを使用している場合、米国との共同プロジェクトから除外される可能性があります。

特に注目すべきは、日本政府が推進するAI戦略との整合性です。日本は2024年にAI基本法を制定し、民間企業のAI活用を促進してきました。しかし、今回の米国の決定は、AI技術の軍民両用性をめぐる新たな課題を浮き彫りにしています。

AI企業の責任と国家安全保障のバランス

Anthropicのケースは、AI企業が直面する根本的なジレンマを象徴しています。技術の悪用を防ぐための倫理的配慮と、国家安全保障への貢献要請の間で、どのようなバランスを取るべきなのでしょうか。

同社は2021年の設立以来、「AI安全性」を企業理念の中核に据えてきました。しかし、その姿勢が今や政府との対立を生み、ビジネスにも影響を与える状況となっています。これはOpenAIやGoogle DeepMindなど、他のAI企業にとっても看過できない先例となるでしょう。

関連記事

米国防総省が確認:敵対勢力が商業的位置情報データを使い、戦場の米軍兵士を追跡・監視。広告テクノロジー産業が「国家安全保障上の脅威」として問われ始めた。

産休・育休中にAIコーディングツールが普及し、復職後に「スキルギャップ」に直面する女性エンジニアたちの実態。技術変化が働く母親に与える不均衡な影響を多角的に分析する。

YouTubeが新AI機能「カスタムフィード」を発表。見たい動画をテキストで入力するだけで、パーソナライズされた専用フィードが生成される。この変化はコンテンツ消費の何を変えるのか。

ブラウザのサイドチャネル攻撃「FROST」が、SSDのタイミング計測により閲覧履歴やアプリ情報を盗み見る。一般ユーザーから企業まで影響する新手法を解説。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加