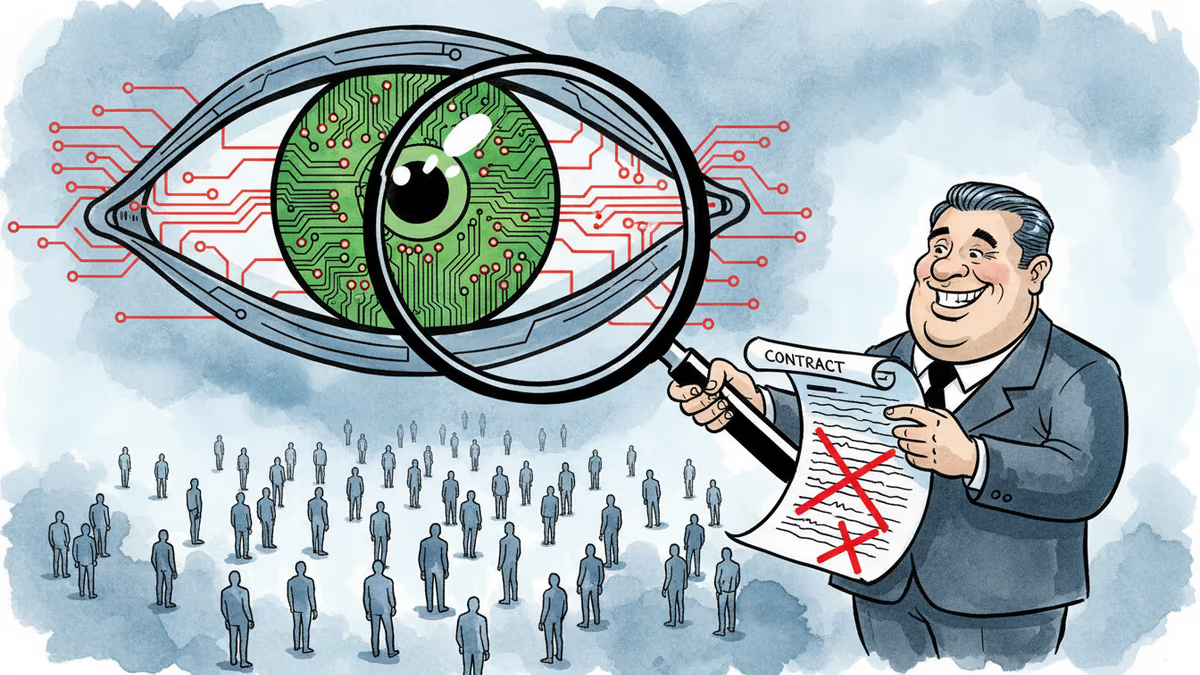

OpenAIと国防総省の契約で見えた「AIの軍事利用」の曖昧な境界線

OpenAIが国防総省との契約で設定した「レッドライン」は本当に国内監視や自律兵器を防げるのか。契約条項の分析から見える問題点とは。

OpenAI本社前の歩道で、色とりどりのチョークを手にした数人の人々が膝をついていた。「自由を守れ」「法的大量監視はお断り」「契約を変更して」──彼らが書いたメッセージは、同社が国防総省と結んだ契約への抗議だった。

問題となっているのは、OpenAIが最近締結した軍事契約だ。国防総省がAnthropicとの関係を突然断ち切った後、OpenAIが代わりに軍事機密環境での技術提供を引き受けることになった。戦時の意思決定や諜報活動に関わる可能性のある分野での利用──多くの法律専門家によれば、政府に広範囲な権限を与える可能性のある合意だという。

「レッドライン」の約束とその実態

サム・アルトマンCEOが先週木曜の夜に送った内部メモには、国防総省によるOpenAI製品の「国内大量監視」と「自律致死兵器」への使用を防ぐ「レッドライン」を設定すると記されていた。これらはAnthropicが要求し、国防総省を激怒させた制限と同じものだった。

しかし、契約書の詳細な分析──少なくともOpenAIが公開した部分──によると、実際の境界線は曖昧だ。複数の独立した法律専門家によれば、法的には国防総省がOpenAIの技術(ChatGPTの基盤となるモデル)をアメリカ人の大量監視に使用することは可能だという。さらに、軍事部門は自律兵器でのOpenAI技術使用への道筋も確保している可能性が高い。

「国民はOpenAIを信頼するかしないかという厄介な選択を迫られている」と、シンクタンク「法律とAI研究所」の上級研究員チャーリー・ブロック氏は語る。オバマ政権下で陸軍の法務総監と次官を務めたブラッド・カーソン氏はより辛辣だ。「OpenAIは一般人が大量監視と考えるものにChatGPTを使用することを容認しているように見える」

混乱する説明と契約条項の矛盾

過去1週間、アルトマン氏とOpenAIは契約について複数の発表を行い、土曜日のブログ投稿では契約条項の一部を公開した──しかし数日後にはその内容を修正している。同社のメッセージは混乱しており、自社の以前の声明や政府の情報と矛盾することもあった。

OpenAIは技術の特定用途について「レッドライン」があると述べていたが、当初公開した契約条項はその逆を示唆していた。また、政府によるOpenAIモデルの使用に独自の制限を設けたと示唆していたが、国務省高官のジェレミー・レウィン氏は、契約は単にOpenAIシステムの「すべての合法的使用」を許可するものだと述べている。

「最良の解釈でも彼らが完全に把握していないように見え、最悪の場合、公正かどうかは別として、OpenAIがあまり率直でない傾向があるという認識を強化する」と、新興技術を研究するミネソタ大学の法学教授アラン・ローゼンシュタイン氏は指摘する。

契約条項に潜む抜け穴

土曜日のブログ投稿でOpenAIが公開した契約の一部は、「国防省はAIシステムを適用法に従って、すべての合法的目的に使用できる」と始まっている。そして諜報活動でのOpenAIシステム使用は、1978年外国情報監視法(FISA)など、アメリカ人への監視を可能にしてきた法律や政策に「準拠する」としている。

FISAや関連政策の下では、諜報機関はアメリカ人と海外の人々との間の通話を記録・保存し、企業から大量のユーザーデータを購入・分析することができる。これは直接的な通信傍受を伴わない。

「一般の人々が自動化された大量監視と理解するものの多くが、単純に違法ではない」とローゼンシュタイン氏は説明する。例えば、生成AIは以前は圧倒的で不透明だった記録──税務申告書、連邦職員ファイル、数十億の傍受通信、スマートフォンの位置データなど──を正確な洞察の宝庫に変えることができる。

月曜日の契約修正とその限界

月曜日、OpenAIはブログを修正し、アメリカ人のAI支援スパイ活動からのより良い保護のために国防総省との契約を修正したと発表した。新しい文言では「AIシステムは米国人および国民の国内監視に意図的に使用されない」とし、「疑念を避けるため」国防総省は「商業的に取得された個人または識別可能な情報の調達や使用を通じたものを含む、米国人または国民の意図的な追跡、監視、またはモニタリングを禁止する」この制限を理解している、としている。

しかし、外部の法律専門家によれば、新しい文言でも「意図的」や「故意の」などの用語が「付随的」とみなされるデータ収集に実質的な余地を提供している。多くの商業的に取得されたデータは「個人的または識別可能」とはみなされない可能性がある。

「一般の人々が監視と考えるものは、国家安全保障当局の下での監視の意味とは全く異なる」とカーソン氏は述べる。修正は「良さそうに見える曖昧なもの」──実質的な保証のない見せかけに過ぎないという。

信頼の問題と政府の圧力

すべての議論は、契約上の禁止事項がAIシステムの大量国内監視や自律兵器への使用を防ぐ主要な要因であるという信念に基づいている。しかし、これは必ずしも真実ではない。やる気のある弁護士なら、ほぼどんな文言でも悪意を持って解釈できる。

OpenAIは技術的な「安全スタック」や監視システムを実装し、自社のエンジニアが国防総省と協力することで「これらのレッドラインが越えられていないことを独立して検証」できると述べている。しかし、政府とOpenAIがChatGPTの使用が許可されているかどうかで意見が分かれた場合はどうなるのか?

Anthropicをブラックリストに載せることで、国防総省は「行き詰まりに陥った場合、恐れることはない」ことを示した、と政府契約法の専門家ジェシカ・ティリップマン氏は指摘する。実際のレッドラインはOpenAIや他のAI企業にとって明確だ:政府の条件で働くか、全く働かないかだ。OpenAIは選択を行った。

記者

関連記事

AIを搭載したぬいぐるみ「Bondu」が親の罪悪感を救うのか。スクリーンタイム不安という現代の育児文化を多角的に読み解く。

AI導入を急ぐ企業と、現場の実態には大きなギャップがある。生産性向上どころか認知疲労を招く「AI脳疲労」現象が、医療・教育・広報の現場で静かに広がっている。

非営利団体「80,000 Hours」創設者ベンジャミン・トッドの新著が問う、AI時代のキャリア選択。管理職・AI活用スキルが鍵となる中、日本社会への示唆とは。

AIツールを多用した著書に偽引用が発覚した著者スティーブン・ローゼンバウム氏の事例を軸に、AI時代における「書く」という行為の本質と、知的誠実さの境界線を問い直す。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加