AI業界vs国防総省:シリコンバレーが結束した日

AnthropicがペンタゴンのSCR指定を巡り提訴。GoogleとOpenAIの研究者30名以上がアミカスブリーフに署名。AIガバナンスと米国競争力を問う法廷闘争の深層を読む。

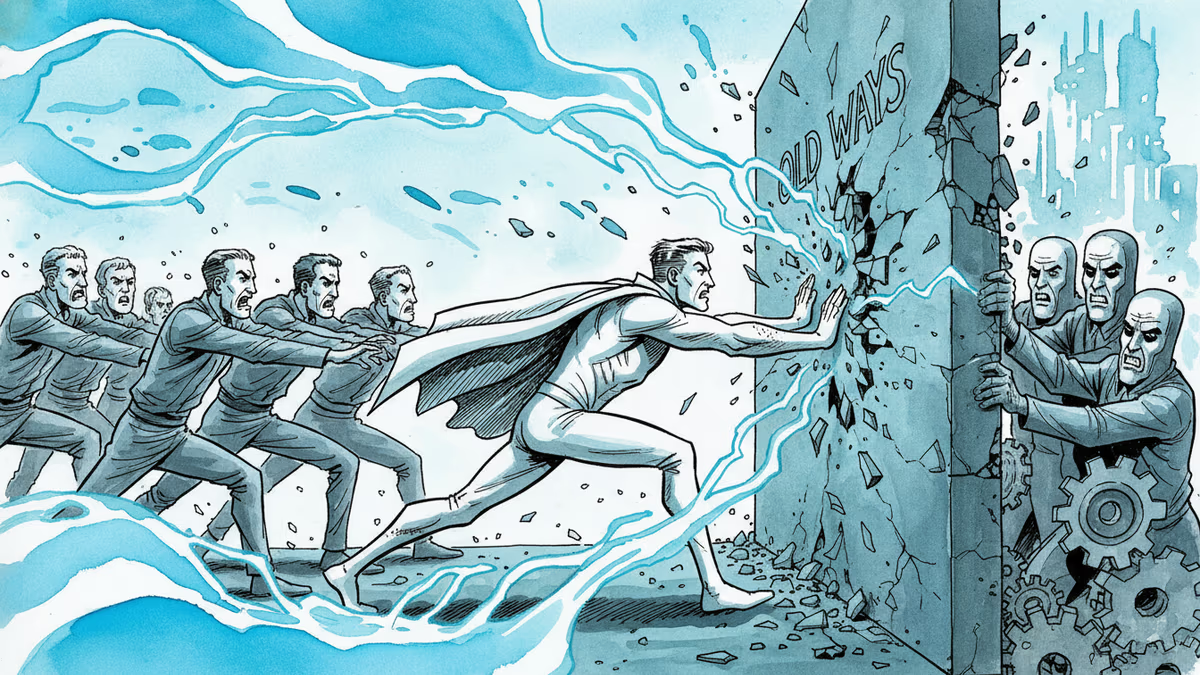

ライバル同士が、同じ書類に署名した。

Google DeepMindの主席科学者Jeff Dean氏をはじめ、OpenAIとGoogleの研究者30名以上が、競合他社であるAnthropicを支持するアミカスブリーフ(法廷助言書)に連名で署名した。AI業界における「競合」と「連帯」の境界線が、かつてないほど曖昧になった瞬間だった。

何が起きたのか:ペンタゴンの「ブラックリスト」

事の発端は、米国防総省(ペンタゴン)がAnthropicを「サプライチェーンリスク(SCR)」に指定したことだ。この指定は、Anthropicが軍事請負業者と協力する能力を著しく制限するもので、実質的な取引禁止措置に近い。

交渉の決裂が引き金だった。Anthropicはペンタゴンとの契約交渉の中で、いくつかの「レッドライン」を設けるよう求めていた。具体的には、自社のAIが「国内大規模監視」や「自律型致死兵器の開発」に使用されないことを保証する条項だ。この要求がペンタゴン側に受け入れられず、交渉が破綻。その結果として、SCR指定という異例の措置が発動された。

Anthropicは2026年3月9日、国防総省および関連連邦機関を相手取り提訴した。提訴からわずか数時間後、OpenAIとGoogleの研究者たちがアミカスブリーフを提出。訴訟が進行する間も軍事パートナーとの業務を継続できるよう、暫定的差し止め命令を求めている。

アミカスブリーフとは、訴訟の直接の当事者ではないが、専門的知見を持つ第三者が裁判所に提出できる意見書だ。今回の署名者には、Google DeepMind研究者のZhengdong Wang氏、Alexander Matt Turner氏、Noah Siegel氏、そしてOpenAI研究者のGabriel Wu氏、Pamela Mishkin氏、Roman Novak氏らが含まれる。いずれも「個人の立場」での署名であり、各社の公式見解を代表するものではないとされている。

なぜ今、これほど重要なのか

表面上は一企業の法的紛争に見えるが、その射程はずっと広い。

アミカスブリーフは、ペンタゴンの決定が「業界全体に予測不可能性をもたらし、米国のイノベーションと競争力を損なう」と主張する。さらに踏み込んで、「フロンティアAIシステムの利益とリスクに関する専門的議論を萎縮させる」とも述べた。要するに、政府が特定のAI企業を罰することで、業界全体が萎縮するという警告だ。

OpenAIのCEO Sam Altman氏もSNSで「Anthropicへのサプライチェーンリスク指定の強制執行は、業界と国家にとって非常に悪い」と発言している。ただし同氏の発言には複雑な背景がある。Anthropicとペンタゴンの関係が悪化する中、OpenAIは独自に米軍との契約を迅速に締結した。この動きは一部から「機会主義的」と批判されており、Altman氏の発言の重みをどう解釈するかは、読む側の判断に委ねられる。

三つの視点から読み解く

企業側の論理:AI開発者にとって、今回の件は「契約条件を巡る倫理的立場が、事業継続を脅かすリスクになりうる」という前例を作りかねない。Anthropicが求めた条項——監視や自律型兵器への不使用——は、AI安全性の観点から見れば合理的な要求だ。アミカスブリーフも「公法が存在しない状況では、AI開発者が課す契約上・技術上の要件が、壊滅的な誤用に対する重要なセーフガードになる」と指摘している。

政府側の論理:ペンタゴンの立場は公式には明らかにされていないが、軍事調達において請負業者が独自の「倫理的レッドライン」を設けることへの懸念は理解できる。国防上の意思決定において、民間企業の価値観がどこまで優先されるべきかという問いは、単純に答えが出るものではない。

日本への接続点:この問題は日本にとっても他人事ではない。ソニーや富士通、NTTなど日本の大手企業も、米国のAI企業との協業を深めている。仮にAI企業がSCR指定を受けた場合、日本企業のサプライチェーンにも影響が及ぶ可能性がある。また、日本政府が防衛分野でのAI活用を進める中、「AI開発者の倫理的制約」と「軍事的要求」の折り合いをどうつけるかは、日本自身も直面しうる課題だ。

前例のない法廷闘争の行方

今回の訴訟で注目すべき点は、Anthropicが単に「SCR指定の撤回」を求めているだけでなく、暫定的差し止め命令という形で「訴訟中も業務継続」を求めていることだ。これが認められれば、政府のAI規制に対して民間企業が法的に対抗できることを示す重要な判例になりうる。

一方で、仮にAnthropicが敗訴した場合、AI企業が政府調達において倫理的条件を交渉する余地は大幅に狭まるかもしれない。AI安全性のための自主的な取り組みが、事業リスクとして扱われる世界——それは、AI開発の方向性そのものを変えかねない。

関連記事

イーロン・マスクがOpenAIとサム・オルトマンCEOを訴えた裁判が開幕。1340億ドルの損害賠償請求と、AI業界の覇権争いの行方を徹底解説します。

イーロン・マスクがOpenAIとサム・オルトマンを訴えた裁判が開廷。非営利から営利へのシフトは許されるのか。AI業界の未来を左右する法廷闘争の本質を読み解く。

スタンフォード大学の内側を暴いた新著『How to Rule the World』が問いかける。シリコンバレーの野心文化は、学生たちに何をもたらしているのか。成功の代償とは何か。

Anthropicが実施したAIエージェント同士の売買実験「Project Deal」。186件の取引、4,000ドル超の価値。高性能モデルが優位な結果を出す一方、格差に気づかないユーザーの問題が浮上した。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加