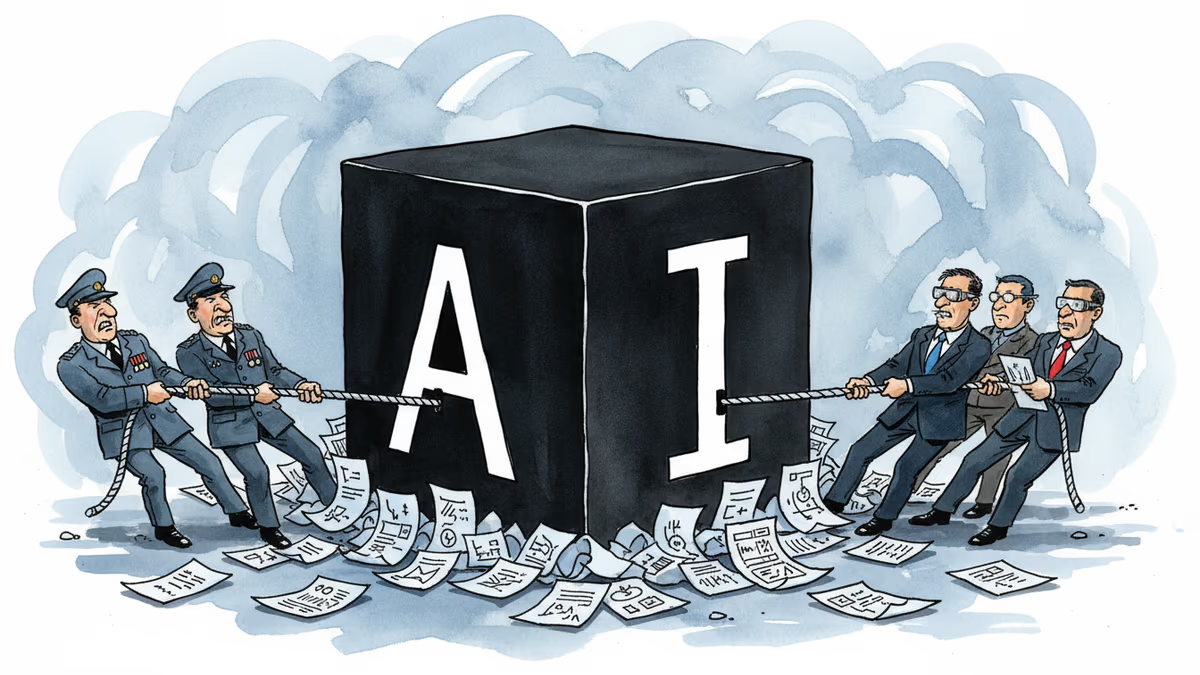

OpenAI軍事契約の迷走:AIガバナンスの透明性はどこへ

OpenAIが米軍との契約で社内混乱を招いた背景には、曖昧なポリシーと不透明な意思決定プロセスがあった。AI企業のガバナンスに求められるものとは。

OpenAIのサム・アルトマンCEOが今週、同社の米軍契約について「雑だった」と認めざるを得なくなった。しかし、この問題の根は想像以上に深い。

見えない契約の実態

2023年、OpenAIの利用規約は軍事利用を明確に禁止していた。ところが同じ年、社員たちは国防総省がすでにMicrosoftのAzure OpenAIを通じてAIモデルを実験していることを発見する。さらに驚くべきことに、国防総省の職員がOpenAIのサンフランシスコオフィスを歩き回る姿も目撃されていた。

社員の多くは混乱した。自社のポリシーはMicrosoftには適用されないのか?当時、この点は多くの社員にとって不明確だったと関係者は証言している。

Microsoftは数十年にわたって国防総省と契約を結んできたOpenAI最大の投資家であり、同社技術の商業化について広範な権限を持っていた。この複雑な関係性が、ポリシーの実効性を曖昧にしていたのだ。

方針転換の舞台裏

2024年1月、OpenAIは軍事利用の全面禁止を撤回した。皮肉なことに、多くの社員はこの重要な方針変更をThe Interceptの記事で知ったという。その後の全社会議で、経営陣はこの分野で慎重に進むと説明したが、透明性への疑問は残った。

12月にはAndurilとの提携を発表。社員には「範囲は限定的で機密扱いではない作業のみ」と説明された。これはAnthropicがPalantirと結んだ機密軍事作業を含む契約とは対照的だった。

興味深いのは、OpenAIがPalantirの「FedStart」プログラムへの参加を「リスクが高すぎる」として断ったことだ。しかし現在は別の形でPalantirと協力している。

社内の温度差

今回の国防総省契約では、数十人の社員が懸念を表明するSlackチャンネルに参加した。「クレジットカード情報の処理すら信頼できないモデルが、戦場でアメリカ人を支援するなんて」という声もあった。

一方で、Anduril提携を責任ある軍事パートナーシップの証拠と見る社員もいる。現職研究者は「OpenAIのアプローチは『二度測って一度切る』方式だ」と評価している。

日本への示唆

日本企業にとって、この事例は重要な教訓を含んでいる。ソニー、トヨタ、NTTなど、AI技術を軍事・防衛分野に応用する可能性を持つ企業は少なくない。しかし、技術の軍事利用に対する社会的合意形成や、透明なガバナンス体制の構築は十分だろうか。

特に日本では、平和憲法の理念と技術革新のバランスについて、より深い議論が必要かもしれない。企業の社会的責任と国家安全保障の要請をどう両立させるか。これはOpenAIだけでなく、日本の技術企業も直面する課題だ。

関連記事

ローマ法王レオ14世の初回回勅にAnthropicの共同創業者が登壇。宗教とシリコンバレーの異例の接近が示す、AIガバナンスの本質的な問いとは。

ローマ教皇レオ14世の回勅「マニフィカ・ウマニタス」はAIを技術問題ではなく人間の尊厳と権力の問題として捉え、アルゴリズムによる支配への警鐘を鳴らしています。日本社会への示唆を読み解きます。

ローマ教皇レオ14世が初の回勅「マニフィカ・フマニタス」を発表。Anthropic共同創業者の立ち会いのもと、AIの「武装解除」を訴えたその真意とは。AI倫理・社会的影響を4万語で論じた歴史的文書を読み解く。

教皇レオ14世が初の回勅「Magnifica Humanitas」でAIの危険性を警告。AI兵器、労働への影響、法的枠組みの必要性を論じた文書が世界に問いかけるものとは。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加