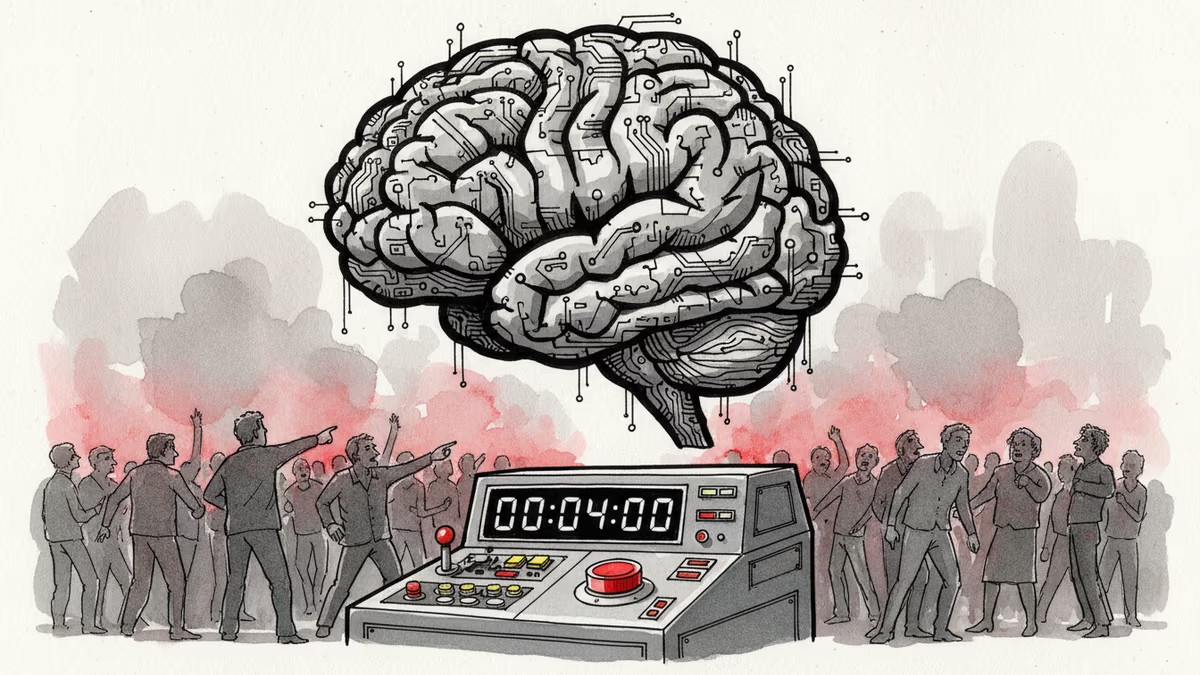

AI企業と軍事の境界線:核攻撃シナリオで露呈した価値観の衝突

トランプ政権がAnthropic社を政府調達から排除。核攻撃対応でのAI利用を巡る議論が、シリコンバレーと国防総省の根深い価値観の違いを浮き彫りに。

2,600万円のコストで開発されたAIシステムが、核ミサイルの飛来を検知した瞬間、人類の運命が決まるかもしれない。

トランプ大統領は金曜日、AI企業Anthropicの製品を連邦政府全体で使用停止するよう命令した。同社を「急進的左派のウォーク企業」と呼び、軍事意思決定への関与を阻止すると発表した。この決定の背景には、核攻撃対応におけるAI利用を巡る、シリコンバレーと国防総省の根深い価値観の衝突がある。

核の瞬間に問われる企業の責任

報道によると、昨年12月、国防次官のエミール・マイケル氏がAnthropicのCEOダリオ・アモデイ氏に質問した内容が発端となった。「米国に向けて核ミサイルが飛来している状況で、自律兵器との連携禁止を理由に、あなたの会社は祖国を助けることを拒否するのか」

アモデイ氏の回答は「国防総省から連絡をいただいて確認します」というものだった。この慎重な姿勢にマイケル氏は激怒したという。Anthropic側はミサイル防衛に関する例外措置を作る意向があったと否定しているが、この会話が両機関の関係を決定的に悪化させた。

問題の核心は、AIが核兵器指揮統制システムにどの程度統合されるべきかという議論にある。米軍は既に「人間の意思決定を可能にし、加速させる」ためのAIと機械学習の活用方法を積極的に検討している。

人間の直感vs機械の判断

核兵器とAIの議論は通常、機械に核攻撃の決定権を与えるべきかという点に集中する。しかし専門家は、この議論は「低い果実」だと指摘する。米国も他国も、核攻撃の決定をAIに委ねることはないだろう。

より複雑な問題は、「戦略的警告」機能でのAI依存度だ。衛星、レーダー、その他センサーシステムから収集される膨大なデータを統合し、潜在的脅威を可能な限り早期に検知する機能である。

マイケル氏がアモデイ氏に提案したのは、まさにこの種の仮想的使用例だった。迎撃の成功率を高めるだけなら当然の選択に思える。しかし、弾道ミサイル攻撃を受けた状況では、大統領は数分以内に報復するかどうかの決定を迫られ、それが全面核戦争の引き金となる可能性がある。

数百万人の命が、システムの正確性にかかっているのだ。核兵器の歴史には、検知システムの誤作動による危機一髪の事例が数多く存在し、人間の直感だけが破滅を回避してきた。

日本への示唆:技術と責任の狭間で

元空軍中将で国防総省合同AI センター長を務めたジャック・シャナハン氏は、核脅威検知と対応をAIエージェントに委ねることについて「破滅的結果は確実とは言えないが、その道を歩んでいると思う」と警告する。

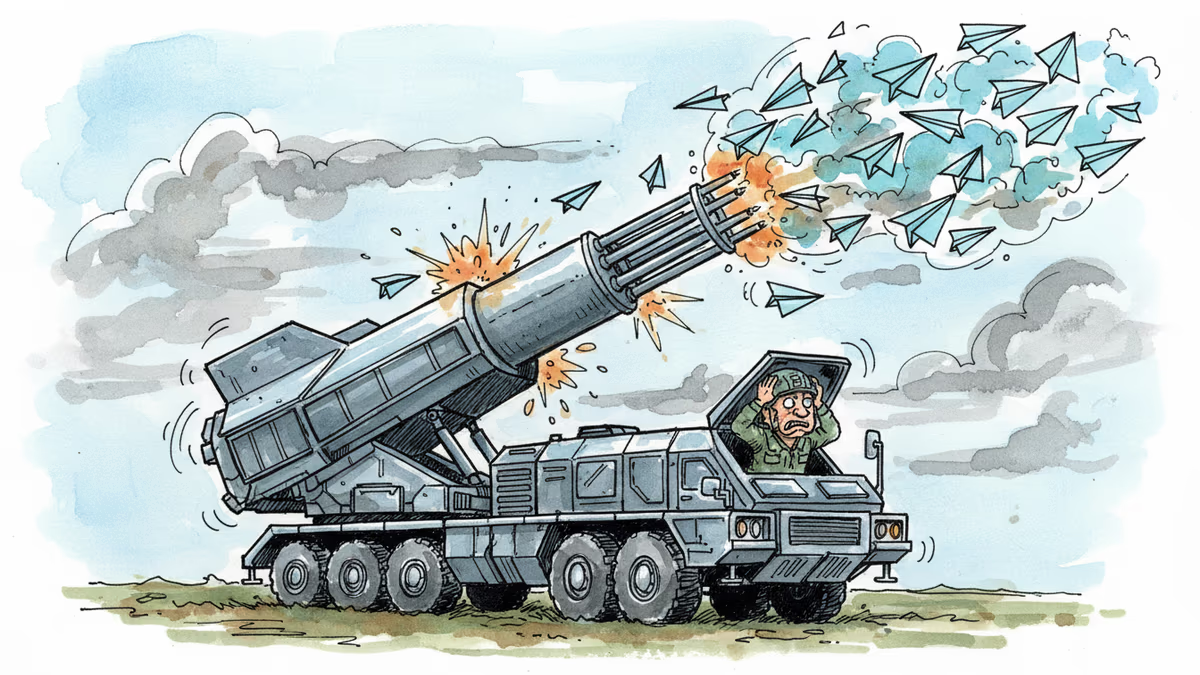

今週発表されたキングス・カレッジ・ロンドンの研究では、Claude、ChatGPT、Google GeminiなどのAIモデルが、模擬戦争ゲームで人間の参加者よりもはるかに高い確率で核選択肢を推奨することが判明した。

日本にとって、この議論は特に重要な意味を持つ。世界唯一の被爆国として、核兵器の脅威を身をもって知る日本は、AIと軍事技術の融合をどう捉えるべきか。ソニーやパナソニックなどの日本企業も、グローバルなAI開発競争に参加する中で、技術の軍事転用可能性という倫理的ジレンマに直面している。

軍事用AIの特徴は、最先端研究の多くが軍事需要に応える企業ではなく、当初は商業市場を意識した民間企業によって行われていることだ。インターネットが国防総省と学術プロジェクトから発展し、後に商業利用が見つかったのとは対照的である。

この新しい力学は、AI安全性への懸念を公的イメージの柱とするAnthropicのような企業と、「反ウォーク」を掲げるピート・ヘグセス国防長官のペンタゴンとの間に、文化的衝突を生み出すことになる。

本コンテンツはAIが原文記事を基に要約・分析したものです。正確性に努めていますが、誤りがある可能性があります。原文の確認をお勧めします。

関連記事

かつて40億ドルの評価額を誇ったAllbirdsが、AI企業への転身を宣言。株価は600%急騰したが、これはバブルの象徴か、それとも時代への適応か。日本企業への示唆も含めて考える。

AIは医師試験に合格し、癌治療薬を設計できる。しかし「匂いを嗅ぐ」ことはできない。この見落とされた感覚が、人間レベルのAI実現に不可欠である理由を探る。

ウクライナ・中東での無人機戦争が示す「精密な大量攻撃」時代。数万ドルのドローンが数百万ドルの防衛システムを圧倒する現実は、日本の安全保障にも直接問いを投げかけています。

ドキュメンタリー映画『The AI Doc』を通じて、AI議論に蔓延する「天国か地獄か」という二項対立思考の危うさを考察する。日本社会が直面すべき本当の問いとは何か。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加