Notion AI Agent 開発の秘訣:複雑なコードより「普通の言葉」が性能を上げる理由

Notion AIのV3開発秘話。複雑なコードを捨て、Markdownと人間のようなプロンプトを採用したことで性能が劇的に向上。Notion AI Agent 開発の核心に迫ります。

最高のAIを作るには、複雑なプログラミングが必要だと思っていませんか?Notion AIのエンジニアリングリード、ライアン・ナイストロム氏とそのチームは、最新のV3アップデートにおいて意外な決断を下しました。JSONやXMLといった複雑なデータ形式を捨て、あえて人間が読むような「普通のテキスト(Markdown)」に回帰したのです。その結果、モデルの性能は劇的に向上したといいます。

Notion AI Agent 開発における「引き算」の美学

ナイストロム氏によると、初期の実験では高度なコード生成や複雑なスキーマを適用していましたが、試行錯誤の末、それらは不要であるという結論に達しました。チームは「シンプルなプロンプト」「人間が読める表現」「最小限の抽象化」へと方針を転換。AIに人間へ説明するのと同じように指示を出すことで、LLM(大規模言語モデル)本来の理解力を引き出すことに成功しました。

パフォーマンスを最大化する数値の「スイートスポット」

技術的な最適化において、チームはコンテキスト(文脈)の量にも注目しました。情報を詰め込みすぎると処理が遅くなり、精度も低下するため、10万から15万トークンという制限がパフォーマンスと精度のバランスが取れた「スイートスポット」であることを突き止めました。また、AIが利用できるツールの数もあえて制限し、決定プロセスをシンプルに保つことで、ユーザー体験の向上につなげています。

関連記事

プレプリントサーバーarXivが、LLM生成コンテンツを無検証で掲載した研究者に1年間の投稿禁止処分を導入。科学的誠実性とAI活用の境界線はどこにあるのか。

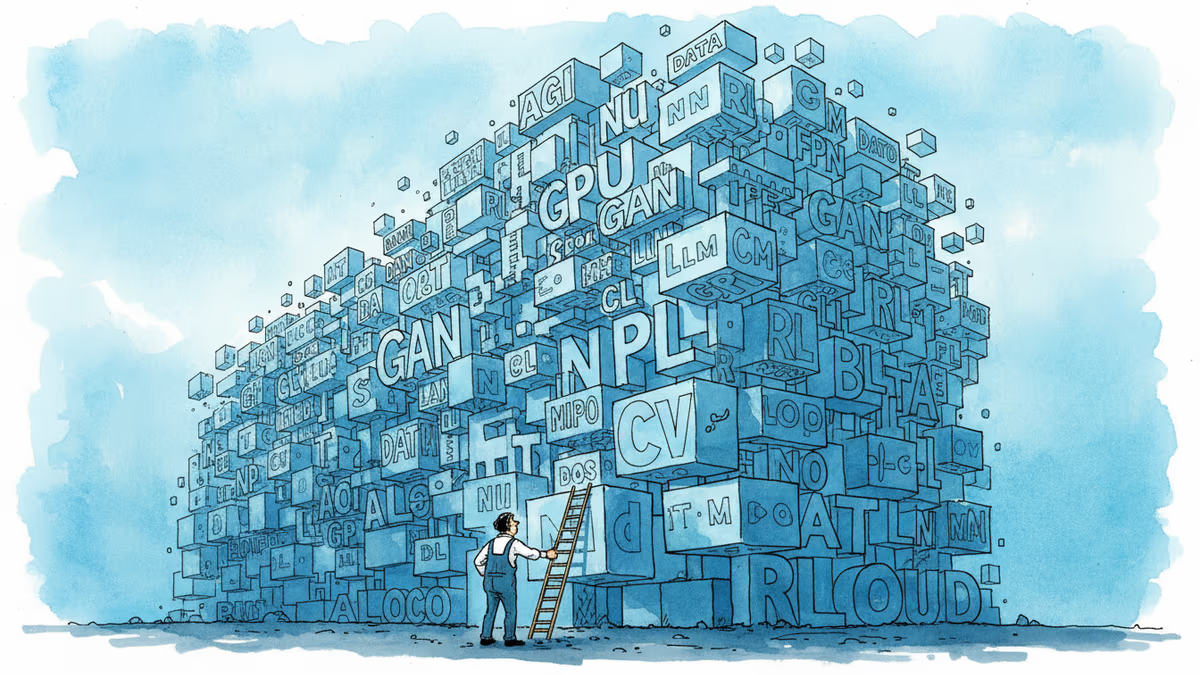

AGI、LLM、ハルシネーション——AI業界が使う専門用語を正しく理解することは、これからの時代を生き抜くための必須スキルかもしれません。日本社会への影響も含めて解説します。

米スタートアップArceeが26人・2000万ドルで400Bパラメータのオープンソース推論モデル「Trinity Large Thinking」を公開。中国製AIへの依存リスクを回避したい企業に新たな選択肢を提供する。

Wikipediaが編集者によるAI生成テキストの使用を禁止。40対2の圧倒的多数で可決されたこの決定は、AI時代における「信頼できる知識」の在り方に深い問いを投げかけています。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加