AIエージェントの信頼性2026:幻覚は「仕様」か「限界」か

2026年、AIエージェントは数学的な限界と幻覚の問題に直面しています。ヴィシャル・シッカ氏の指摘するLLMの限界と、Harmonicによる数学的検証の試みから、次世代AIの信頼性と自動化の未来を考察します。

AIエージェントの時代はまだ来ないのかもしれません。当初、業界は2025年を「AIエージェントの年」と呼びましたが、実際にはその実装を2026年以降へと先送りする議論が続きました。私たちの生活を完全に自動化してくれるはずの「自律型ロボット」の夢は、今、数学的な現実の壁に直面しています。

数学的限界が突きつけるAIエージェントの信頼性2026

SAPの元CTOであるヴィシャル・シッカ氏が発表した論文「Hallucination Stations」は、AI業界に衝撃を与えました。この論文では、TransformerベースのLLM(大規模言語モデル)には、一定の複雑さを超えるタスクを遂行できない数学的な限界があることが示されています。

それらが100%信頼できるようになる道はありません。原子力発電所の管理をAIエージェントに任せることは忘れるべきです。

OpenAIの研究者も、最新モデルにおいてさえ「幻覚(ハルシネーション)」が依然として解決困難な課題であることを認めています。実際に、研究者が自身の論文タイトルをChatGPTに尋ねたところ、架空のタイトルや誤った出版年を回答したという事例も報告されています。精度が100%に達することはないという絶望的な予測すら漂っています。

数学的検証による突破口と「有益な幻覚」

一方で、この現状を打破しようとする動きも活発です。スタートアップ企業のHarmonicは、「Aristotle」という製品を通じて、数学的な形式手法を用いてAIの出力を検証するアプローチを提案しています。Leanプログラミング言語を活用し、AIが生成したコードや理論が正しいかを厳密にチェックすることで、信頼性を担保しようとしています。

興味深いことに、同社の共同創設者であるチューダー・アキム氏は、幻覚を「バグではなく仕様」と捉えています。人間が思いつかないような斬新なアイデアは、ある種の「幻覚」から生まれるという考え方です。重要なのは幻覚をゼロにすることではなく、適切なガードレール(安全装置)を設けて、その出力を管理することにあると言えるでしょう。

関連記事

プレプリントサーバーarXivが、LLM生成コンテンツを無検証で掲載した研究者に1年間の投稿禁止処分を導入。科学的誠実性とAI活用の境界線はどこにあるのか。

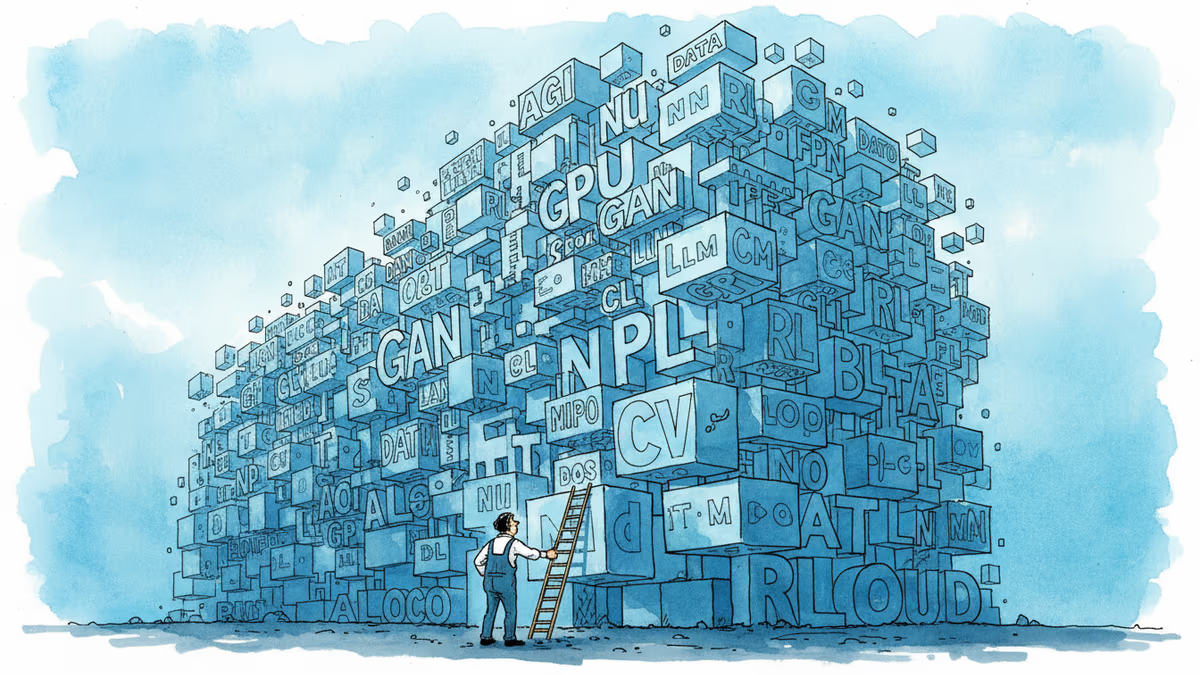

AGI、LLM、ハルシネーション——AI業界が使う専門用語を正しく理解することは、これからの時代を生き抜くための必須スキルかもしれません。日本社会への影響も含めて解説します。

米スタートアップArceeが26人・2000万ドルで400Bパラメータのオープンソース推論モデル「Trinity Large Thinking」を公開。中国製AIへの依存リスクを回避したい企業に新たな選択肢を提供する。

Wikipediaが編集者によるAI生成テキストの使用を禁止。40対2の圧倒的多数で可決されたこの決定は、AI時代における「信頼できる知識」の在り方に深い問いを投げかけています。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加