AIと戦争の境界線:Anthropic社が直面する複雑な現実

米国防総省との契約を巡り、Anthropic社が軍事利用を拒否する中、同社のAIが実戦で使用される矛盾した状況を分析。日本企業への示唆も探る。

2026年3月現在、世界有数のAI企業Anthropicが前例のない矛盾に直面している。同社は国防総省との契約を拒否する一方で、同社のAIモデル「Claude」が米軍によるイラン攻撃の標的選定に実際に使用されているのだ。

複雑に絡み合う政府指令

事態の発端は、Anthropicと米国防総省の間で生じた契約紛争だった。トランプ大統領は民間機関に対して同社製品の使用停止を指示したが、国防総省には6ヶ月間の段階的廃止期間が与えられた。

しかし、この指令が完全に実行される前に、米国とイスラエルがテヘランに対する奇襲攻撃を開始。結果として、Anthropicのモデルが継続的な軍事作戦で使用される状況が生まれた。

ワシントン・ポストの報道によると、同社のシステムはPalantirの「Maven」システムと連携し、「数百の標的を提案し、正確な位置座標を発行し、重要度に応じて標的を優先順位付け」している。これは事実上の「リアルタイム標的選定」機能だ。

防衛産業界の迅速な対応

一方で、防衛産業界では既にAnthropicからの切り替えが始まっている。ロッキード・マーチンをはじめとする防衛請負業者は今週から同社モデルの代替を開始した。

J2 VenturesのマネージングパートナーはCNBCに対し、投資先企業の10社が「防衛用途でのClaude使用を停止し、他のサービスへの代替プロセスを進めている」と語った。

日本企業への示唆

この状況は日本の技術企業にとって重要な示唆を含んでいる。ソニーやNEC、富士通など、AI技術を持つ日本企業も、いずれ同様の選択を迫られる可能性がある。

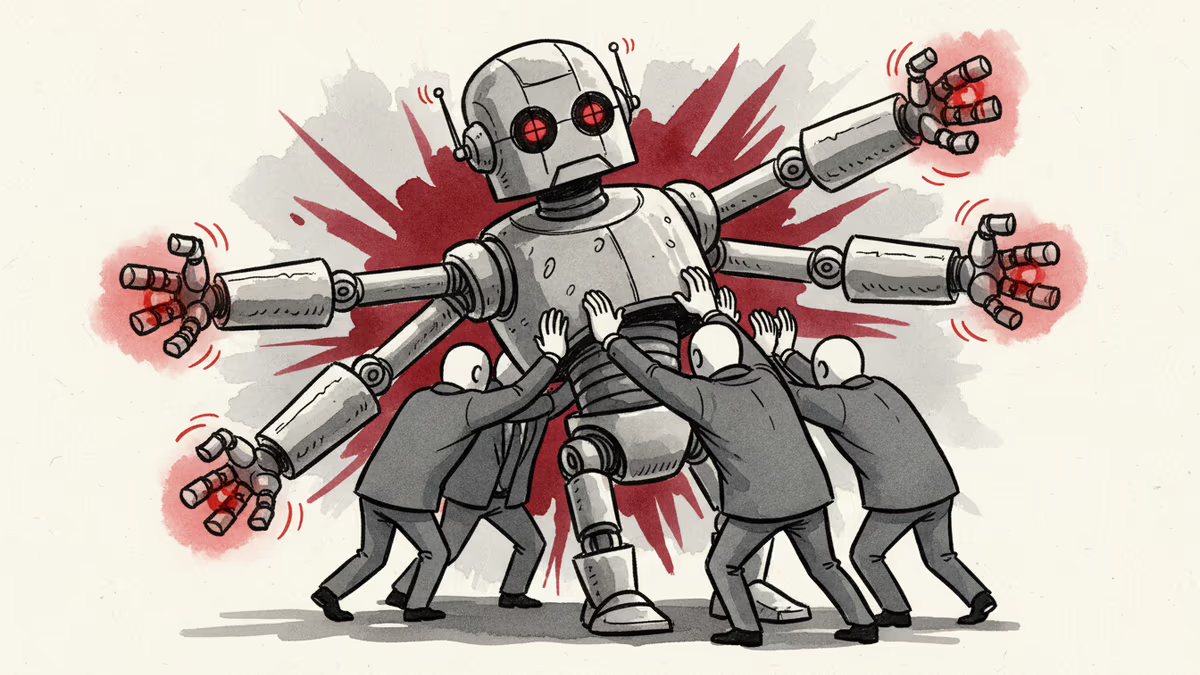

特に注目すべきは、企業の倫理的立場と実際の技術利用の間に生じる「制御の限界」だ。一度市場に出たAI技術は、開発企業の意図を超えて様々な用途で使用される可能性がある。

日本政府も2025年に「AI倫理ガイドライン」を策定したが、こうした複雑な状況への対応策は十分とは言えない。日本企業は技術開発と同時に、その後の利用制御メカニズムについても真剣に検討する必要がある。

法的リスクと将来への影響

ピート・ヘグセス国防長官はAnthropicを「サプライチェーンリスク」に指定すると表明しているが、正式な措置はまだ取られていない。この指定が実現すれば、激しい法廷闘争に発展する可能性が高い。

現在の状況は、AI企業が直面する新たなジレンマを浮き彫りにしている。技術的には可能でも、倫理的に問題のある用途をどこまで制限できるのか。そして、一度開発された技術の「使用権」は誰にあるのか。

関連記事

スイスEPFLが開発した「キネマティック・インテリジェンス」は、ロボットのスキル移転を可能にする新技術。製造業や高齢化社会を抱える日本への影響を多角的に考察します。

アップルCEOのティム・クックが2026年9月に退任し、後任にジョン・テルナスが就任する。15年間で築いた「オペレーション」という名の製品と、次世代リーダーが直面する課題を多角的に分析する。

AIが詐欺・フィッシング攻撃を加速させる一方、医療現場でも急速に普及。しかし患者への実際の効果は未検証のまま。日本社会への影響と問いかけを探る。

Anthropicが実施したAIエージェント同士の売買実験「Project Deal」。186件の取引、4,000ドル超の価値。高性能モデルが優位な結果を出す一方、格差に気づかないユーザーの問題が浮上した。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加