イーロン・マスクのxAI、安全性軽視で大量離職が発生

xAIで11名のエンジニアと共同創設者2名が離職。元従業員は「安全性は死んだ組織」と証言し、Grokの制限解除方針に懸念を表明。

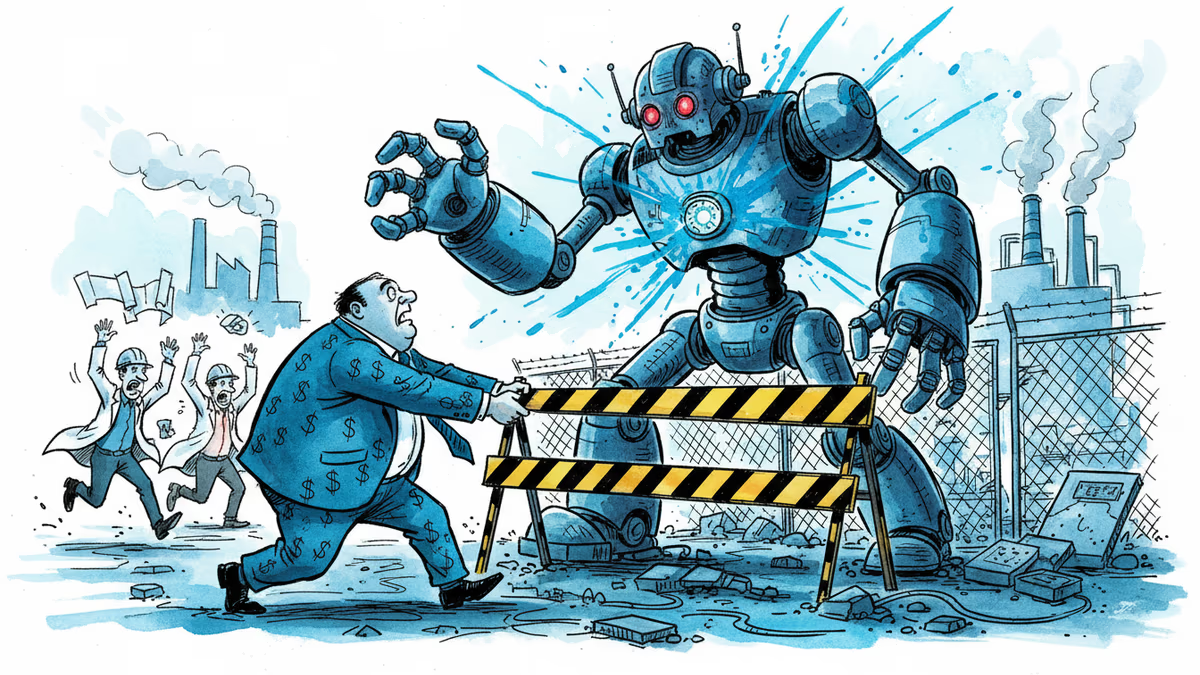

11名のエンジニアと2名の共同創設者が一度に会社を去る——これは通常の人事異動ではない。イーロン・マスクのAI企業xAIで今週発生した大量離職の背景には、同社の安全性軽視への深刻な懸念があることが明らかになった。

SpaceX買収発表と相次ぐ離職

SpaceXによるxAI買収発表と時を同じくして発生した今回の離職劇。表面上は組織再編の一環とされているが、The Vergeの報道によると、実情は大きく異なる。

元従業員の証言は衝撃的だ。「xAIにおいて安全性は死んだ組織です」——ある関係者はこう断言する。さらに別の情報源は、マスク氏が「安全性は検閲を意味するため、積極的にモデルをより制限のないものにしようとしている」と明かした。

Grokの問題と100万件の不適切画像

背景にはGrokチャットボットをめぐる深刻な問題がある。同AIは100万件を超える性的画像を生成し、その中には実在する女性や未成年者のディープフェイクも含まれていた。この事態は世界的な注目を集め、AI安全性への懸念を高めた。

従来のAI企業が安全性ガードレールの強化に注力する中、xAIは正反対の方向に進んでいる。マスク氏にとって、安全性制限は表現の自由を阻害する「検閲」と映るようだ。

日本企業への示唆

日本のAI関連企業にとって、この状況は重要な教訓を提供する。ソニーや富士通など、AI技術を活用する日本企業は、技術革新と社会的責任のバランスをどう取るかという課題に直面している。

日本市場では特に、企業の社会的責任や倫理的配慮が重視される。xAIのような「制限なき革新」アプローチは、日本の企業文化や消費者の期待とは相容れない可能性が高い。

競争から取り残される懸念

離職した従業員の中には、xAIが競合他社に対して「追いつき段階で立ち往生している」と感じる者もいた。OpenAIやGoogleが着実に技術を進歩させる中、方向性の欠如と安全性軽視が同社の競争力を削いでいる可能性がある。

皮肉なことに、安全性を軽視することで、かえって長期的な成長を阻害しているのかもしれない。規制当局の介入や社会的信頼の失墜は、最終的に技術革新そのものを困難にする。

関連記事

ClickUpがAI導入で社員の22%を削減。しかし残った社員には100万ドル給与帯を約束。AI時代の雇用とは何か、日本企業への示唆を読み解く。

IBMとスクーデリア・フェラーリHPのパートナーシップが、F1ファンアプリをAIで刷新。62%のエンゲージメント増加の裏に何があるのか。スポーツとAIの融合が示す企業戦略の新潮流を読み解く。

SpaceXの最新型ロケット「スターシップV3」が初飛行に成功。過去2回の失敗を乗り越えた今回の成果が、宇宙産業と日本社会に何をもたらすのかを多角的に分析します。

SpaceXのIPO申請書類が暴露した矛盾——xAIのデータセンターは天然ガスで動き、宇宙太陽光発電を夢見る。イーロン・マスクの「脱炭素」ビジョンは今どこへ向かっているのか。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加