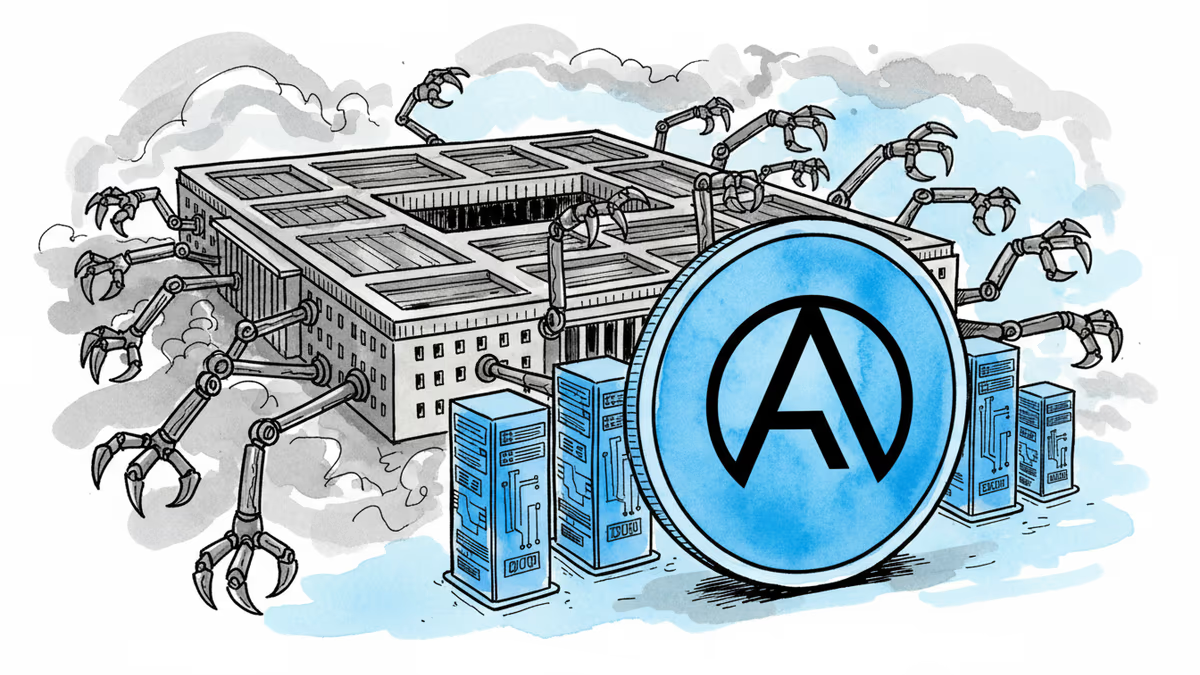

AI軍事利用の「赤い線」を巡る攻防:Anthropic契約破談が示すもの

米国防総省とAnthropic社の契約交渉が決裂。AI軍事利用の倫理的境界線を巡る議論が、技術と道徳のバランスについて重要な問いを投げかける。

13.4兆円。これは米軍が2026年度だけで自律兵器システムに投じる予算額だ。しかし、最も先進的なAIモデルを持つ企業の一つが、この巨額投資から手を引いた。

決裂の瞬間

金曜日の午後まで、Anthropic社の幹部たちは契約成立を確信していた。同社のAIモデル「Claude」は現在、米政府の機密システムに接続を許可された唯一のAIだった。ところが、最後の交渉で決定的な対立が生まれた。

国防総省はAnthropicのAIを使って、アメリカ国民から収集した大量データの分析を行いたがった。それには検索履歴、GPS位置情報、クレジットカード取引記録、さらにはチャットボットへの質問内容まで含まれる可能性があった。

Anthropicの経営陣にとって、これは「越えてはならない一線」だった。交渉は決裂し、Pete Hegseth国防長官は軍事関連企業に対して同社との取引停止を指示した。

自律兵器を巡る複雑な議論

興味深いことに、Anthropicは自律兵器そのものに反対していたわけではない。むしろ同社は、こうした兵器の信頼性向上に直接協力すると申し出ていた。自動運転車が人間のドライバーより安全になったように、キラードローンも将来的には人間のオペレーターより正確で、民間人の犠牲を減らせる可能性がある。

しかし現時点では、AIモデルがその水準に達していないとAnthropicは判断している。不正確な攻撃や民間人、さらには米軍兵士自身を危険にさらす可能性を懸念していた。

交渉過程で、AIを「クラウド」に留めて兵器本体には搭載しないという妥協案も検討された。しかしAnthropicはこの解決策にも納得しなかった。現代の軍事AI構造では、クラウドと前線システムの境界は曖昧になっている。戦場のドローンは今やクラウドデータセンターを含むメッシュネットワークで統制されており、倫理的な観点からすると「クラウドだから安全」という区別に意味はないと判断した。

OpenAIの「転向」が示すもの

Anthropicの経営陣は、他のAI企業も同様の姿勢を取ることを期待していた。実際、OpenAIのSam AltmanCEOも当初は自律兵器システムでのAI使用を拒否すると表明していた。

ところが、Anthropicの契約が決裂してわずか数時間後、OpenAIと国防総省の新たな契約が発表された。OpenAIの従業員約100人が大量監視と自律兵器に反対する公開書簡に署名していたにもかかわらず、である。

Altman氏は月曜日、オフィスで従業員たちと向き合い、なぜAnthropicが即座に却下した「クラウド条項」が彼にとって魅力的だったのかを説明しなければならないだろう。

日本企業への示唆

この出来事は日本の技術企業にも重要な示唆を与える。ソニー、トヨタ、日立といった企業は既に防衛関連技術の開発に関わっているが、AI時代の軍事協力には新たな倫理的判断が求められる。

特に、日本の「専守防衛」という安全保障政策の下で、自律兵器システムの開発や運用にどこまで関与するかは、技術的な問題を超えた社会的議論が必要だろう。

記者

関連記事

ローマ教皇レオ14世がAI時代の富の分配を訴える回勅「マニフィカ・ウマニタス」を発布。Anthropic共同創業者と並んで登壇するという前例のない場面が示す、テクノロジーと倫理の新たな交差点を読み解く。

バチカンが250ページの回勅でAIに初めて正面から向き合った。教皇レオ14世の主張は「人間の不完全さこそが美しい」という逆説だった。AIと人間性をめぐる哲学的論争を読む。

教皇レオ14世の回勅「マグニフィカ・フマニタス」は、産業革命期の労働者権利宣言「レルム・ノヴァルム」をAI時代に再解釈した。巨大テック企業が支配するAI産業に、協同組合モデルという対抗軸を示す。

ローマ教皇レオ14世が初の回勅でAIの倫理的規制を訴えた。労働の尊厳、民主的統制、軍事利用の制限——その教えは日本社会にどう響くか。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加