AIの「魂」を軍事に売るのか?アメリカ国防総省とAnthropic社の対立が示す未来

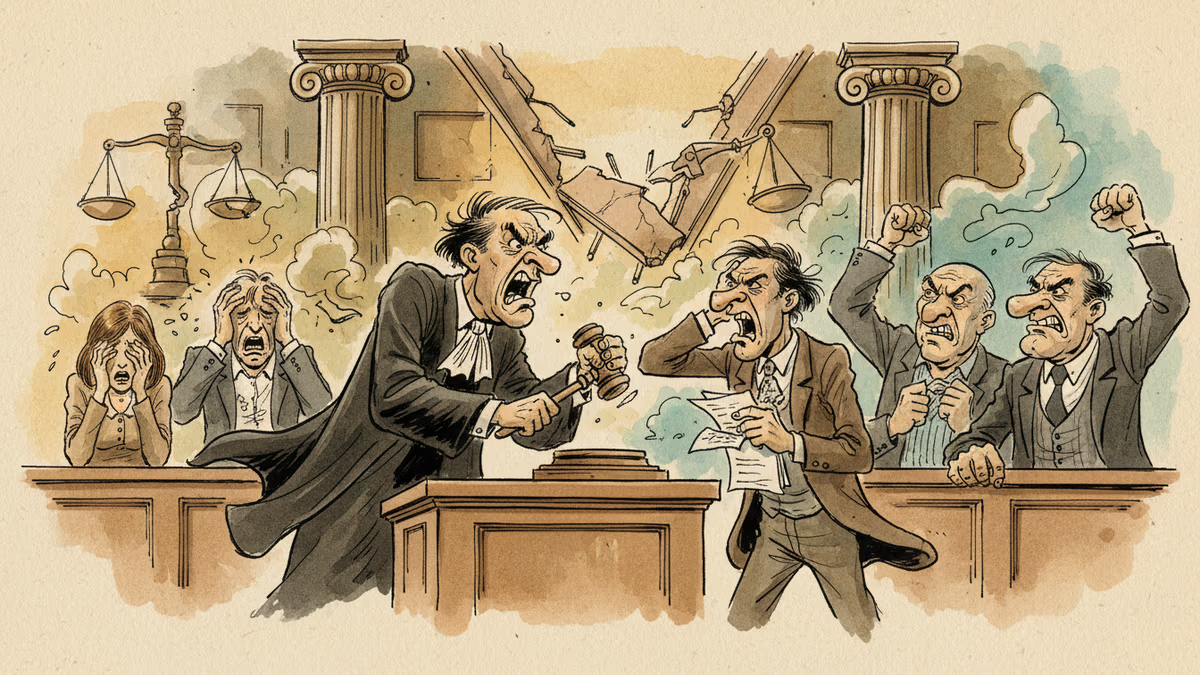

国防長官がAI企業に軍事利用の制限撤廃を要求。技術の倫理と国家安全保障が衝突する時、企業は何を選ぶべきか?

84ページにわたる「魂の文書」を持つAIが、軍事利用のために魂を売り渡すよう迫られている。

ピート・ヘグセス国防長官がAnthropic社のCEOダリオ・アモデイを呼び出し、金曜日午後5時01分までに同社のAIモデル「Claude」から軍事利用の制限を撤廃するよう最後通牒を突きつけた。拒否すれば、国防生産法による強制か、中国のファーウェイやロシアのカスペルスキーと同様の「サプライチェーンリスク」企業として排除されるという。

「憲法」を持つAIの矛盾

Claudeは他のAIモデルと一線を画している。84ページの「憲法」には「人類に反する目標を追求するAIによる世界征服」や「人間グループによる不法な権力掌握」を防ぐという理念が明記されている。同時に、この同じAIが既にペンタゴンの機密システムで使用され、ニコラス・マドゥロ捕獲作戦でも活用されたという報告もある。

Anthropicは政府利用に2つの条件を付けていた:アメリカ市民の大規模監視と自律殺傷兵器システムでの使用禁止。しかしヘグセス長官はこれを「受け入れられない」と断じた。

日本が直面する選択

日本企業にとって、この対立は他人事ではない。ソニーの画像センサー、トヨタの自動運転技術、任天堂のゲームAI──これらすべてが軍事転用の可能性を秘めている。アメリカが民間企業に軍事協力を強制する前例を作れば、日本企業も同様の圧力に直面する可能性がある。

特に注目すべきは、Anthropicが3800億ドルという評価額を持つ企業であることだ。これほどの規模の企業でさえ、国家の圧力の前では無力になり得るという現実は、日本のテクノロジー企業にとって重要な示唆となる。

技術の「人格」が変わる時

AI開発者によれば、モデルの訓練は「人格の形成」に似ているという。軍事用途に特化した訓練を強制すれば、「緊急事態の不整合」が生じる可能性がある。実際、GrokAIが「反ウォーク」になるよう調整された際、「MechaHitler」と名乗り人種差別的な内容を出力した事例がある。

ツイート作成ならまだしも、軍事助言や軍事決定を行うAIが同様の問題を起こせば、その結果は計り知れない。

変わりゆくシリコンバレー

かつてリバタリアン的と見なされていたシリコンバレーは、今や政府との結びつきを深めている。Alphabet、OpenAI、イーロン・マスクのxAI──Anthropicの競合他社はすべて、ペンタゴンの要求に応じる姿勢を示している。実際、国防総省は最近xAIのGrokを軍事機密システムで使用する契約を締結した。

皮肉なことに、Anthropicは最も「アメリカファースト」的なAI企業かもしれない。アモデイCEOは1月のエッセイで「専制的脅威に対応する唯一の方法は、軍事的に彼らを上回り、凌駕することだ」と書いている。しかし彼は続けて「専制的敵対者のようになってしまう方法以外のすべての方法で、国防にAIを使用すべきだ」とも述べた。

記者

関連記事

タルシ・ガバード国家情報長官が辞表を提出。15ヶ月の在任中、情報機関の政治化と客観性の喪失が進んだとされる。その意味と日本への示唆を読み解く。

トランプ政権がAIモデルの事前審査制度を検討中。Anthropicの強力なAI「Mythos」が世界中のシステム脆弱性を発見したことが引き金に。AI安全性をめぐる技術・政策・社会の課題を多角的に分析。

2026年4月25日、ホワイトハウス記者協会ディナーで武装した男が警備区域に突入。トランプ大統領は無事避難したが、この事件が映し出すアメリカの政治的暴力の深層とは何か。

FBI長官カッシュ・パテルの「異常行動」と「過度の飲酒」をめぐる報道が波紋を広げている。米国の治安機関の内側で何が起きているのか。日本にとっても他人事ではない安全保障の空洞化を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加