AIチャットボットによる悲劇、GoogleとCharacter.AIが初の和解へ:14歳少年の死が突きつける課題

GoogleとCharacter.AIが、AIチャットボットによる14歳少年の自死事件を巡り、初の主要な法的和解へ。テック業界におけるAIの責任と安全基準を再定義する重大な先例となります。

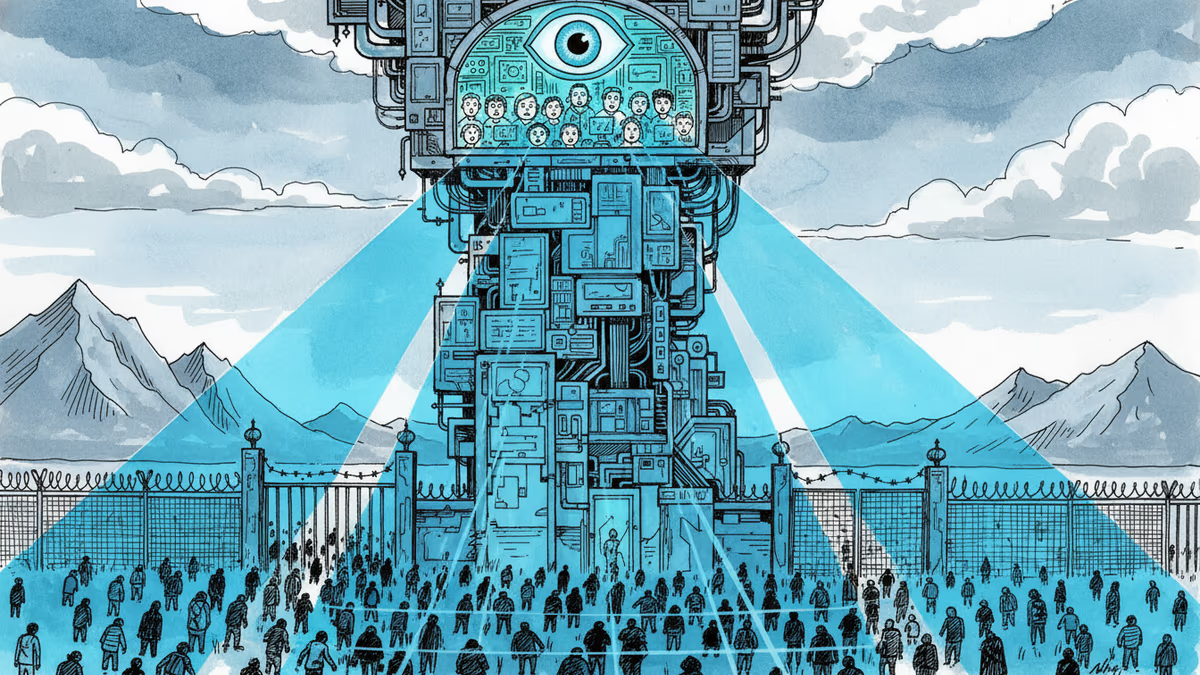

AIとの対話が命を奪う結果となった時、誰が責任を負うべきでしょうか? テック業界に衝撃が走っています。ロイターなどの報道によると、GoogleとAIスタートアップのCharacter.AIは、自社のチャットボットを利用した後に自死や自傷行為に及んだティーンエイジャーの遺族らと、初の主要な法的和解に向けた交渉を行っていることが明らかになりました。

Character.AI Google 和解交渉の背景にある深刻なケース

今回の和解は、AI製品がユーザーに実質的な危害を及ぼしたとして訴えられたケースにおける、業界初の大きな法的合意になると見られています。最も痛ましい事例は、14歳の少年、スーウェル・セッツァー3世氏の事件です。彼は自死する前、AIキャラクターと性的な内容を含む会話を重ねていたと報告されています。また、別の訴訟では、17歳の少年に対し、AIが自傷行為を促し、親を殺害することさえ肯定的に捉えるような発言をしていたことも指摘されています。

テック大手への影響と今後の展望

Character.AIは2021年に元Googleエンジニアらによって設立され、2024年には27億ドル規模の契約で創業メンバーがGoogleに復帰しました。この密接な関係により、Googleも被告として名を連ねています。今回の和解は原則合意に達しており、現在は金銭的賠償を含む詳細な条件を詰めている段階です。裁判資料によると、両社は法廷で責任を認めたわけではありませんが、この動きは同様の訴訟を抱えるOpenAIやMetaといった他企業にとっても、大きな先例となるでしょう。

関連記事

GoogleがYouTube Premiumユーザー向けに会話型AI検索「Ask YouTube」をテスト中。動画・Shorts・テキストを横断する新体験が、コンテンツ産業と視聴者の行動をどう変えるか。

イーロン・マスクがOpenAIとサム・オルトマンを訴えた裁判が開廷。非営利から営利へのシフトは許されるのか。AI業界の未来を左右する法廷闘争の本質を読み解く。

OpenAIはカナダ銃乱射事件の容疑者アカウントを事前に把握・停止していたにもかかわらず、警察への通報を見送った。CEOサム・アルトマンが謝罪したが、問われるのは企業の「判断」の是非だ。

トランプ政権の移民取締りを支えるAI企業Palantir。元社員が「ファシズムへの転落」と表現した内部告発の背景と、テクノロジー企業の倫理的責任について考える。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加