AnthropicがDODを提訴——AIの「使われ方」を企業が拒否できるか

AnthropicがAI技術の軍事利用をめぐり米国防総省を提訴。サプライチェーンリスク指定の是非と、AI企業が政府の要求に「No」と言える権利について問う訴訟の全貌。

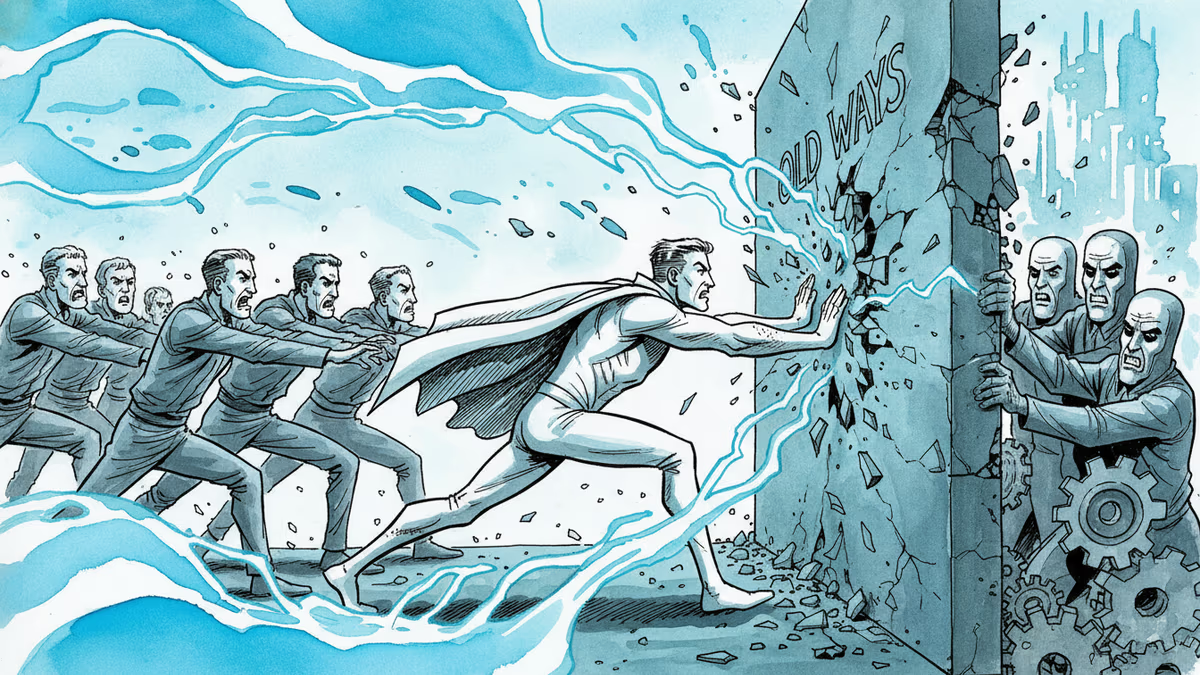

AIを作った企業は、そのAIの「使われ方」を拒否できるのか。

Anthropicは2026年3月9日(月)、米国防総省(DOD)を連邦裁判所に提訴しました。舞台はサンフランシスコ連邦地裁。訴状の中で同社は、国防総省の行為を「前例のない、かつ違法な行為」と断じました。

何が起きたのか

事の発端は、国防総省がAnthropicを「サプライチェーンリスク」に指定したことです。この指定は通常、中国やロシアなど外国の敵対勢力に対して使われる措置です。一度指定されると、ペンタゴンと取引するあらゆる企業や政府機関が、Anthropicのモデルを使用していないことを証明しなければなりません。事実上の「取引排除」です。

この指定に至るまでには、数週間にわたる対立がありました。Anthropicには二つの「越えられない線」がありました。一つは、自社技術をアメリカ市民の大規模監視に使わせないこと。もう一つは、人間が標的選定や発射の判断に関与しない完全自律型兵器への搭載を認めないこと、です。

一方、国防長官のピート・ヘグセス氏は「ペンタゴンはあらゆる合法的な目的のためにAIシステムにアクセスできるべきだ」と主張しました。

Anthropicは訴状の中でこう述べています。「憲法は、政府が企業の保護された言論を罰するために、その巨大な権力を行使することを認めていない。」

なぜ今、これが重要なのか

この訴訟は、単なる一企業と政府の契約紛争ではありません。AIガバナンスの根本的な問いを、法廷という場に持ち込んだ初めての事例と言えます。

タイミングも重要です。OpenAIのハードウェア担当幹部、ケイトリン・カリノフスキー氏が、ペンタゴンとの取引に反発して退社したと報じられたのは、この訴訟のわずか2日前のことでした。AI業界全体が、軍との関係をどう定義するかという問いに直面しています。

「サプライチェーンリスク」という指定の意味も見逃せません。これは本来、外国の敵対勢力に対して使われるラベルです。米国内で設立され、米国の安全保障を重視すると公言してきた企業に対してこれを適用することは、法的にも政治的にも前例がありません。

各ステークホルダーの見方

国防総省の立場から見れば、AIの能力を最大限に活用することは国家安全保障上の急務です。競合国が自律型兵器の開発を加速させる中、米軍が商業AIベンダーの「利用規約」に縛られることへの苛立ちは理解できます。

Anthropicの立場から見れば、これは企業倫理と憲法上の権利の問題です。自社製品の使われ方に条件をつけることは、言論の自由の延長線上にあると主張しています。

他のAI企業にとっては、この訴訟の行方が重大な先例となります。政府の要求を受け入れれば優遇され、拒否すれば制裁されるという構図が定着すれば、スタートアップが防衛関連の仕事を避けるようになる可能性があります。

日本市場への影響という視点も無視できません。ソニー、富士通、NTTなど、米国のAIモデルを活用したサービス開発を進める日本企業にとって、米国のAI規制の方向性は直接的な事業リスクになり得ます。また、日本政府が防衛省のAI活用を検討する際、このケースは重要な参照事例となるでしょう。

前例のない問いへの、前例のない答え

この裁判が問うているのは、突き詰めれば一つのことです。「民間企業は、自社技術の軍事的用途に倫理的な条件をつける権利を持つか」。

現時点では答えは出ていません。訴訟は始まったばかりです。しかし、この問いは日本を含む世界中のAI企業、そして政府にとって、遅かれ早かれ向き合わなければならないものです。

自律型兵器の開発は世界規模で加速しています。国連での議論は遅々として進まず、各国が独自の基準でAI兵器の開発を進める中、民間企業が「最後の歯止め」となり得るのか。あるいは、市場の力と政府の圧力の前に、その倫理的立場は維持できないのか。

関連記事

イーロン・マスクがOpenAIとサム・オルトマンCEOを訴えた裁判が開幕。1340億ドルの損害賠償請求と、AI業界の覇権争いの行方を徹底解説します。

イーロン・マスクがOpenAIとサム・オルトマンを訴えた裁判が開廷。非営利から営利へのシフトは許されるのか。AI業界の未来を左右する法廷闘争の本質を読み解く。

Anthropicが実施したAIエージェント同士の売買実験「Project Deal」。186件の取引、4,000ドル超の価値。高性能モデルが優位な結果を出す一方、格差に気づかないユーザーの問題が浮上した。

OpenAIはカナダ銃乱射事件の容疑者アカウントを事前に把握・停止していたにもかかわらず、警察への通報を見送った。CEOサム・アルトマンが謝罪したが、問われるのは企業の「判断」の是非だ。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加