AIは機密情報を「学習」できるか――ペンタゴンの賭け

米国防総省が生成AIに機密データを学習させる計画を進めている。AnthropicやOpenAIなどのAI企業が軍事機密に触れる時代、セキュリティと技術革新のジレンマをPRISMが読み解く。

AIに「秘密」を教えたとき、その秘密はどこへ行くのか。

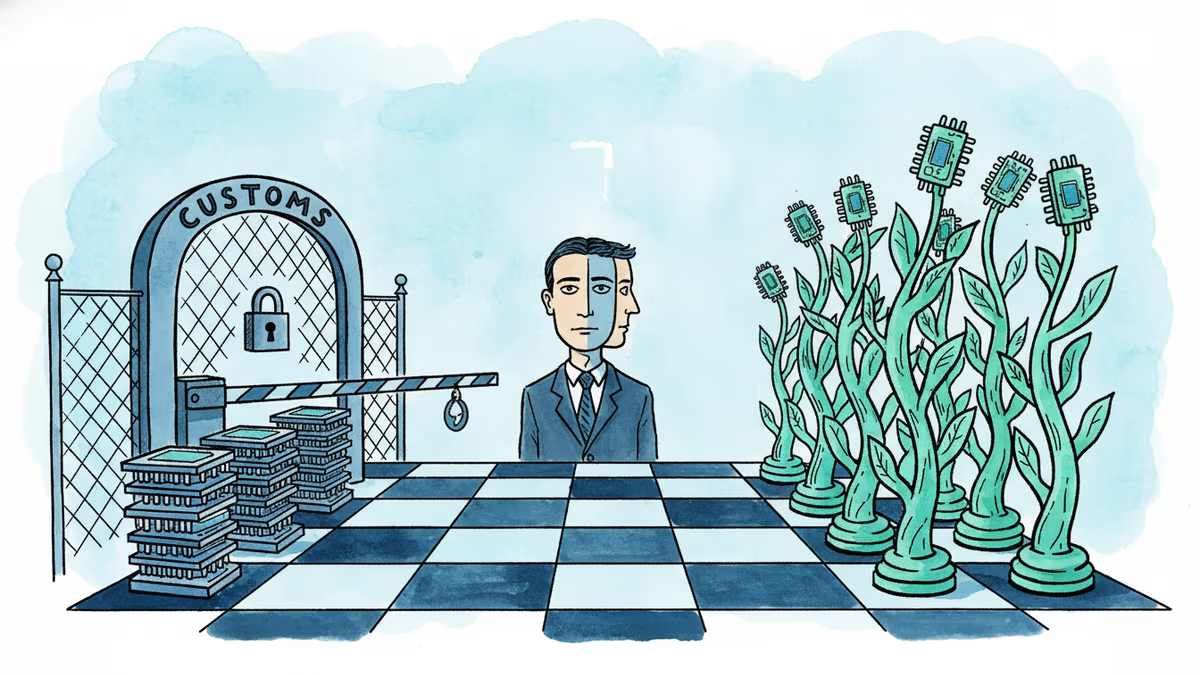

米国防総省(ペンタゴン)が、生成AI企業に対して軍事機密データを学習させる計画を進めていることが、MIT Technology Reviewの取材で明らかになりました。単にAIを機密環境で「使う」のではなく、機密情報そのものをモデルに「覚えさせる」という、これまでとは次元の異なる動きです。

何が起きているのか

ペンタゴンはすでに、AnthropicのClaudeなどの生成AIモデルを機密環境で活用しています。イランの攻撃目標を分析する用途での使用も確認されています。しかし今回計画されているのは、それをはるかに超えた取り組みです。

具体的には、AI企業が軍事専用バージョンのモデルを開発できるよう、機密データへのアクセスが可能なセキュアな学習環境を国防総省が整備するというものです。監視報告書や戦場評価といった高度に機密性の高い情報が、モデルのパラメータそのものに埋め込まれることになります。

これは単なる「AIツールの導入」ではありません。機密情報がモデルの「思考回路」の一部となる、構造的な変化です。

なぜ今、これが問題なのか

タイミングは偶然ではありません。DeepSeekの登場で中国のAI開発能力が世界に示され、米中の技術覇権争いが新たな局面を迎えた今、米軍は「AIの軍事的優位性」を急いで確立しようとしています。

同時に、別の動きも起きています。米政府高官の一部は「Anthropicは戦闘システムを任せられない」と主張し、同社を政府機関から排除しようとしているとも報じられています。一方でOpenAIはこの隙に商機を見出しているとされ、AI企業間の軍事契約をめぐる競争が水面下で激化しています。

つまりペンタゴンは、AI企業を「信頼できるパートナー」として機密の核心に引き込もうとしながら、同時にそのAI企業を「信頼できるか」という問いと向き合っているわけです。

日本にとっての意味

この動きは、日本にとっても対岸の火事ではありません。

日本は現在、防衛費の増強と技術的な防衛力強化を進めており、AIの軍事利用についても議論が始まっています。米国が民間AI企業と軍の連携モデルを確立した場合、日米同盟の文脈で日本も類似の枠組みへの参加を求められる可能性があります。

富士通、NEC、NTTといった日本の大手IT企業は、防衛省との取引実績を持っています。しかし機密データを民間AIモデルに学習させるという発想は、日本の法的・文化的な文脈では大きな摩擦を生むでしょう。情報管理の厳格さを重んじる日本の官僚文化と、「データで学習する」AIの性質は、根本的な緊張関係をはらんでいます。

さらに、労働力不足という日本固有の課題も絡んできます。自衛隊の人員確保が困難になる中、AIによる情報分析・意思決定支援への需要は高まる一方です。しかしそのAIに何を学ばせるか、誰が管理するかという問いは、技術論ではなく安全保障の根幹に触れます。

セキュリティのジレンマ

機密データで学習したAIモデルが抱えるリスクは、従来のデータ漏洩とは性質が異なります。

通常の機密情報漏洩は「ファイルが盗まれる」という形をとります。しかしモデルに埋め込まれた機密情報は、適切な質問を通じて「引き出される」可能性があります。モデルの重みパラメータを解析することで情報を復元する研究も進んでいます。セキュアな学習環境を構築しても、完成したモデルをどう管理するかという問題は残ります。

Anthropicが信頼できないとする見方がある一方で、では誰が信頼できるのかという問いに、現時点で明確な答えはありません。

関連記事

UAEがOPECを離脱し、年間610億ドル超の増収をAIインフラ投資に振り向ける。エネルギーと資本と地政学が交差する新たな構図を読み解く。

中国がNvidiaのゲーミングチップを禁輸リストに追加。ジェンスン・フアンCEOが訪中中のタイミングで下された決定が示す、米中半導体覇権争いの深層を読む。

GoogleがAI画像生成・編集アプリ「Pics」をGoogle Workspaceに導入。CanvaやClaude Designに挑むこの動きは、デザイン業界と日本の中小企業に何をもたらすのか。

イランが米テック大手に海底ケーブル使用料を課すと宣言。ホルムズ海峡という「デジタルの喉元」を巡る地政学的緊張が、インターネットインフラの脆弱性を改めて浮き彫りにしています。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加