AIは「あなたの名前」を無断で使う――その代償は誰が払うのか

GrammarlyのAI機能が著名ジャーナリストの名前を無断使用した問題を起点に、AIプラットフォームと創作者の経済的関係、日本社会への示唆を深掘りします。

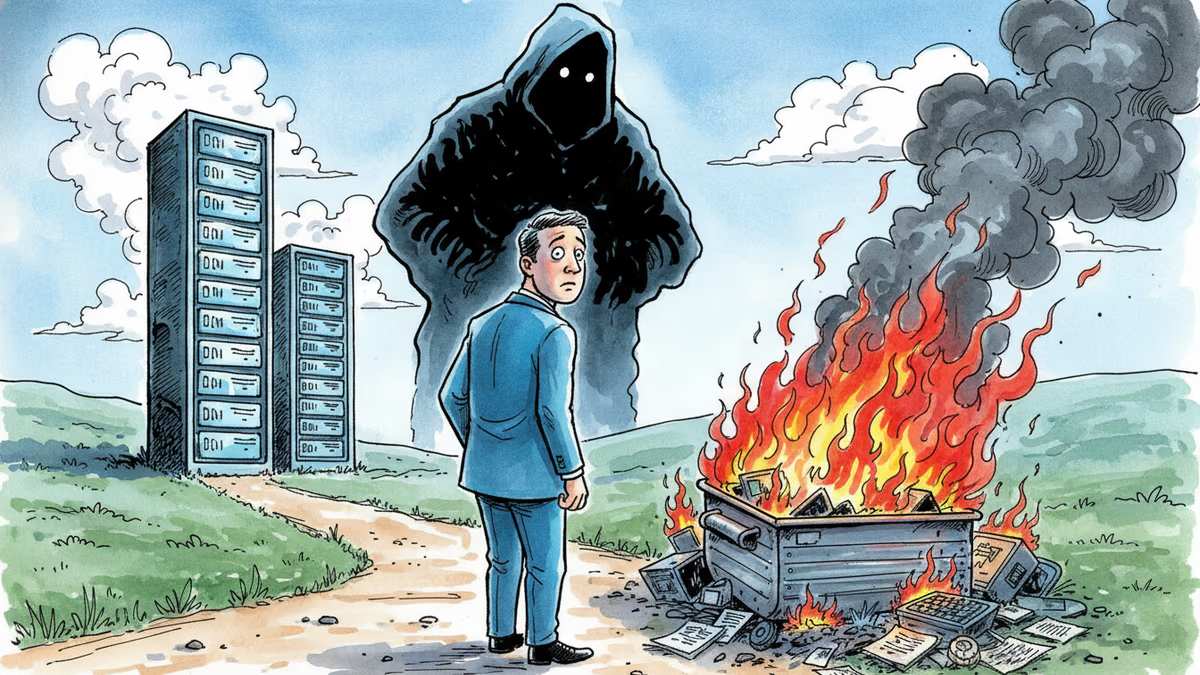

あなたが20年かけて書いてきた文章が、今日から誰かの「AIアシスタント」の教材になっているとしたら、あなたはどう感じますか?

何が起きたのか

Grammarly(現社名:Superhuman)は2024年8月、「Expert Review」という機能を静かにリリースしました。ユーザーが文章を書くと、著名な専門家や著名人の名前を冠した「編集アドバイス」が自動生成される仕組みです。著名ジャーナリストの Nilay Patel(The Verge編集長)、Casey Newton、調査報道記者の Julia Angwin ――そして文化批評家の bell hooks(すでに故人)の名前までもが、本人の許可なく使われていました。

誰もこの機能に気づかなかったわけではありません。ただ、あまりにも目立たない場所に埋め込まれていたため、発覚まで数ヶ月かかりました。発覚後、Angwin 氏はニューヨーク州・カリフォルニア州の「氏名・肖像の商業利用には本人の同意が必要」とする法律を根拠に、集団訴訟を提起しました。Superhuman 側は当初メールによるオプトアウトを提供し、その後機能を完全廃止。CEO Shishir Mehrotra 氏は謝罪しました。

しかし問題の本質は、一つの機能の廃止では終わりません。

なぜ今、この問題が重要なのか

Mehrotra 氏はポッドキャスト「Decoder」の中で率直に語りました。「機能として良くなかった。ユーザーにとっても専門家にとっても良くなかった」と認めつつも、法的な問題については「主張には根拠がない」と主張しています。そして繰り返し強調したのは、「私たちはYouTubeのようなプラットフォームを作りたい。クリエイターが自ら選んで参加し、収益を得られる場所を」という構想です。

ここに、現代AIビジネスの核心的な矛盾があります。

YouTubeは Content ID という仕組みで著作権者に収益を還元しました。しかしそれは、著作権法という強力な法的フレームワークがあったからこそ機能したシステムです。人の「名前」や「顔」や「編集スタイル」には、現行法上、同等の保護が存在しません。Mehrotra 氏自身も認めているように、「法律が要求する最低限のラインを守ることが目標ではない」と言いながら、実際にはそのラインがどこにあるかを探り続けている状況です。

重要な数字があります。Superhuman は日間アクティブユーザー4,000万人を抱えます。プラットフォームは毎日100万種類以上のアプリやエージェントと接続しています。このスケールで「名前の無断使用」が起きれば、影響は計り知れません。

日本社会にとっての意味

この問題は、日本社会に二つの層で刺さります。

一つ目は労働の問題です。Mehrotra 氏はAIが「人の仕事を奪うのではなく、人をスーパーヒューマンにする」と主張します。しかし番組の中でPatel氏が指摘したように、AIが世論調査で「ICE(米移民・関税執行局)より不人気」という結果が出るほど嫌われているのは、コピーライター、サポート担当者、トラック運転手といった人々が「自分の仕事が消えるかもしれない」と恐れているからです。日本は少子高齢化による労働力不足という別の文脈を抱えていますが、それは「AIに仕事を奪われる不安がない」ことを意味しません。むしろ、AIが導入されやすい環境だからこそ、誰がその恩恵を受け、誰がコストを負うのかという問いが鋭くなります。

二つ目は文化的な問題です。日本には「人の名前を使う」ことへの独特の感覚があります。芸名、ペンネーム、職人の屋号――名前には人格と信用が宿るという文化的直感は、欧米よりも強いかもしれません。Grammarly が故人の bell hooks の名前を使ったことへの違和感は、日本的感覚では一層大きく映るでしょう。

ソニー、任天堂、トヨタ といった日本企業も、今後AIプラットフォームとの連携を深めていく中で、「自社のブランドや社員の専門知識がどのように使われるか」を問われる場面が増えるはずです。

異なる視点から見ると

Mehrotra 氏の立場からすれば、「ユーザーが専門家の知見を手軽に得たい」というニーズは本物であり、それに応えようとした結果が今回の失敗でした。彼はYouTubeで著作権問題と向き合った経験を持ち、「法律の最低ラインではなく、その先を目指す」という姿勢は本物に見えます。

一方、クリエイター側から見れば、話は単純です。Patel氏の言葉を借りれば、「AIは私たちの過去の仕事をすべて無断で学習し、それを使って私たちを置き換えようとしている。誰も対価を払っていない」。これは個人の感情論ではなく、構造的な問題です。

さらに興味深いのは、Superhuman が提示する「解決策」です。「あなたの専門知識をプラットフォームに登録して、70/30の収益分配を受けてください」という提案は、一見公平に聞こえます。しかし、その前提には「すでに無断で使われた過去の仕事の価値はゼロ」という暗黙の了解が含まれています。Patel氏はこれを鋭く突きました。「あなたが言っているのは、私が今まで作ってきたものの価値がゼロになったから、新しいビジネスモデルを作れということですか?」

関連記事

2017〜2018年のメール記録が法廷で公開。マイクロソフト幹部たちはOpenAIへの追加支援に懐疑的だった。その判断が覆った経緯と、今日のAI産業への示唆を読み解く。

米スタートアップBasataは、専門医への紹介から予約確定までをAIで自動化。50万件の紹介状を処理し、医療行政の「見えない壁」に挑む。日本の高齢化社会にも示唆を与える動きだ。

MilkenカンファレンスでASML、Google Cloud、Perplexityなど5社のリーダーがAIの物理的制約を語った。チップ不足、エネルギー問題、新アーキテクチャの可能性を日本視点で読み解く。

イーロン・マスクとサム・オルトマンの裁判で証言したシボン・ジリス。彼女の立場が照らし出すのは、シリコンバレーの権力構造と個人的関係の曖昧な境界線だ。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加