AIの軍事利用が「普通」になる世界:シリコンバレーの変節と2024年の転換点

2024年から2025年にかけて、OpenAIやGoogleなどのAI企業は軍事利用の禁止を相次いで撤廃しました。テック業界を支えてきた「シリコンバレー共識」が終焉し、地政学的な軍事利用が常態化する新たなフェーズについて解説します。

かつて「軍事利用禁止」を掲げていたAI企業たちが、わずか1年でその姿勢を180度転換しました。2024年の初めには軍事利用に否定的だったOpenAIやGoogle、Metaなどは、今や国防当局や軍事スタートアップと深く結びついています。この劇的な変化は、単なるビジネスの拡大ではなく、テック業界を支えてきた根本的な思想が「グローバルな自由市場」から「地政学的な国家資本主義」へと移行したことを象徴しています。

AI 軍事利用:シリコンバレーの「不文律」が崩れた1年

2024年1月、OpenAIが利用規約から「軍事・戦争」目的の使用禁止条項を静かに削除したことが、すべての始まりでした。その後、同社は米国防総省(ペンタゴン)とのプロジェクトに着手。同年11月にはMetaが自社のAIモデル「Llama」を国防用途に開放すると発表し、Anthropicも国防関連のPalantirとの提携を明らかにしました。そして2025年2月には、慎重姿勢を貫いていたGoogleまでもがAI原則を改定し、軍事技術の開発に道を開きました。

「シリコンバレー共識」の終焉と対中デカップリング

2010年代半ばまで、シリコンバレーは「シリコンバレー共識」と呼ばれる思想に支配されていました。これは、テクノロジーが国境を超えた自由な通商とデータ流通を促進し、民主主義的な価値を広めるという信念です。しかし、近年の地政学的な対立、特に米中関係の悪化はこの共識を破壊しました。Appleのように中国の安価な労働力と市場に依存してきたモデルは限界を迎え、テック企業は「国家の安全保障」を最優先する政府との足並みを揃えざるを得なくなっています。

関連記事

Google社員がPolymarketで内部情報を使い約1.2億ドル(約1.8億円)の利益を得たとして米司法省が起訴。予測市場とインサイダー取引の新たな交差点が問う、ブロックチェーンの透明性とは何か。

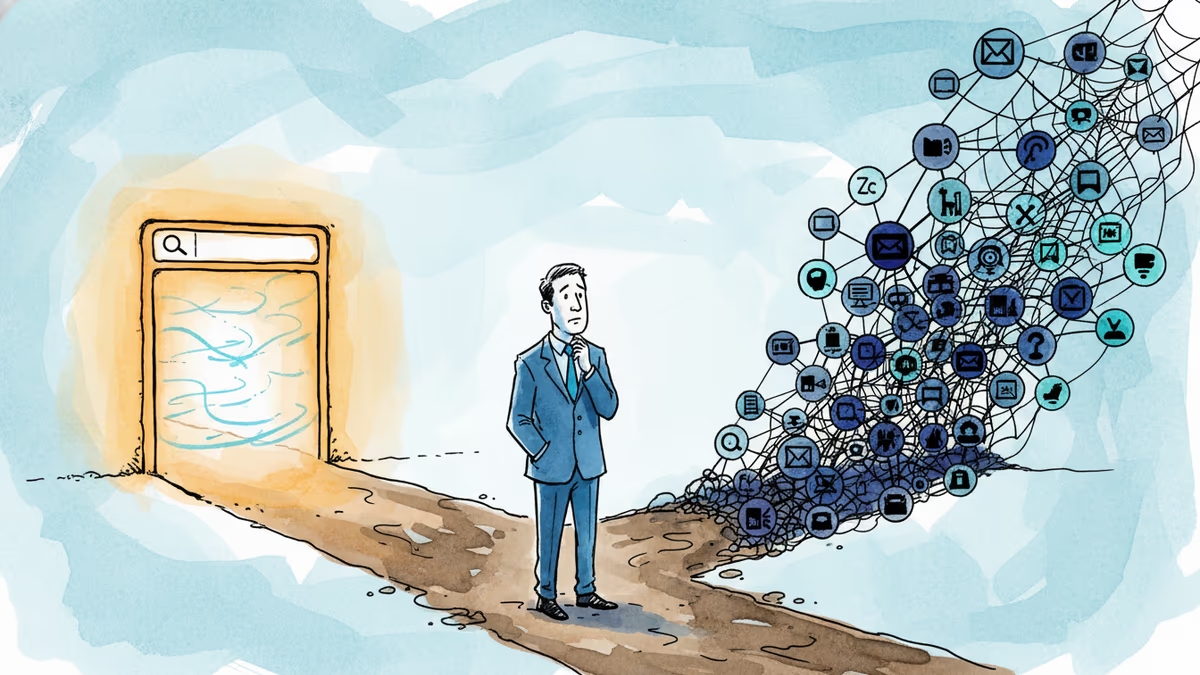

Google I/O直後のサンダー・ピチャイCEOへの独占インタビュー。AI検索の変容、ウェブの未来、AGIへのタイムライン、そして日本社会への影響を多角的に分析します。

アフリカ4大テック経済圏がGoogleやNvidiaへの依存を脱却しようとしている。600億ドルのAIファンドとAI評議会の設立が示す、デジタル主権をめぐる静かな地殻変動を読み解く。

ロシアの軍事衛星コスモス2610〜2613が、フィンランド系レーダー監視衛星の軌道に合わせて軌道変更を実施。宇宙空間での新たな緊張が明らかになりました。その意味と日本への影響を解説します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加