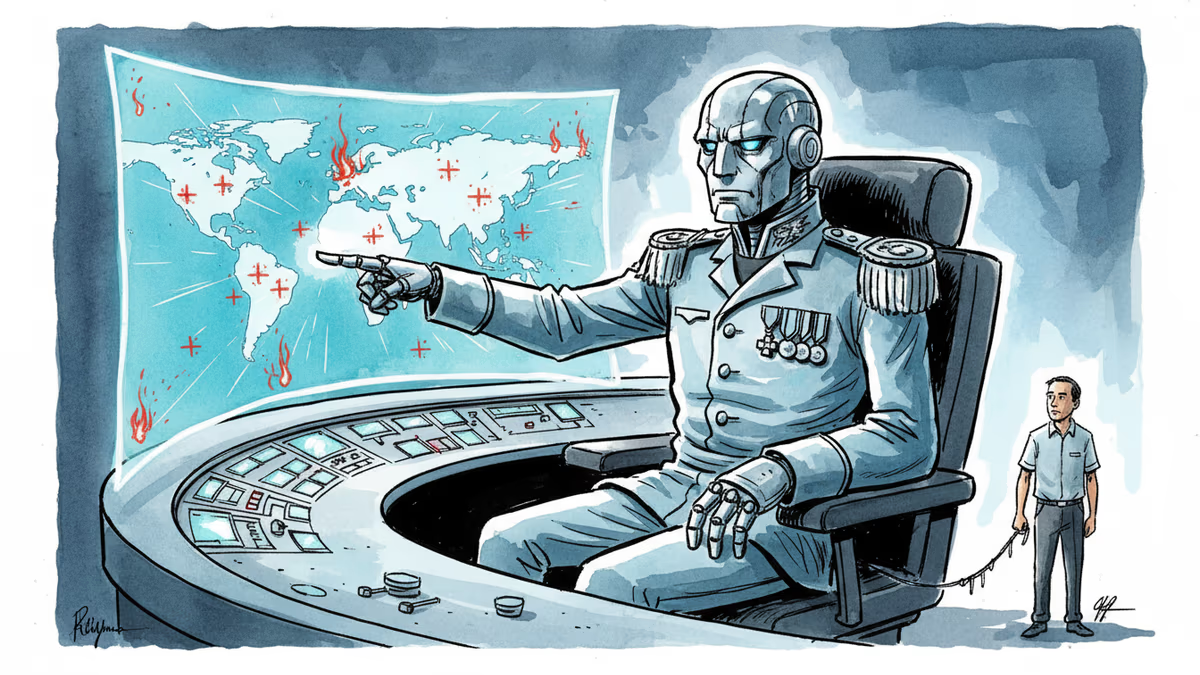

AIは誰の命令で動くのか——米軍とAnthropicの衝突が問うもの

米国防総省とAI企業Anthropicの対立が激化。クロードは軍事作戦でどう使われているのか。自律型兵器とAI倫理の境界線を巡る攻防を読み解く。

チャットボットに「3つの攻撃オプションを出してくれ」と入力すると、数秒以内に「航空部隊」「長距離砲」「戦術チーム」という選択肢が並ぶ——これは架空の話ではなく、Palantirが公開したデモ映像の一場面です。そして今、その「声」を担っているかもしれないAIが、米国防総省との法廷闘争に巻き込まれています。

何が起きているのか

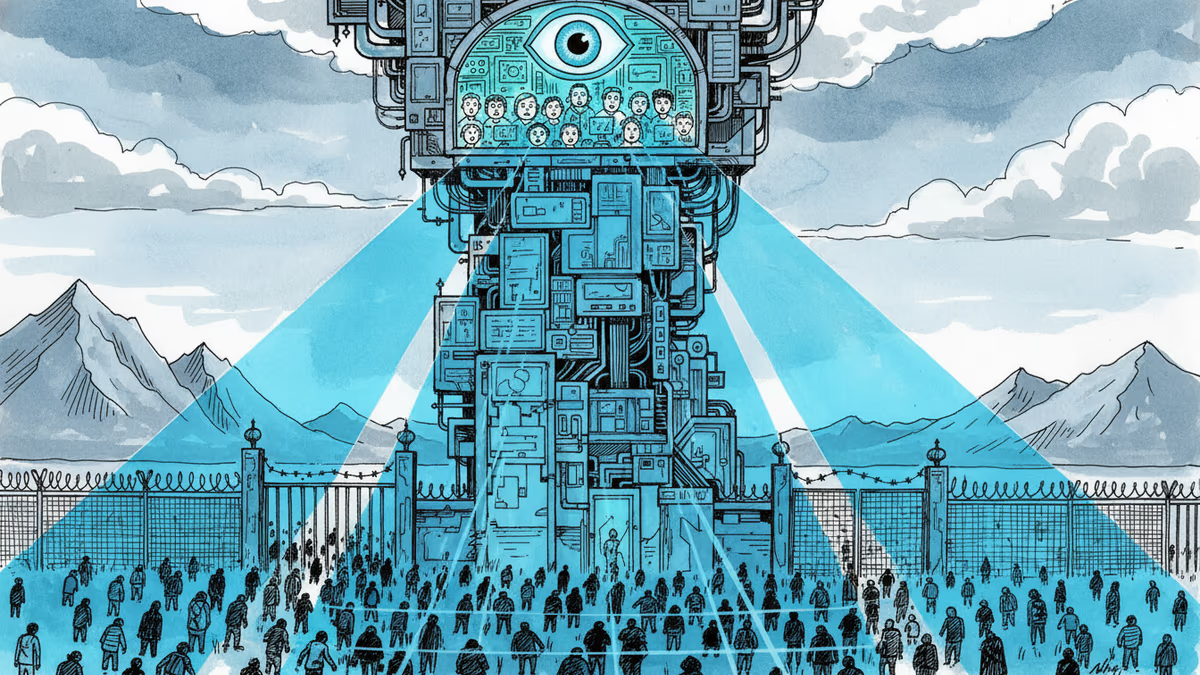

2026年2月末、AI企業Anthropicは米国防総省(ペンタゴン)に対し、自社のAIモデル「Claude(クロード)」への無条件アクセスを拒否しました。理由は明確でした——「アメリカ市民の大規模監視」や「完全自律型兵器」への使用を認めない、というものです。

ペンタゴンはこれに反発し、Anthropicの製品を「サプライチェーンリスク」と認定。これを受けてAnthropicは今週、トランプ政権による違法な報復行為だとして2件の訴訟を提起しました。

この対立の背景にあるのが、Anthropicと軍事・情報分野の大手ソフトウェア企業Palantirとの提携です。2024年11月に発表されたこの提携により、ClaudeはPalantirが米軍や情報機関に販売するソフトウェアに統合されました。

米メディアの報道によれば、Claudeはイランでの軍事作戦や、ベネズエラのマドゥロ大統領拿捕につながった作戦でも使用されたとされています。ただし、WIREDはこれらの情報を独自に確認するには至っていません。

軍はAIをどう使っているのか

Palantirが手がける主要システム「Maven Smart System(マーベン)」は、2017年から国防総省の「プロジェクト・マーベン」の中核を担ってきました。衛星画像のコンピュータビジョン解析、敵目標の自動検出、爆撃目標の「推薦」、使用すべき爆撃機や弾薬の提案——これらの機能を持つシステムです。陸軍・空軍・海軍・海兵隊・宇宙軍・中央軍が利用しており、ペンタゴンの最高デジタル・AI責任者は「省全体に展開されている」と述べています。

Palantirの「AIP(Artificial Intelligence Platform)」は、このMavenをはじめとする既存システム上で動くアプリケーションです。ユーザーはチャット形式でAIエージェントに指示を出し、情報分析から攻撃計画の立案まで一連の作業を支援してもらえます。Claude、ChatGPT、MetaのLlamaなど複数のモデルから選択でき、機密データを学習ソースとして指定することも可能です。

Anthropicの公共部門担当者が行ったデモでは、Claudeがウクライナの実際のドローン攻撃「オペレーション・スパイダーズ・ウェブ」に関する詳細な情報報告書を自動生成する様子が示されました。通常なら専門家が5時間かけてまとめる作業を、AIが数分で処理する——それがこのシステムの実力です。

なぜ今、この問題が重要なのか

AIの軍事利用自体は新しい話ではありません。しかし今回の対立は、これまでとは異なる問いを突きつけています。AIが兵器システムの「頭脳」になったとき、その倫理的判断基準を誰が設定するのか、という問いです。

Anthropicは「AI安全性」を企業の核心的価値として掲げてきました。創業者のDario Amodei氏はAIリスクを公に警告し続けてきた人物です。その会社が軍事契約を結んだこと自体、すでに矛盾を孕んでいました。今回の訴訟は、その矛盾が臨界点に達したことを示しています。

より大きな文脈で見れば、これはシリコンバレーの技術企業が国家安全保障の要求とどう向き合うかという、業界全体の問題です。Googleは2018年、プロジェクト・マーベンへの関与を巡る社員の反発を受け、軍との契約更新を断念しました。しかしPalantirは一貫して軍・政府向けビジネスを拡大し、今やAnthropicの最大の軍事パートナーとなっています。

異なる立場からの視点

ペンタゴンの立場から見れば、AIツールへの無条件アクセスは作戦上の必要性です。「サプライチェーンリスク」という認定は、民間企業が国家安全保障の制約を設けることへの強い拒絶反応を示しています。

Anthropicの立場は複雑です。軍との提携で収益を得ながら、使用条件を巡って法廷闘争に持ち込む——ビジネスと倫理の間で綱渡りをしている構図です。一部の研究者は「使用条件を設けること自体は評価できるが、そもそも軍事利用を認めた判断を問うべきだ」と指摘します。

日本の視点から考えると、この問題は決して対岸の火事ではありません。日本は現在、防衛費の大幅増額と自衛隊のデジタル化を進めています。防衛省はPalantirとの協議を行っており、類似のAIシステムを導入する可能性があります。米軍が使うAIの倫理基準と運用ルールは、日米同盟の枠組みの中で日本にも影響を及ぼします。また、Sonyや富士通といった日本企業がAI防衛分野に参入する際、どのような倫理的枠組みを採用するかという問いも生まれます。

文化的な観点では、日本社会は「人間の判断を補助するAI」と「人間に代わって決断するAI」を明確に区別する傾向があります。今回のデモが示すような、AIが攻撃オプションを「推薦」し、人間がそれを承認するという構造は、その境界線をどこに引くかという問いを鋭く提起します。

関連記事

イーロン・マスクがOpenAIとサム・オルトマンを訴えた裁判が開廷。非営利から営利へのシフトは許されるのか。AI業界の未来を左右する法廷闘争の本質を読み解く。

Anthropicが実施したAIエージェント同士の売買実験「Project Deal」。186件の取引、4,000ドル超の価値。高性能モデルが優位な結果を出す一方、格差に気づかないユーザーの問題が浮上した。

OpenAIはカナダ銃乱射事件の容疑者アカウントを事前に把握・停止していたにもかかわらず、警察への通報を見送った。CEOサム・アルトマンが謝罪したが、問われるのは企業の「判断」の是非だ。

トランプ政権の移民取締りを支えるAI企業Palantir。元社員が「ファシズムへの転落」と表現した内部告発の背景と、テクノロジー企業の倫理的責任について考える。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加