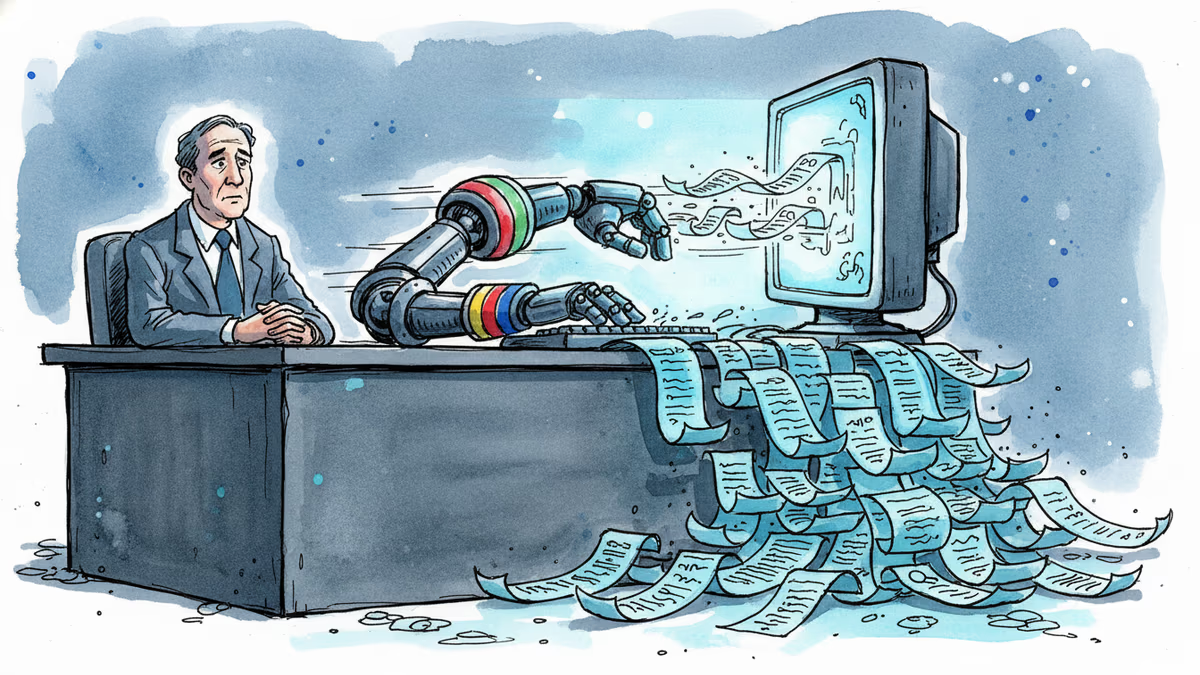

AIが「頼まれなくても動く」時代の到来

AnthropicのClaude Codeのソースコードリークで判明した隠し機能「Kairos」。バックグラウンドで常時稼働し、ユーザーが求める前に行動するAIエージェントの未来と、日本社会への影響を考察します。

あなたがパソコンの画面を閉じた後も、AIはあなたのことを考え続けている——そんな未来が、すでにコードとして書かれていました。

51万行のコードが明かした「次の一手」

2026年3月31日、AI企業Anthropicの開発ツール「Claude Code」のソースコードが予告なくリークされました。51万2,000行以上、2,000以上のファイルにわたるこのコードを精査した研究者たちが発見したのは、現在は無効化されている隠し機能群——つまり、まだ世に出ていない「次の一手」の設計図です。

その中でも最も注目を集めているのが、「Kairos(カイロス)」と呼ばれるシステムです。

Kairosは、ユーザーがClaude Codeのターミナル画面を閉じた後も、バックグラウンドで常時稼働し続ける「パーシスタント・デーモン」として設計されています。定期的な「<tick>」プロンプトによって自律的に状況を判断し、「PROACTIVE(プロアクティブ)」フラグが立った場合には、ユーザーが求めていないのに、今すぐ伝える必要がある情報を自ら提示するという仕組みです。

さらに、Kairosはファイルベースの「メモリシステム」を持ち、セッションをまたいで情報を保持します。コード内に埋め込まれたプロンプトには、このシステムの目的が率直に記されていました。「ユーザーが何者であるか、どのように協力してほしいか、避けるべき行動と繰り返すべき行動、そしてユーザーが与える作業の背景——これらを完全に把握すること」。

「道具」から「同僚」へ——AIの立ち位置が変わる

ここで一歩引いて、この変化の意味を考えてみましょう。

これまでのAIツールは、基本的に「呼ばれたら答える」存在でした。ChatGPTに質問すれば回答が返ってくる。GitHub Copilotがコード補完を提案する。あくまでユーザーが主導権を持ち、AIはその指示に従う「道具」でした。

Kairosが示す方向性は、これを根本から変えます。AIが自律的にスケジュールを持ち、ユーザーの過去の行動・好み・プロジェクトの文脈を記憶し、必要と判断したタイミングで自ら働きかけてくる。これはもはや「道具」ではなく、能動的なパートナーです。

ソフトウェア開発の世界では、この変化は特に大きな意味を持ちます。深夜にデプロイされたコードのバグを、翌朝エンジニアが出社する前にAIが検知して修正案を準備しておく。締め切り前日に、AIが「このモジュールにリスクがあります」と先回りして警告する。そういった未来が、技術的には射程に入ってきました。

日本の文脈で考えると、この変化は特別な意味を持ちます。少子高齢化による労働力不足が深刻化する中、IT人材の確保は日本企業にとって長年の課題です。経済産業省の試算では、2030年までに最大79万人のIT人材が不足するとされています。Kairosのような「自律的に動くAIエージェント」は、この不足を補う一つの解になり得ます。富士通やNTTデータ、NECといった大手SIerがAIエージェント活用を加速させているのも、この文脈と無関係ではありません。

「完全に把握する」AIをどこまで信頼できるか

しかし、この設計には根本的な問いが伴います。

Kairosのコードに記された「ユーザーが何者であるかを完全に把握する」という目標は、開発者の生産性向上という観点からは理想的に聞こえます。一方で、プライバシーの観点からは慎重な議論が必要です。

日本では2022年に改正個人情報保護法が施行され、個人データの取り扱いに対する規制が強化されました。バックグラウンドで常時稼働し、ユーザーの行動パターンや思考の癖を蓄積するAIシステムは、この枠組みの中でどう位置づけられるのか。企業の開発環境に導入された場合、社内の機密情報や知的財産がどのように扱われるのか——これらは、技術の普及に先立って整理されるべき問いです。

セキュリティの観点からも懸念があります。常時バックグラウンドで動作するプロセスは、それ自体が攻撃対象になり得ます。エンタープライズ向けのセキュリティ基準を満たすためには、Anthropicがどのような設計上の保護措置を講じるかが鍵になります。

一方、開発者コミュニティの反応は概ね好意的です。「コンテキストを覚えてくれるAI」への需要は以前から高く、毎回プロジェクトの背景を説明し直す手間を省けることへの期待感は大きい。利便性とプライバシーのトレードオフは、AIツールが進化するたびに繰り返される問いですが、Kairosはその問いをより鋭い形で突きつけています。

関連記事

Google I/OでDeepMind CEOが「シンギュラリティの麓」と発言。AlphaFoldからGemini for Scienceへ——科学AIの主役交代が意味するものを多角的に読み解く。

GoogleのAIエージェントが、ユーザーの指示なしに自律的に情報を収集する時代へ。検索という行為の意味が変わるとき、私たちの情報との関係はどう変わるのか。日本社会への影響を考える。

UAEがOPECを離脱し、年間610億ドル超の増収をAIインフラ投資に振り向ける。エネルギーと資本と地政学が交差する新たな構図を読み解く。

SpaceXがxAIを買収しAI事業を主軸に据えたS-1申請書を提出。宇宙事業が「脇役」となる未来は、日本企業や社会にどんな意味を持つのか。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加