AI企業と軍事利用の境界線—Anthropic事件が問う倫理と安全保障

Anthropic社がPalantir社との軍事AI利用に抗議した事件を通じて、AI技術の軍事転用問題と企業の倫理的責任について考察します。

1月3日、米軍特殊部隊がカラカスでニコラス・マドゥロ大統領を拘束した作戦で、Palantir社製の軍事システム「Maven Smart System」が使用された。このシステムにはAnthropic社のAI「Claude」が組み込まれており、データ分析と標的特定に活用されたとされる。

しかし2月、Anthropic社はPalantir社に対して強い抗議を表明した。自社のAI技術が軍事作戦に使用されることへの懸念を示し、両社の関係に亀裂が生じている。

AI技術の軍事転用という現実

Claudeは本来、研究支援や文書作成などの民間用途向けに開発された汎用AIである。しかし、その高度なデータ処理能力は軍事分野でも威力を発揮する。今回の事件は、民間AI技術が軍事システムに組み込まれる現実を浮き彫りにした。

Palantir社は以前からCIAや国防総省との契約で知られる企業だ。同社の「Maven Smart System」は、ドローンや監視システムから得られる膨大なデータを分析し、軍事作戦を支援する。AnthropicのAI技術がこのシステムに統合されることで、より精密で効率的な軍事行動が可能になったとみられる。

企業の倫理的ジレンマ

Anthropic社の抗議は、AI企業が直面する根本的なジレンマを表している。同社は「AI安全性」を重視する企業として知られ、AGI(汎用人工知能)の安全な開発を掲げてきた。しかし、一度リリースされたAI技術の用途を完全にコントロールすることは困難だ。

日本のAI企業にとっても、この問題は他人事ではない。ソニーや富士通などの技術が、意図しない軍事用途に転用される可能性は常に存在する。特に、日本政府が防衛装備移転三原則を見直す中、日本企業のAI技術が国際的な軍事システムに組み込まれるケースも増える可能性がある。

国家安全保障と企業倫理の対立

一方で、Anthropic社の抗議は「米国の国家安全保障を危険にさらす」との批判も受けている。軍事技術の優位性は国家の安全保障に直結するため、AI企業の倫理的配慮が国防上の制約となることへの懸念もある。

中国や他の競合国がAI技術の軍事利用を積極的に進める中、米国のAI企業が軍事協力を拒否することは、技術的優位性の喪失につながる可能性もある。この構図は、日本の防衛産業でも同様の議論を呼んでいる。

透明性と責任の所在

今回の事件で注目すべきは、Anthropic社が事後的に軍事利用を知った点だ。AI技術の提供先やその用途について、企業はどこまで関与し、監督すべきなのか。また、軍事システムにAIが組み込まれる際の透明性や説明責任はどう確保されるべきか。

日本では、AI戦略会議や内閣府のAI原則検討会議などで、AI技術の適切な利用について議論が続いている。しかし、軍事転用への対応については、まだ明確な指針が示されていないのが現状だ。

記者

関連記事

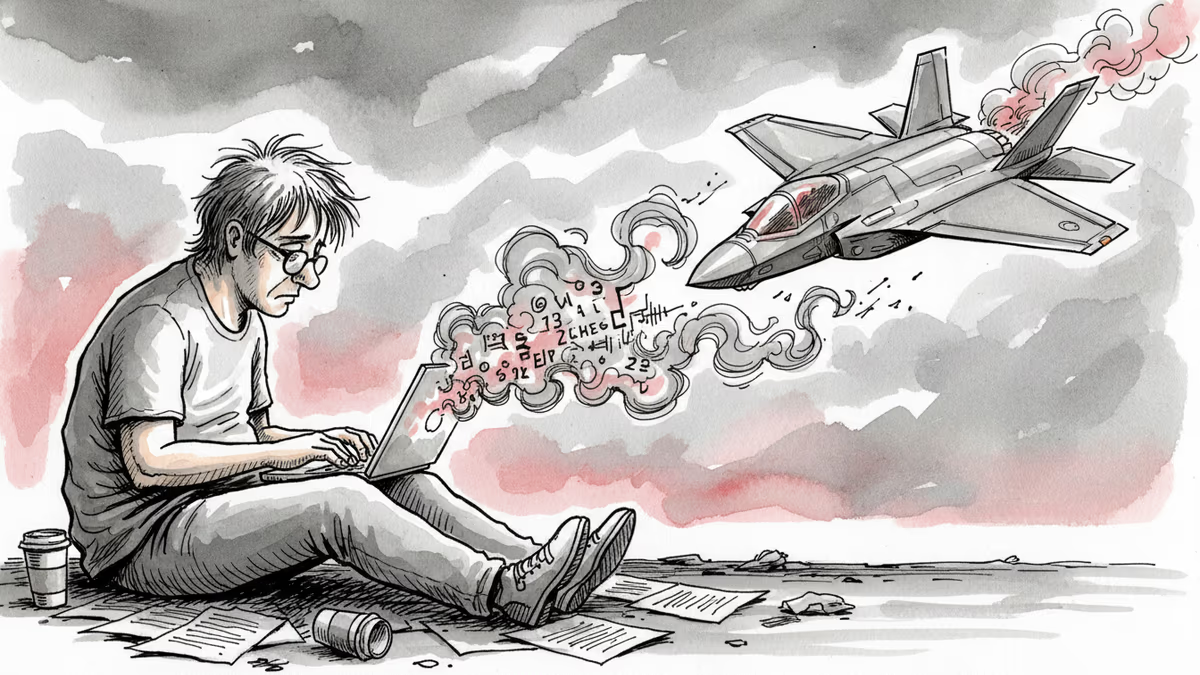

中国の民間STEM人材がイランのために米軍F-35対策動画を作成・拡散。数千万回再生された「チュートリアル」は、現代の非対称戦争と民間知識の軍事転用という新たな問いを提起する。

米軍がイランへの作戦にPalantirのAIシステムを使用。小学校への誤爆が法的・倫理的論争を呼ぶ中、AIと戦争の境界線はどこにあるのか。国際法・技術倫理の観点から考える。

米国防総省のヘグセス長官に対し、民主党議員120人超がイランの小学校爆撃におけるAI標的選定の関与を問いただした。現代戦争におけるAI倫理の核心的問題が浮上している。

中国の防衛テクノロジー企業・錦安科技が、米軍のイラン爆撃に使用されたB-2ステルス爆撃機の無線信号を傍受したと主張。AIと公開情報を組み合わせた「戦場監視システム」の実態と、米中の情報戦の最前線を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加