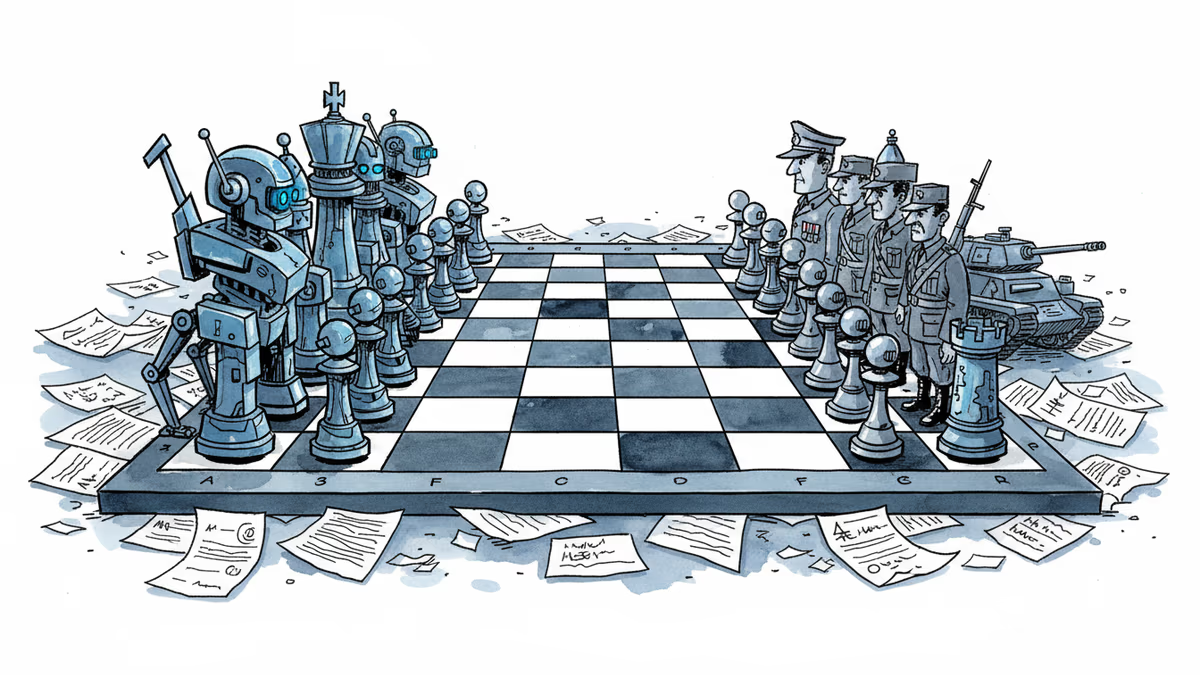

Anthropic、米国防総省との対決を選択 AI軍事利用の境界線

AnthropicのCEOが国防総省のサプライチェーンリスク指定に法的異議申し立てを表明。AI軍事利用における企業の価値観と国家安全保障のバランスが問われる。

10兆円規模のAI市場で、一つの企業が米国防総省に「No」を突きつけた。

AnthropicのCEOであるダリオ・アモデイ氏が、同社をサプライチェーンリスクとして指定した国防総省の決定に対して法的異議申し立てを行うと発表した。この指定により、Anthropicは事実上、米軍との契約から締め出される可能性が高まっている。

対立の核心:AI利用の境界線

今回の対立は、Anthropicが設定したAI利用の「レッドライン」から始まった。アモデイ氏は、同社のAIシステム「Claude」が米国民の大量監視や完全自律型兵器に使用されることを明確に拒否した。一方、国防総省は「すべての合法的目的」のための無制限アクセスを求めていた。

アモデイ氏は声明で、「法的に根拠のない」決定だと反発。国防総省の指定は「政府を保護するためのもので、サプライヤーを処罰するためではない」と主張し、法律上、国防長官は「目標達成に必要な最も制限的でない手段」を使用する必要があると指摘した。

競合他社との明暗

皮肉なことに、Anthropicの代わりにOpenAIが国防総省との契約を獲得した。しかし、この決定はOpenAI社内でも反発を招いており、同社従業員からの批判が噴出している。

対立が激化したきっかけの一つが、アモデイ氏が社内に送ったメモの流出だった。このメモで彼は、OpenAIの国防総省との取引を「安全性の演技」と批判していた。アモデイ氏は後にこの表現について謝罪し、「困難な一日」の中で書かれたもので、「慎重で熟考された見解」を反映していないと釈明した。

日本への示唆

日本でも防衛省がAI技術の活用を検討する中、この対立は重要な示唆を与える。ソニーや富士通などの日本企業がAI技術を防衛分野に提供する際、どこまでの利用を許可するのか。企業の価値観と国家安全保障のバランスをどう取るのか。

日本の「専守防衛」原則の下では、Anthropicのような明確な境界線設定がより受け入れられやすいかもしれない。しかし、中国や北朝鮮の脅威が高まる中、技術企業にも国家安全保障への貢献が求められる可能性がある。

法廷闘争の行方

Anthropicは連邦裁判所で争う構えだが、専門家は勝算を厳しく見ている。元トランプ政権のAI顧問だったディーン・ボール氏は、「裁判所は国家安全保障問題に関する政府の判断に異議を唱えることに消極的」だと指摘する。

それでもアモデイ氏は、現在イランでの作戦を支援している同社が、「必要な限り」国防総省に「名目的コスト」でモデルを提供し続けると表明した。完全な決別ではなく、条件付きの協力関係を維持する姿勢を示している。

関連記事

スイスEPFLが開発した「キネマティック・インテリジェンス」は、ロボットのスキル移転を可能にする新技術。製造業や高齢化社会を抱える日本への影響を多角的に考察します。

アップルCEOのティム・クックが2026年9月に退任し、後任にジョン・テルナスが就任する。15年間で築いた「オペレーション」という名の製品と、次世代リーダーが直面する課題を多角的に分析する。

AIが詐欺・フィッシング攻撃を加速させる一方、医療現場でも急速に普及。しかし患者への実際の効果は未検証のまま。日本社会への影響と問いかけを探る。

Anthropicが実施したAIエージェント同士の売買実験「Project Deal」。186件の取引、4,000ドル超の価値。高性能モデルが優位な結果を出す一方、格差に気づかないユーザーの問題が浮上した。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加