「クリエイターの王」アドビ、AI学習で訴訟——問われる業界全体の「データの原罪」

クリエイターの味方であるはずのアドビが、AI学習データで著作権侵害の訴訟に直面。これは単なる一社の問題ではなく、AI業界全体の「データの原罪」を問うものです。

なぜ今、このニュースが重要なのか

クリエイティブ業界の巨人であり、「クリエイターの味方」を標榜するアドビが、自社のAIモデル学習に海賊版の書籍を使用したとして集団訴訟に直面しています。この一件は、単なる一企業の法務トラブルではありません。生成AIブームの根幹を支える「データ」の出所という、業界全体が抱える「原罪」を浮き彫りにする象徴的な出来事だからです。

本件の要点

- 訴訟の核心:アドビの小規模言語モデル「SlimLM」が、海賊版書籍を含むデータセット「SlimPajama」を基に学習されたと作家らが主張。

- ブランドへの打撃:クリエイター向けツールで収益を上げるアドビが、クリエイターの著作権を侵害したという疑惑は、同社のブランドイメージと信頼性を根底から揺るがします。

- 業界共通の課題:アップルやSalesforceなど、他の巨大テック企業も同様のデータセットを巡る訴訟に直面しており、これはアドビだけの問題ではないことを示唆しています。

- 「データの出所」が最大のリスクに:これまで見過ごされてきたAI学習データの「出所(プロベナンス)」が、今や企業の法的・評判上の最大リスク要因となりつつあります。

詳細解説:汚染された「データ・サプライチェーン」の実態

訴訟の背景:データセットの「負の連鎖」

今回の訴訟で問題となっているのは、複雑なデータの連鎖です。発端は、約19万冊の書籍を違法にコピーしたとされる巨大データセット「Books3」。これが含まれる「RedPajama」というオープンソースのデータセットが作られ、さらにそれを基に「SlimPajama」が作成されました。アドビは、この「SlimPajama」を自社のAI「SlimLM」の学習に使用したとされています。意図的であったか否かにかかわらず、一度汚染されたデータがサプライチェーンのように流れ、最終製品であるAIモデルにまで影響を及ぼした構図です。これは、多くのAI開発企業が「オープンソースだから安全」という安易な考えでデータセットを利用している現状に警鐘を鳴らすものです。

なぜアドビへの訴訟が特に重要なのか

テック企業への同様の訴訟は後を絶ちませんが、アドビのケースは特に深刻な意味を持ちます。なぜなら、アドビのビジネスモデルそのものが、PhotoshopやIllustratorといったツールを通じてクリエイターの創造性を収益化することに基づいているからです。そのアドビが、クリエイターの権利を踏みにじる形で利益を得ていたとすれば、それは自社の顧客とビジネスの根幹に対する裏切り行為に他なりません。Fireflyのような画像生成AIで「商業的に安全なモデル」を謳っていただけに、今回の訴訟は同社のAI戦略全体への信頼を大きく損なう可能性があります。

今後の展望

この訴訟は、氷山の一角に過ぎません。今後、AI開発企業は自社モデルの学習に使用した全データの出所を遡って監査する必要に迫られるでしょう。短期的には、さらなる訴訟の増加と、リスク回避のための開発ペース鈍化が予想されます。

中長期的には、AI学習データのための新たな法整備や、クリエイターへの正当な対価を保証するライセンス市場の形成が加速する可能性があります。アドビの事例は、テクノロジー業界全体が「イノベーションのためなら何でも許される」という時代が終わり、倫理とコンプライアンスを欠いた開発は成り立たないという現実を直視する、重要な転換点となるでしょう。

関連記事

AnthropicがOpus 4.8を公開。前作からわずか41日での更新は競争圧力の表れか。「不確実性を自ら報告する」設計思想が、企業AI活用の信頼基準を塗り替えようとしている。

ローマ法王レオ14世の初回回勅にAnthropicの共同創業者が登壇。宗教とシリコンバレーの異例の接近が示す、AIガバナンスの本質的な問いとは。

ローマ教皇レオ14世の回勅「マニフィカ・ウマニタス」はAIを技術問題ではなく人間の尊厳と権力の問題として捉え、アルゴリズムによる支配への警鐘を鳴らしています。日本社会への示唆を読み解きます。

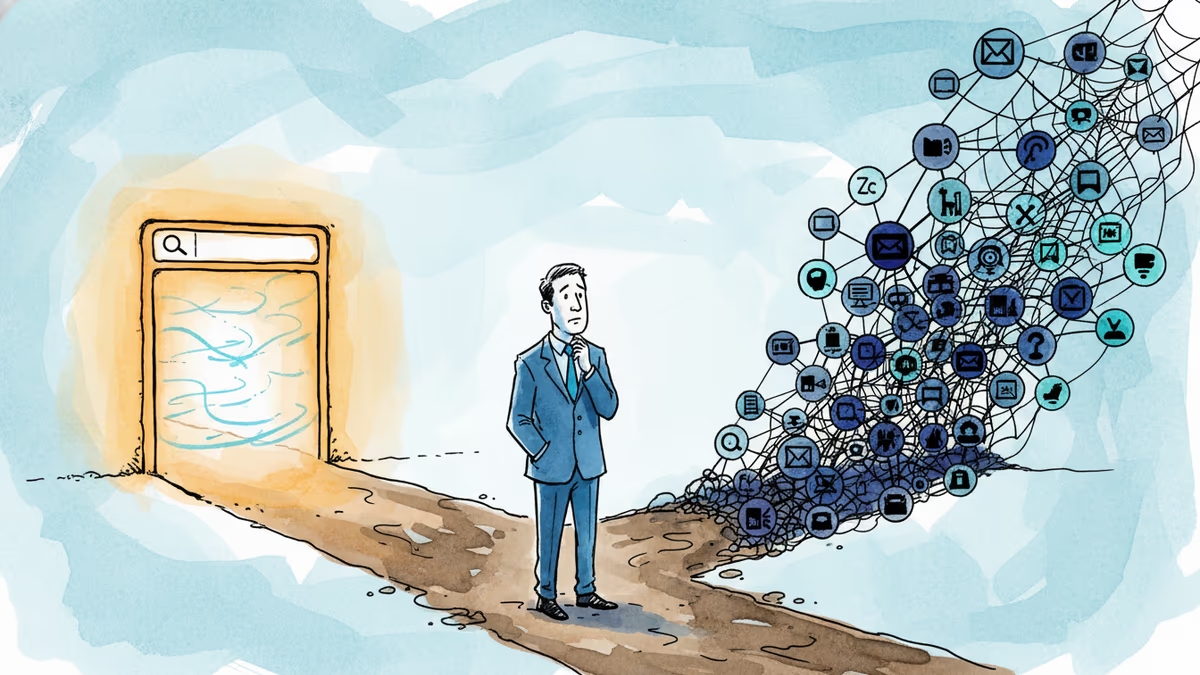

Google I/O直後のサンダー・ピチャイCEOへの独占インタビュー。AI検索の変容、ウェブの未来、AGIへのタイムライン、そして日本社会への影響を多角的に分析します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加