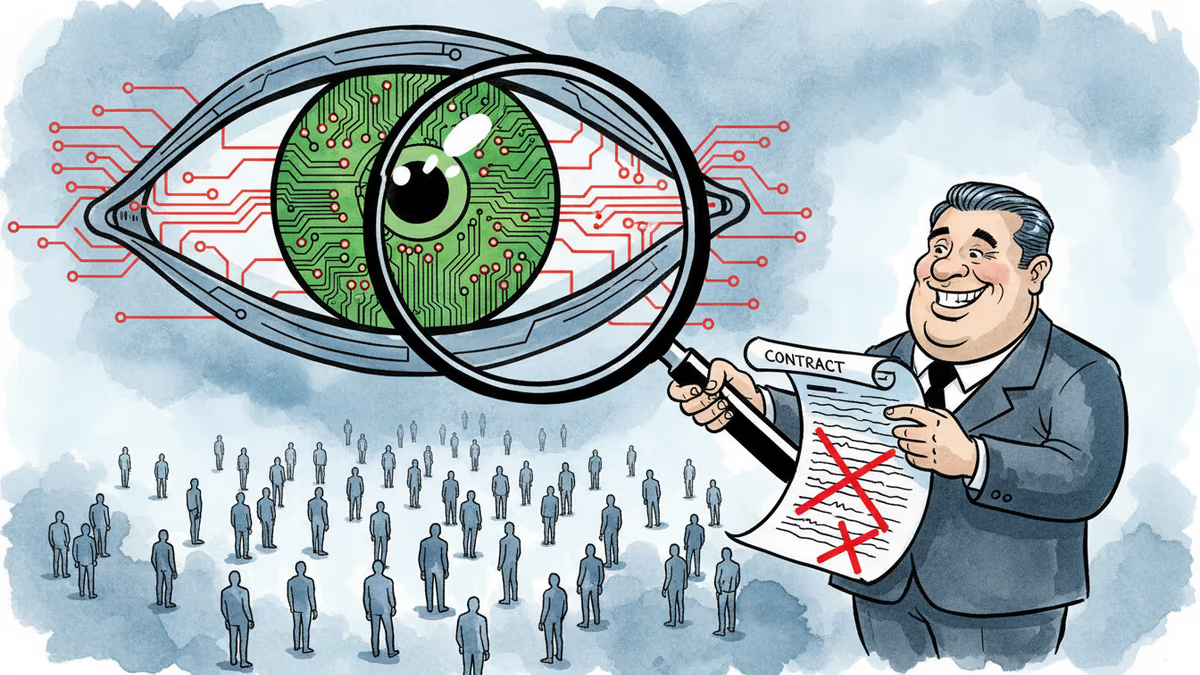

OpenAI與五角大廈的模糊紅線:AI監控的邊界在哪?

OpenAI與美國國防部簽署合約引發爭議,承諾不進行大規模監控,但法律專家質疑條款存在漏洞,AI倫理界線究竟在哪?

47% 的美國人擔心政府會濫用人工智慧進行監控。現在,這個擔憂有了新的焦點:OpenAI 剛與五角大廈簽署的合約。

週一,OpenAI 總部外出現了一群抗議者,他們跪在人行道上用彩色粉筆寫下訊息:「捍衛自由」、「請勿進行大規模監控」、「請修改合約」。這場小規模抗議的背後,是一個更大的問題:當AI遇上軍方,倫理的邊界究竟在哪?

從Anthropic到OpenAI:五角大廈的AI夥伴轉換

事情要從 Anthropic 說起。這家AI公司原本是五角大廈的合作夥伴,但因為拒絕讓其技術用於全自動武器系統,遭到國防部長 Pete Hegseth 列為「供應鏈風險」——這是一項嚴厲制裁,意味著任何與五角大廈合作的公司都不得使用 Anthropic 的產品。

就在 Anthropic 被制裁的幾小時後,Sam Altman 在社群媒體上宣布 OpenAI 與國防部達成協議。這個時機點讓人不禁懷疑:OpenAI 究竟提供了什麼 Anthropic 不願意給的條件?

在內部備忘錄中,Altman 承諾建立「紅線」,防止五角大廈將 OpenAI 產品用於大規模國內監控和自主殺傷性武器。但法律專家仔細研讀合約條款後發現,這些「紅線」其實相當模糊。

合約條款的灰色地帶

OpenAI 最初公布的合約片段寫道:「國防部可將AI系統用於所有合法目的,符合適用法律。」接著提到,將AI用於情報活動時會「遵守」包括 1978年外國情報監控法案(FISA)在內的相關法規。

問題是,這些法規本身就允許對美國人進行某種程度的監控。根據FISA,情報機構可以錄製並儲存美國人與海外人士的通話,購買大量用戶數據並進行分析。

明尼蘇達大學法學教授 Alan Rozenshtein 直言:「一般人認為的自動化大規模監控,有很多在法律上根本不算違法。」生成式AI可以將原本難以處理的龐大資料——稅務記錄、聯邦就業檔案、數十億筆截獲的通訊、智慧型手機位置數據等——轉化為精確的洞察。

週一的合約修正:實質改變還是文字遊戲?

面對質疑聲浪,OpenAI 在週一修正了合約條款,明確規定AI系統「不得故意用於對美國人民和國民的國內監控」,並補充說明這項限制「禁止刻意追蹤、監控或監視美國人民或國民,包括透過採購或使用商業取得的個人或可識別資訊」。

這個修正版本看似更嚴格,但法律專家指出仍有漏洞。「故意」和「刻意」等用詞為「偶然」收集的資料提供了相當大的操作空間。許多商業取得的數據可能不被視為「個人或可識別」資訊。

前陸軍副部長 Brad Carson 毫不客氣地評論:「在國家安全當局的定義下,普通人認為的監控與法律意義上的監控完全不同。」

技術防護欄的承諾與現實

OpenAI 表示將建立技術「安全堆疊」來監控其模型的使用方式,並派遣工程師與國防部合作,以「獨立驗證這些紅線不被跨越」。但公司並未提供這套安全架構如何運作的詳細資訊。

更關鍵的問題是:如果政府和 OpenAI 對某項應用是否被允許產生分歧,會發生什麼?喬治華盛頓大學政府合約法專家 Jessica Tillipman 指出,政府通常先行動,事後再處理爭議。

Anthropic 的前車之鑑更說明了權力不對等的現實。透過將 Anthropic 列為供應鏈風險,五角大廈展現了「如果談判陷入僵局,他們不怕」對美國私人公司實施極端制裁的決心。

華人世界的觀察視角

這場爭議對華人科技界別具意義。在中美科技競爭的大背景下,美國政府對AI技術的軍事化應用態度,直接影響全球AI產業的發展方向。

台灣和香港的科技業者特別關注這類合約可能設下的先例:當政府以國家安全為名要求科技公司配合時,企業的自主權和倫理立場能維持到什麼程度?

相較於中國大陸科技公司與政府的緊密關係,美國科技巨頭過去享有相對更多的獨立性。但 OpenAI 與五角大廈的合約顯示,即使在民主制度下,國家安全考量仍可能壓過企業的倫理原則。

相关文章

教宗良十四世發布《壯麗人性》通諭,與Anthropic共同創辦人同台,呼籲AI時代財富普遍共享。這份文件如何挑戰科技巨頭的財富邏輯,對華人世界又意味著什麼?

梵蒂岡發布250頁通諭《人類的偉大》,首次正面回應AI時代。教宗良十四世主張「人類的不完美正是尊嚴所在」,直接挑戰矽谷的人類懷疑論。

教宗良十四世首份通諭「宏大人性」以聖經隱喻批判AI巨頭壟斷,援引百年前勞工宣言,呼籲以合作社模式重塑AI所有權結構。這對華人世界意味著什麼?

教宗良十四世發布首份回勅,要求為AI發展建立倫理框架、保護勞工尊嚴並限制軍事應用。這份文件對華人世界意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论