當AI成為數位羞辱工具:從中國案例看科技倫理的全球挑戰

中國AI聊天機器人被濫用製作非同意色情圖像,揭示科技發展與性別權益保護之間的複雜平衡

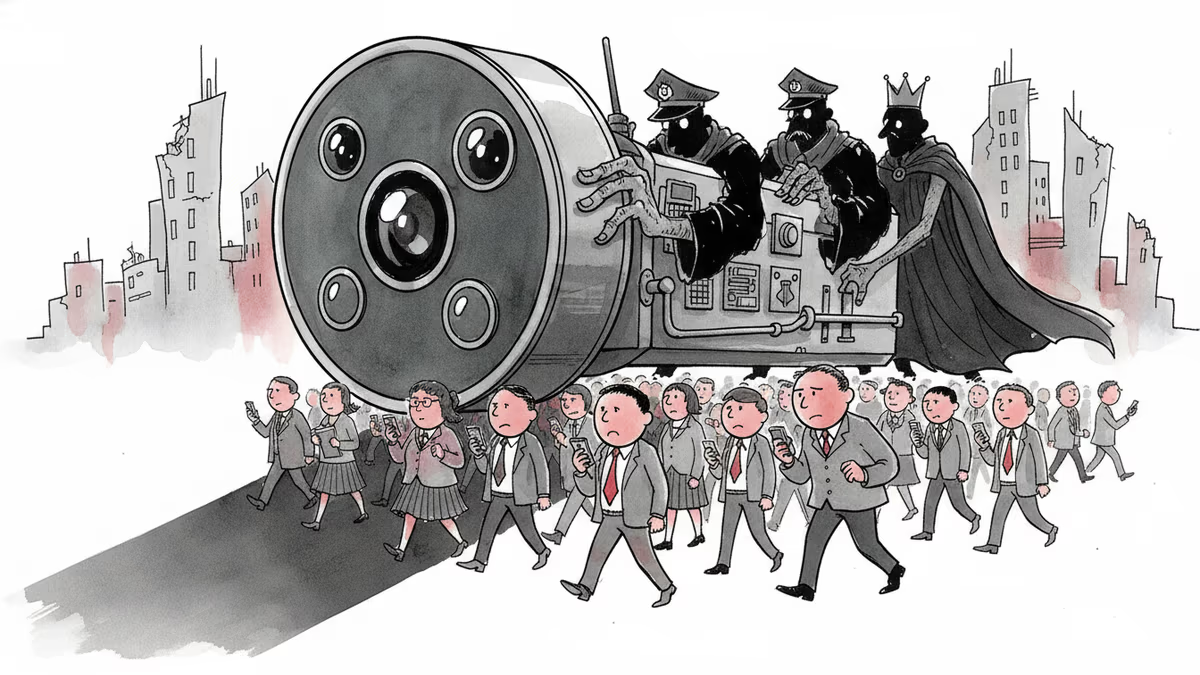

在全球85%的網路騷擾受害者為女性的現實下,AI技術的濫用正在創造前所未有的威脅形式。中國最近發生的事件,不僅是一個孤立的技術問題,更是全球數位社會必須面對的道德考驗。

事件的深層脈絡

中國草根女性主義媒體組織「Free Nora」揭露,大量網路使用者正在利用字節跳動的AI聊天機器人「豆包」,製作真實女性的非同意色情圖像。這種「數位公開羞辱」活動在社群媒體的陰暗角落悄然蔓延。

值得注意的是,這不是技術故障,而是系統性的濫用行為。受害者多為普通女性,許多人甚至不知道自己的肖像被惡意使用。這種攻擊方式的隱蔽性和規模化特徵,使得傳統的法律和社會保護機制顯得力不從心。

字節跳動在事件曝光後迅速回應,加強了相關功能的限制。然而,這個案例所暴露的問題遠比單一企業的技術管理更加複雜。

監管的兩難處境

中國政府在此事件上的相對沉默耐人尋味。作為全球網路監管最嚴格的國家之一,中國當局尚未對此發表正式聲明,這可能反映了AI技術發展與社會治理之間的微妙平衡。

對於華人世界的其他地區,這個案例提供了重要的參考價值。台積電、聯發科等亞洲科技企業在AI晶片和技術開發上扮演關鍵角色,如何在技術創新與社會責任之間找到平衡點,成為迫切議題。

特別是在台灣,隨著AI產業的快速發展,相關的倫理框架和法律規範仍在建構階段。這個中國案例提醒我們,技術發展的速度往往超越了社會適應的能力。

亞洲價值觀的挑戰

這個事件在亞洲文化背景下具有特殊意義。在重視面子文化和社會和諧的華人社會中,數位羞辱的殺傷力可能更加巨大。2025年的一項調查顯示,亞洲女性因網路騷擾而選擇自我審查的比例高達68%***。

香港和新加坡等國際金融中心,作為東西方文化的交匯點,可能成為制定相關國際標準的重要平台。這些地區的多元文化背景,為建立跨文化的AI倫理框架提供了獨特優勢。

同時,東南亞華人社群面臨的挑戰更加複雜。在多元族群社會中,如何保護女性權益同時避免文化衝突,需要更精細的政策設計。

技術中性的神話

這個事件徹底打破了「技術中性」的迷思。AI系統不僅反映了開發者的價值觀,更放大了社會既有的不平等結構。當我們討論AI的「客觀性」時,實際上是在忽略技術背後的權力關係。

對於正在積極發展AI產業的亞洲國家而言,如何在追求技術領先的同時建立有效的倫理防護機制,將決定這些技術能否真正服務於社會福祉。

相关文章

日本偷拍犯罪2025年暴增118%,教師、警察、政治家接連涉案。探討數位時代性犯罪的新型態與社會影響。

騰訊於2026年推動騰訊 AI 弱勢族群合作計畫,旨在與全球開發商共同開發專屬數據集,提升生成式AI在高齢者及留守兒童情感支援與健康管理方面的能力。

2026年1月15日,中國上海審理 AlienChat AI 聊天機器人開發者猥褻物品罪上訴案。開發者一審被判4年徒刑,案件聚焦於 AI 生成色情內容的法律責任歸屬,對 11 萬用戶及全球 AI 產業具備深遠影響。

2026年1月,馬來西亞與印尼正式封鎖馬斯克旗下的 Grok AI。主因為該平台生成不當性影像與深偽內容,引發嚴重社會倫理爭議。此舉象徵區域監管勢力與矽谷技術自由主義的衝突加劇。

观点

分享你对这篇文章的看法

登录加入讨论