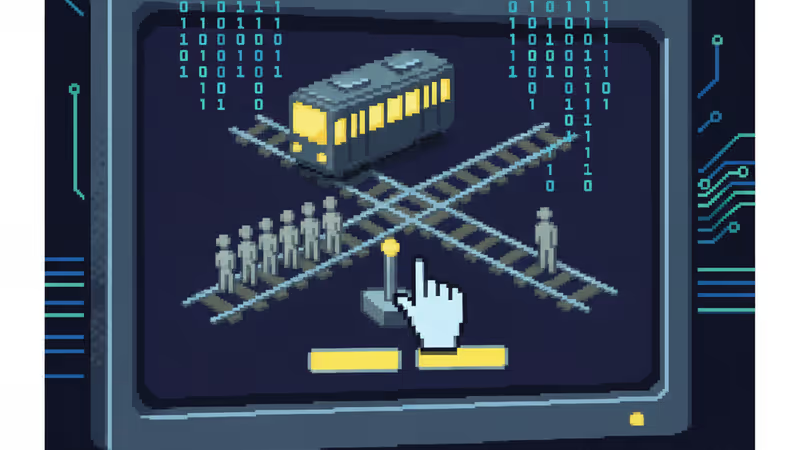

瘋傳「道德測驗」的真相:你點擊的每個選擇,都在訓練未來的AI

瘋傳的道德測驗不只是一場遊戲。本文深度解析其背後的注意力經濟、數據價值,以及它如何成為訓練AI倫理決策的關鍵資產。

重點摘要

最近在社交媒體上瘋傳的道德兩難測驗,看似只是簡單的消遣,實則揭示了數位內容產業的核心策略。這些測驗不僅是測試人性的工具,更是「注意力經濟」下的高效數據收集器,其產生的數據正成為訓練人工智慧(AI)倫理決策的寶貴資產。本文將深度剖析這一現象背後的商業邏輯與科技趨勢。

深度分析:注意力經濟下的心理遊戲

產業背景:從內容到數據的價值轉移

像Bored Panda或Buzzfeed這類型的媒體平台,其商業模式建立在「注意力經濟」的基礎之上。它們的核心目標並非創造深度內容,而是以最低成本生產出能最大化用戶停留時間與互動的「內容鉤子」。這些道德測驗正是完美的範例:

- 低製作成本:幾個簡單的情境與圖片,就能構成一個完整的互動體驗。

- 高心理捲入度:問題觸及自我認同、價值觀與社會比較等深層心理需求,驅使用戶不僅完成測驗,更願意分享結果以彰顯個人特質。

- 數據收集的黃金礦場:用戶的每一個選擇,都是一個清晰的「人類偏好數據點」。這遠比分析用戶的瀏覽行為更有價值,因為它直接反映了在特定壓力情境下的決策模式。

競爭格局:搶佔碎片化時間的戰爭

在當今的媒體環境中,競爭的不再是內容的深度,而是對用戶碎片化時間的佔有。這類測驗的設計完美適應了移動設備的短暫、快速的互動模式。它與TikTok的短影音、Instagram的民意調查競爭,都是為了在用戶通勤、排隊的幾分鐘內,提供一種快速、有回饋的心理滿足感。其成功之處在於將複雜的倫理思辨「遊戲化」,將一個需要深度思考的問題,簡化為一個二選一的點擊動作。

PRISM Insight:人類偏好數據與AI倫理對齊

這些看似無害的測驗,其真正的價值在於為科技業最棘手的問題之一 —— AI倫理對齊(AI Ethics Alignment) —— 提供了大規模的數據來源。

當我們要求自動駕駛汽車在事故中做出選擇(撞向老人還是小孩?)、或讓AI演算法決定誰能優先獲得稀缺的醫療資源時,我們實際上是在要求機器做出道德判斷。然而,倫理並無標準答案,它深受文化、個人價值觀影響。

這些病毒式測驗正好解決了這個數據稀缺的問題。它們在全球範圍內,跨越不同文化和背景,收集了數以百萬計的用戶在模擬道德困境中的選擇。對於AI開發者而言,這是一個前所未有的數據庫,可用於:

- 訓練決策模型:讓AI學習在模糊、兩難的情境中,如何做出更符合「大眾普遍觀感」的決定。

- 識別文化差異:分析不同地區用戶的選擇傾向,使AI服務能更適應當地化的倫理期望。

- 建立倫理框架的基準:雖然這些數據不能定義「正確」的道德,但它們可以提供一個反映人類集體直覺的基準線。

投資啟示:能夠有效收集、分析並應用這類「人類偏好數據」的公司,將在下一代AI應用(尤其是在醫療、法律、自動化等高風險領域)中佔據巨大優勢。其價值不僅在於廣告投放的精準度,更在於構建更安全、更被社會接受的AI系統。

未來展望

未來,我們可以預見這類「數據收集遊戲」將變得更加精緻與個人化。AI可能會根據您的個人資料,動態生成專屬於您的道德困境,以進行更深層次的心理剖析與數據採集。

然而,這也帶來了隱憂。當平台掌握了大規模用戶的道德決策模型,這項技術可能被用於更精密的輿論引導或行為操控。例如,透過精心設計的兩難問題,潛移默化地影響公眾對某一議題的立場。

最終,我們點下的每一個選擇,不僅僅是在定義我們自己是誰,更是在集體塑造一個即將由AI深度參與的未來社會。下一次當您遇到這類測驗時,或許可以思考:「我的選擇,正在教給AI什麼?」

관련 기사

도쿄에서 발생한 일가족 사망 사건의 이면을 분석합니다. 단순한 비극을 넘어 일본 사회의 고립된 육아, 정신 건강 위기 등 구조적 문제를 심층 진단합니다.

보스턴 블루 미드시즌 피날레의 충격적인 결말을 깊이 분석합니다. 실버 가문의 붕괴가 단순한 플롯 트위스트를 넘어 우리 사회의 정의와 미디어 산업에 던지는 의미를 파헤칩니다.

저스틴 비버와 헤일리 비버의 평범한 데이트 사진 한 장에 숨겨진 고도의 PR 전략과 수백만 달러 가치의 브랜드 제국에 대한 심층 분석.

기후 변화 시대, AI 기상 예측이 연말 여행의 성패를 좌우합니다. 단순 날씨 확인을 넘어, 터뷸런스 예측, 도로 결빙 분석 등 '웨더 테크'를 활용한 생존 전략을 분석합니다.