あなたの顔を守るAI——YouTubeが全ユーザーへ展開

YouTubeがディープフェイク検出機能を18歳以上の全ユーザーに開放。セルフィースキャンで自分の顔を守れる時代が来たが、プライバシーとの境界線はどこにあるのか。

自分の顔が、見知らぬ誰かの動画に使われている。気づかないまま、何百万回も再生されている——そんな事態が、すでに現実として起きている。

YouTubeは2026年5月、ディープフェイク検出機能「肖像検出プログラム」を18歳以上の全ユーザーに開放した。これまでコンテンツクリエイター、政府関係者、政治家、ジャーナリストなど限られた層を対象にテストを重ねてきたこの機能が、ついて一般公開へと踏み出した。

仕組みはシンプル、しかし問いは複雑

使い方は直感的だ。ユーザーがセルフィー感覚で自分の顔をスキャンすると、YouTubeのAIがプラットフォーム上の動画をモニタリングし、顔の「そっくりさん」を探し続ける。一致する映像が見つかれば、ユーザーに通知が届く。その後、ユーザーは削除申請を行うことができる。

YouTubeはこれまで「削除申請の件数は非常に少ない」と述べてきた。つまり、実際に悪用されているケースは想定より少ないかもしれない。しかし裏を返せば、多くの被害者がそもそも自分が被害に遭っていることに気づいていない可能性もある。

技術的な背景を整理すると、この機能はいわゆる「フェイスマッチング」技術を応用したものだ。生成AIの急速な進化により、本人の同意なく顔を別の映像に合成する「ディープフェイク」の生成コストは劇的に下がった。かつては高度な技術者にしかできなかった作業が、今や一般的なアプリで数分でできる。

なぜ「今」なのか——タイミングの意味

この機能の全面展開は、偶然のタイミングではない。2025年から2026年にかけて、欧州のAI法(EU AI Act)が段階的に施行され、プラットフォーム企業への規制圧力が高まっている。日本でも総務省がAI生成コンテンツの表示義務化に向けた議論を進めており、プラットフォーム側の自主的な対応が求められる空気が強まっている。

日本社会にとって、この問題は特別な重みを持つ。アイドルや俳優など、エンターテインメント産業に関わる人物のディープフェイク被害はすでに深刻で、ジャニーズ事務所(現SMILE-UP.)や大手芸能プロダクションは個別に対応を迫られてきた。今回の機能が一般ユーザーにも開放されたことで、有名人でなくても自衛手段を持てるようになった点は評価できる。

ただし、見落とせない論点がある。自分の顔をプラットフォームにスキャンさせること自体、新たなプライバシーリスクではないかという問いだ。ユーザーは「顔データを守るために、顔データを提供する」というジレンマに直面する。YouTubeの親会社であるGoogleがその生体情報をどう管理し、どこまで利用するのか——利用規約の文字を追うだけでは見えてこない部分が多い。

利害関係者それぞれの視点

コンテンツクリエイターにとっては朗報だ。自分のキャラクターや顔を使った無断コンテンツへの対抗手段が、ようやく一般化した。特にYouTubeで収益化しているクリエイターにとって、ブランドイメージの毀損は直接的な経済的損失につながる。

一方、プライバシー擁護団体は慎重な姿勢を崩さない。「顔認証データベースの拡大に加担することになる」という批判は根強い。欧州のGDPRの観点からも、生体データの収集には厳格な同意プロセスが求められており、YouTubeの対応が基準を満たすかどうかは継続的な検証が必要だ。

企業・広告主の視点では、ブランドセーフティの観点から歓迎する声が多い。無断で著名人の顔を使った広告詐欺(いわゆる「フェイクエンドースメント」)は、広告主にとっても深刻な問題だったからだ。

日本の高齢者ユーザーにとっては、機能の存在を知ること自体がハードルになるかもしれない。デジタルリテラシーの格差が、保護の恩恵を受けられるかどうかを左右する現実がある。

本コンテンツはAIが原文記事を基に要約・分析したものです。正確性に努めていますが、誤りがある可能性があります。原文の確認をお勧めします。

関連記事

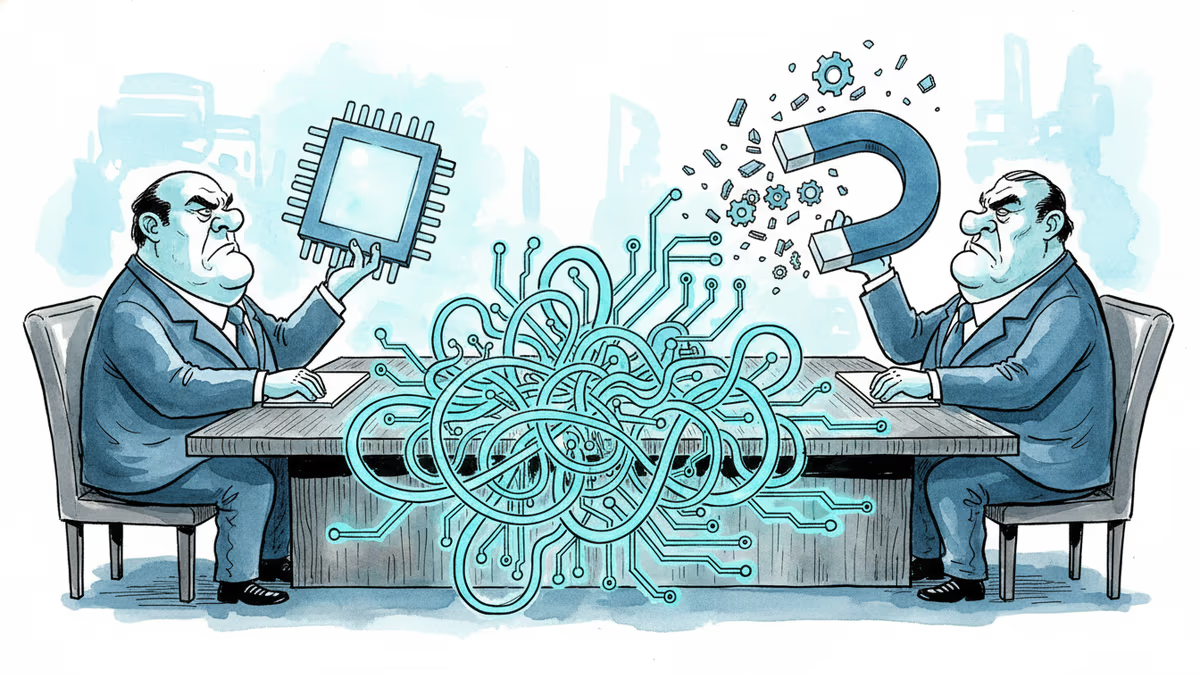

米中首脳会談でチップ輸出、AI競争、サプライチェーン、EV、レアアースという5つの技術議題が浮上。日本企業と日本経済への影響を多角的に分析します。

OpenAIがGreg Brockman主導のもと、ChatGPTとCodexを統合し単一のエージェント型プラットフォームへ移行。日本企業や開発者にとって何が変わるのか、組織改編の意味を読み解く。

生成AIの普及で企業データが第三者プラットフォームに集中する中、「AIと데이터の主権」を取り戻す動きが加速している。EDBの調査では世界の経営幹部の70%が独自の主権型プラットフォームが必要と回答。日本企業への影響と今後の展望を読み解く。

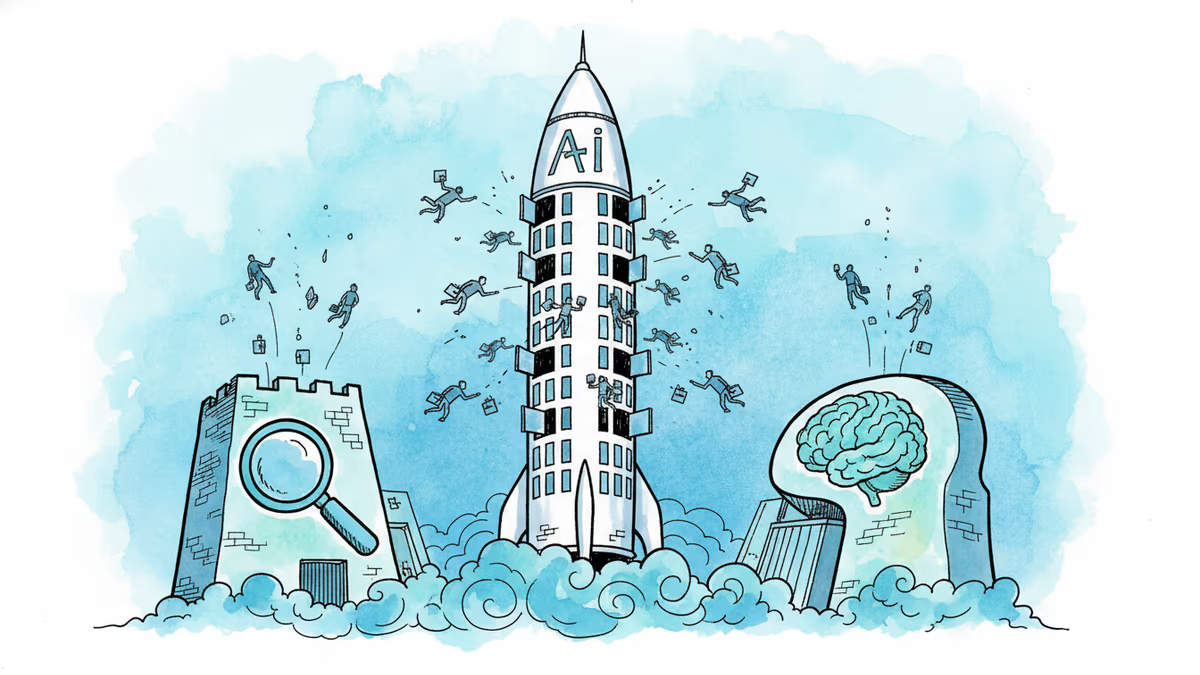

SpaceXAIから50人以上の研究者・エンジニアが離脱。事前学習チームの崩壊、過酷な労働文化、そして日本のAI産業への示唆を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加