AI音声アシスタントが「今度こそ本当に」使えるようになる?

GoogleとSamsungが発表した新しいGemini音声アシスタント機能。10年前の約束がついに実現するのか、それとも再び期待外れに終わるのか。

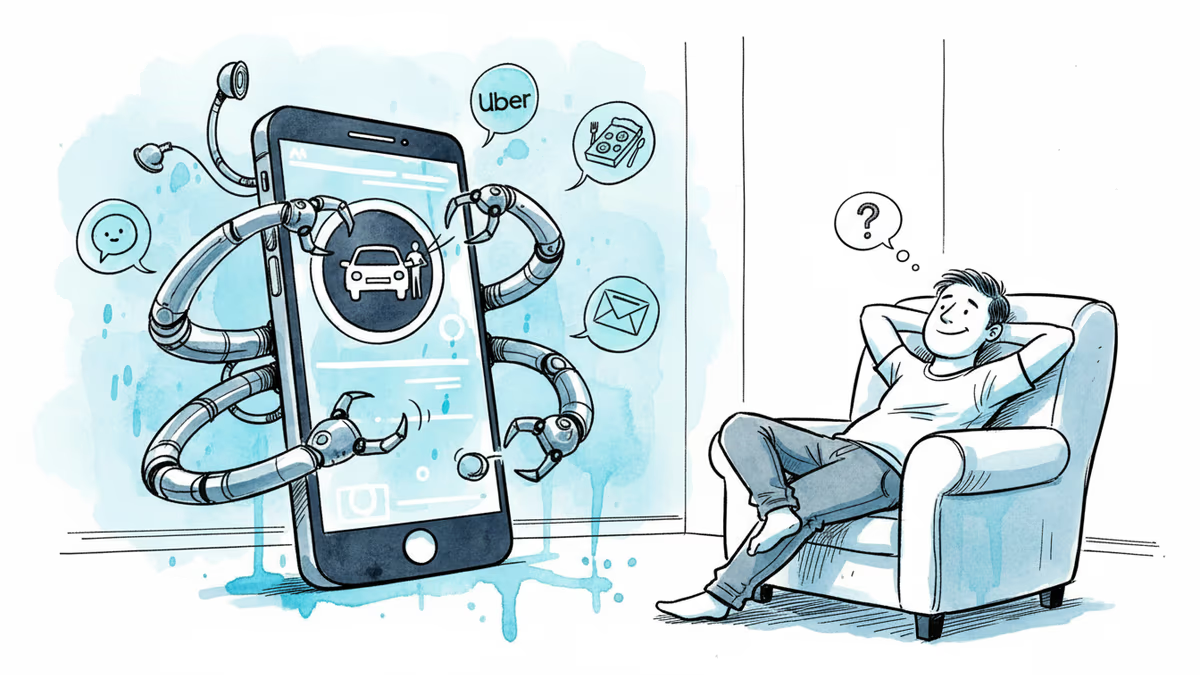

Sameer Samat氏がスマートフォンに向かって「空港までUberを呼んで」と話しかけると、画面上でGeminiが実際にUberアプリを開き、目的地を設定し、車種を選択していく。まるで人間の手が見えない形で操作しているかのように。

この光景は、10年前にAppleやGoogleが約束していた未来そのものだ。当時、SiriはUberを呼べると言われていたが、実際にはアプリを開くだけだった。Google Assistantでスターバックスの「いつもの注文」ができると宣伝されたが、体験は不完全で、最終的に機能は削除された。

今度は本当に違うのか

SamsungのGalaxy Unpackedイベントで、GoogleとSamsungは新しいGemini音声アシスタントを披露した。3月11日に発売予定のGalaxy S26から利用可能で、後にGoogle Pixel 10シリーズにもソフトウェア更新で提供される。

従来の音声アシスタントとの決定的な違いは、Geminiが実際にアプリの画面を「見て」操作することだ。事前にプログラムされた「地図」に従うのではなく、人間と同じように画面上のボタンやメニューを認識し、リアルタイムで判断を下す。

Googleの Android Ecosystem担当プレジデントであるSamat氏は、これを「デジタルな洗濯物」と表現する。「やらなければならないとわかっているが、特に楽しくない作業」を自動化することが目標だという。

複雑なタスクへの挑戦

実際のデモでは、友人たちとのグループチャットでピザの注文について話し合った内容を、Geminiが読み取って整理する様子が示された。「注文をまとめて」という一言で、Geminiは会話の文脈を理解し、各人の希望を整理してGrubhubで実際に注文プロセスを進めた。

もし情報が不足していれば、Geminiは質問を返す。ニューヨーク近郊で「空港まで」と言った場合、3つの主要空港のうちどれかを確認する。レストランが大きなピザの注文数を制限している場合は、代替案を提案する。

重要なのは、最終的な決定は必ず人間が行うことだ。Geminiは選択肢を整理し、カートに商品を入れるところまでは進めるが、実際の購入ボタンを押すのはユーザー自身だ。

日本企業への影響

この技術が普及すれば、日本のアプリ開発企業やサービス業界にも大きな変化をもたらす可能性がある。楽天やメルカリのようなプラットフォーム企業は、音声による操作に対応したUI設計を考える必要が出てくるだろう。

また、日本の高齢化社会において、複雑なスマートフォン操作に困難を感じる高齢者にとって、音声による簡単な操作は大きなメリットとなる可能性がある。「孫の写真を家族LINEに送って」「明日の天気に合わせて洋服を注文して」といった使い方が現実的になるかもしれない。

プライバシーという課題

一方で、プライバシーに関する懸念は避けられない。Geminiがアプリの画面を「見る」ということは、ユーザーの行動や嗜好を詳細に把握することを意味する。Googleは広告目的でのデータ使用を否定し、ユーザーがデータを削除できる仕組みを提供するとしているが、信頼の構築は継続的な課題となるだろう。

現在は米国と韓国でのみ提供開始予定で、日本での展開時期は明らかにされていない。日本の個人情報保護法や消費者保護の観点から、追加的な配慮が必要になる可能性もある。

本コンテンツはAIが原文記事を基に要約・分析したものです。正確性に努めていますが、誤りがある可能性があります。原文の確認をお勧めします。

関連記事

AIデータセンター特化スタートアップのFluidstackが$180億評価額で$10億調達交渉中。Anthropicとの$500億契約が示す、ハイパースケーラー依存からの脱却という新潮流を読み解く。

OpenAIのCEOサム・アルトマン氏の自宅が、わずか数日間で2度にわたり襲撃された。モロトフカクテルから銃撃へ——シリコンバレーの技術リーダーへの暴力は、何を示唆しているのか。

イーロン・マスクが掲げた「超人的能力」の夢。ニューラリンクの脳コンピューターインターフェースは今どこにあるのか。科学的現実と壮大な野望の間で何が起きているのかを読み解きます。

カナダのKepler Communicationsが宇宙最大の計算クラスターを運用中。軌道上コンピューティングの現実と2030年代の大規模データセンター構想、そして日本企業への影響を多角的に考察します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加